ペンタゴンの最後通告:Anthropicの72時間の生死の危機

- 核心的視点:Anthropicは深刻なアイデンティティとビジネス上の危機に直面しており、長年掲げてきた「責任あるAI」というブランドの約束は、政府の圧力、市場競争、そして自社の成長ニーズという多重の挟み撃ちの中で急速に瓦解し、企業行動には複数の矛盾が生じている。

- 重要な要素:

- ペンタゴンが最後通告を発し、Claudeの軍事利用制限(自律兵器の照準を含む)を解除するよう要求。さもなければ2億ドルの契約を解除し、「サプライチェーンリスク」ブラックリストに掲載する可能性がある。

- Anthropicが新版「責任ある拡張ポリシー」(RSP 3.0)を発表。「安全対策が不十分な場合は、より強力なモデルのトレーニングを一時停止する」という核心的な約束を削除し、より柔軟な枠組みへと移行した。

- 同社は、3つの中国AI企業がClaudeに対して「産業規模の蒸留攻撃」を行ったと公に非難した一方で、自社は海賊版書籍のトレーニングデータを使用したことで15億ドルの和解金を支払っており、ダブルスタンダードであると指摘されている。

- 3800億ドルという高い評価額と巨額の資金調達を獲得する一方で、その安全に関するナラティブは「差別化優位性」から「政治的負債」へと滑り落ちており、ブランドとビジネス現実の激しい衝突に直面している。

- 企業行動の論理矛盾:安全を理由に軍の一部要求を拒否し、他国の脅威を非難する一方で、競争のために自社の重要な安全ガードレールを削除し、「安全」ナラティブの商業的ブランドとしての本質を露呈している。

原文著者:Ada、深潮 TechFlow

2月24日、火曜日。ワシントン、ペンタゴン。

AnthropicのCEO、ダリオ・アモデイは、ピート・ヘグセス国防長官の前に座っていた。NPRやCNNなど複数のメディアが関係者の話として伝えるところによれば、会談の雰囲気は「礼儀正しい」ものだったが、内容はまったく穏やかではなかった。

ヘグセスは彼に最後通告を突きつけた:金曜日の午後5時01分までに、Claudeの軍事利用制限を解除し、ペンタゴンが「すべての合法的な用途」、すなわち自律兵器の照準や国内での大規模監視を含む用途に使用することを許可せよ。

さもなければ、2億ドルの契約をキャンセルする。国防生産法を発動し、強制徴用する。Anthropicを「サプライチェーンリスク」に指定する。これは、ロシアや中国の敵対的実体と同様のブラックリスト入りを意味する。

同じ日、Anthropicは第3版「責任ある拡張政策」(RSP 3.0)を発表し、創業以来の最も核心的な約束の一つをひっそりと削除した:安全対策が確立されていない限り、より強力なモデルを訓練しない、という約束だ。

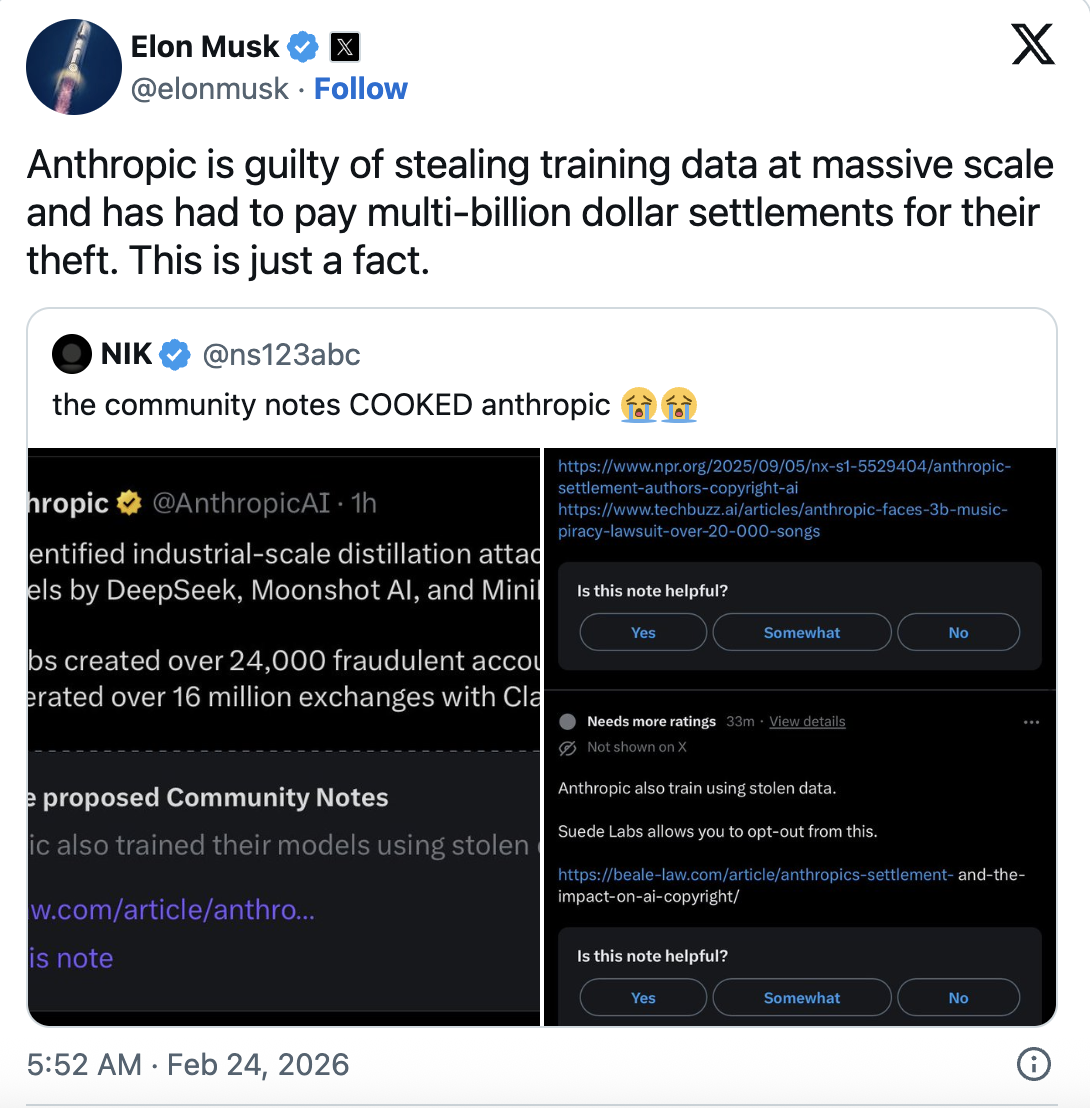

同じ日、イーロン・マスクはXで投稿した:「Anthropicは大規模な訓練データの窃盗を行っており、これは事実だ」。同時に、Xのコミュニティノートは、Anthropicが海賊版書籍をClaudeの訓練に使用したことで150億ドルの和解金を支払ったという報道を補足した。

72時間以内に、自ら「魂」を持つと称するこのAI企業は、同時に三つの役割を演じた:安全の殉教者、知的財産の窃盗犯、ペンタゴンの裏切り者。

どれが本当なのか?

おそらく、すべてが本当なのだろう。

ペンタゴンの「従うか、さもなくば去れ」

物語の第一層は単純だ。

Anthropicは、米国国防総省の機密レベルへのアクセス権を獲得した最初のAI企業である。昨年夏に獲得した契約は、上限20億ドル。OpenAI、Google、xAIもその後、同等規模の契約をそれぞれ獲得した。

アルジャジーラの報道によれば、Claudeは今年1月の米軍作戦に使用されたという。その作戦はベネズエラのマドゥロ大統領の拉致に関与していたと報じられている。

しかし、Anthropicは二つのレッドラインを引いた:完全自律兵器の照準には対応しない、米国市民に対する大規模監視には対応しない。Anthropicは、人工知能の信頼性は兵器の操作には不十分であり、また、大規模監視における人工知能の利用を規制する法律や規制は現時点で存在しないと考えている。

ペンタゴンは納得しなかった。

ホワイトハウスのAI顧問、デビッド・サックスは昨年10月、X上でAnthropicを「恐怖を武器にし、規制の虜(レギュラトリー・キャプチャー)を狙っている」と公に非難した。

競合他社はすでに屈服している。OpenAI、Google、xAIはすべて、軍が自社のAIを「すべての合法的なシナリオ」で使用することを許可することに同意した。マスクのGrokは今週、機密システムへの導入が承認されたばかりだ。

Anthropicは最後まで立ち続けている者だ。

本稿執筆時点で、Anthropicは最新の声明において、譲歩するつもりはないと表明している。しかし、金曜日午後5時01分という期限は、目前に迫っている。

匿名の元司法省・国防総省連絡官はCNNに対し、困惑を表明した:「どうやってある企業を『サプライチェーンリスク』と宣言すると同時に、その企業に自軍のために働くことを強制できるのか?」

良い質問だが、それはペンタゴンの考慮範囲外だ。彼らが気にするのは、Anthropicが妥協しなければ、強制手段を取るか、あるいは、ワシントンの厄介者になるか、ということだ。

「蒸留攻撃」:自らの非を暴かれるような告発

2月23日、Anthropicは激しい調子のブログ記事を発表し、3社の中国AI企業がClaudeに対して「産業レベルの蒸留攻撃」を行ったと告発した。

被告はDeepSeek、Moonshot AI、MiniMaxである。

Anthropicは、これら企業が2万4千の偽アカウントを通じてClaudeに1600万回以上のインタラクションを仕掛け、エージェント推論、ツール呼び出し、プログラミングにおけるClaudeの核心的能力を集中的に抽出したと主張している。

Anthropicはこの事態を国家安全保障上の脅威と位置づけ、蒸留されたモデルは「安全装置を保持する可能性が低く」、権威主義的政府によってサイバー攻撃、偽情報、大規模監視に利用される可能性があると主張した。

物語は完璧で、タイミングも完璧だった。

ちょうどトランプ政権が対中チップ輸出規制を緩和した直後、ちょうどAnthropicが自らのチップ輸出規制ロビー活動の立場を強化するための弾薬を必要としている時だった。

しかし、マスクが一撃を加えた:「Anthropicは大規模な訓練データの窃盗を行い、そのために数十億ドルの和解金を支払った。これは事実だ。」

AIインフラ企業IO.Netの共同創業者、トーリー・グリーンは言う:「あなたたちはネット上のデータを使って自社のモデルを訓練し、それから他人があなたたちの公開APIを使ってあなたたちから学ぶことを『蒸留攻撃』と呼ぶのか?」

Anthropicは蒸留を「攻撃」と呼ぶが、この行為はAI業界では日常茶飯事だ。OpenAIはGPT-4の圧縮に使い、GoogleはGeminiの最適化に使い、Anthropic自身も行っている。唯一の違いは、今回は自分自身が蒸留された側だということだ。

シンガポール南洋理工大学のAI教授、エリック・カンブリアはCNBCに対し、「合法的使用と悪意ある利用の境界は往々にして曖昧だ」と述べている。

さらに皮肉なことに、Anthropicは海賊版書籍をClaudeの訓練に使用したことで、150億ドルの和解金を支払ったばかりだ。彼らはネット上のデータを使ってモデルを訓練し、それから他人が自社の公開APIを使って学ぶことを非難する。これはダブルスタンダードではなく、トリプルスタンダードだ。

Anthropicは被害者を演じようとしたが、結果的に被告の立場に追い込まれてしまった。

安全約束の解体:RSP 3.0

ペンタゴンと対峙し、シリコンバレーと争っているまさにその日、Anthropicは第3版の責任ある拡張政策を発表した。

Anthropicの主任科学者、ジャレッド・カプランはメディアのインタビューで次のように述べている:「AIモデルの訓練を停止することは誰のためにもならないと感じています。AIが急速に発展している状況下で、一方的に約束すること……競合他社が全力で前進している中で、それは意味がありません。」

言い換えれば、他人がルールを守らないなら、私たちも隠し立てはしない、ということだ。

RSP 1.0と2.0の核心は、モデルの能力が安全対策の範囲を超えた場合、訓練を一時停止するという厳格な約束だった。この約束が、AnthropicにAI安全界隈で唯一無二の評判をもたらした。

しかし、3.0ではそれが削除された。

代わりに導入されたのは、より「柔軟な」フレームワーク、すなわち、Anthropic自身が実施できる安全対策と、業界全体の協力を必要とする安全提言を二つのトラックに分けるものだ。3~6か月ごとにリスク報告書を発行する。外部専門家によるレビューを依頼する。

責任あるように聞こえるか?

非営利組織METRの独立審査員、クリス・ペインターは、政策の早期草案を読んだ後、次のように述べている:「これは、Anthropicが『トリアージモード』に入る必要があると考えていることを示しています。なぜなら、リスクの評価と緩和の方法が能力の成長速度に追いついていないからです。これは、社会がAIの潜在的壊滅的リスクに対して準備ができていないことをより強く証明しています。」

TIMEの報道によれば、Anthropicはこの改訂についてほぼ1年間内部で議論し、CEOのアモデイと取締役会は満場一致で承認した。公式の説明では、元の政策は業界のコンセンサスを推進するために設計されたが、業界はまったく追いつかなかった。トランプ政権は人工知能の発展に対して放任主義の態度を取り、州レベルの関連規制を廃止しようとさえした。連邦レベルでの人工知能法は遠い先の話だ。2023年にグローバルガバナンスの枠組みを構築することは可能に思えたが、3年が経過し、その扉は明らかに閉じられた。

AIガバナンスを長年追跡している匿名の研究者は、より直接的に言う:「RSPはAnthropicの最も価値のあるブランド資産だ。訓練一時停止の約束を削除することは、まるで有機食品会社がこっそりパッケージから『有機』という文字を剥がし、今の検査はより透明性が高いとあなたに言うようなものだ。」

3800億ドル評価値の下でのアイデンティティの分裂

2月初旬、Anthropicは3800億ドルの評価値で300億ドルの資金調達を完了し、アマゾンがアンカー投資家となった。設立以来、140億ドルの年間収益を実現している。過去3年間、この数字は毎年10倍以上成長している。

同時に、ペンタゴンはブラックリスト入りを脅かしている。マスクは公にデータ窃盗を非難している。自らの核心的安全約束が削除された。Anthropicの人工知能安全責任者、ムリナンク・シャルマは辞任後、Xに「世界は危機に瀕している」と書き込んだ。

矛盾か?

おそらく、矛盾はAnthropicの遺伝子なのだろう。

この会社は、OpenAIが安全問題において速すぎる進歩をしていることを懸念した元OpenAI幹部によって設立された。そして彼ら自身が、より強力なモデルをより速く構築する会社を作り上げながら、そのモデルがいかに危険であるかを全世界に語っている。

ビジネスモデルは一言で要約できる:私たちは誰よりもAIを恐れているので、あなたは私たちにAIを作らせるためにお金を出すべきだ。

このナラティブは2023年から2024年にかけて完璧に機能した。AI安全はワシントンの流行語となり、Anthropicは最も人気のあるロビイストとなった。

2026年、風向きが変わった。

「目覚めたAI(woke AI)」は攻撃のレッテルとなり、州レベルのAI規制法案はホワイトハウスによって阻止され、Anthropicが支持したカリフォルニア州SB 53は法律として署名されたが、連邦レベルでは荒涼とした状況だ。

Anthropicの安全カードは、「差別化優位性」から「政治的負債」へと滑り落ちつつある。

Anthropicは複雑なバランス術を行っている。ブランドを維持するために十分に「安全」である必要があり、市場や政府に見捨てられないために十分に「柔軟」である必要がある。問題は、両端の許容範囲が狭まっていることだ。

安全ナラティブは、まだいくらの価値があるのか?

三つの出来事を重ねて見ると、全体像がはっきりする。

中国企業がClaudeを蒸留したと告発することは、チップ輸出規制のロビー活動のナラティブを強化するためだ。軍拡競争に遅れを取らないために、安全一時停止の約束を削除した。ペンタゴンの自律兵器要求を拒否することは、最後の道徳的な外衣を守るためだ。

それぞれのステップには論理があるが、ステップ同士は互いに矛盾している。

中国企業があなたのモデルを「蒸留」することは国家安全保障を脅かすと言いながら、自らのモデルの暴走を防ぐ約束を削除することはできない。もしモデルが本当にそれほど危険なら、あなたはより慎重であるべきであり、より積極的であるべきではない。

あなたがAnthropicでない限りは。

AI業界において、アイデンティティはあなたの声明によって定義されるのではなく、あなたの貸借対照表によって定義される。Anthropicの「安全」ナラティブは、本質的には一種のブランドプレミアムである。

AI軍拡競争の初期段階では、このプレミアムには価値があった。投資家は「責任あるAI」に対してより高い評価額を支払う意思があり、政府は「信頼できるAI」に対してゴーサインを出し、顧客は「より安全なAI」に対して対価を支払う意思があった。