Pentagon's Ultimatum: Anthropic's 72-Hour Life-or-Death Crisis

- มุมมองหลัก: Anthropic กำลังเผชิญกับวิกฤตอัตลักษณ์และธุรกิจที่รุนแรง สัญญาแบรนด์ "AI ที่มีความรับผิดชอบ" ที่พวกเขาประกาศมายาวนานกำลังพังทลายลงอย่างรวดเร็วภายใต้แรงกดดันจากรัฐบาล การแข่งขันในตลาด และความต้องการในการเติบโตของตัวเอง พฤติกรรมของบริษัทแสดงความขัดแย้งหลายประการ

- ปัจจัยสำคัญ:

- เพนตากอนออกคำขาด เรียกร้องให้ยกเลิกข้อจำกัดการใช้งานทางทหารของ Claude (รวมถึงการเล็งเป้าอาวุธอัตโนมัติ) มิฉะนั้นจะยกเลิกสัญญามูลค่า 200 ล้านดอลลาร์และอาจขึ้นบัญชีดำ "ความเสี่ยงในห่วงโซ่อุปทาน"

- Anthropic เผยแพร่นโยบาย "การขยายตัวอย่างรับผิดชอบ" รุ่นใหม่ (RSP 3.0) ซึ่งลบคำมั่นสัญญาหลักที่ว่า "จะหยุดฝึกฝนโมเดลที่ทรงพลังกว่าหากมาตรการความปลอดภัยไม่พร้อม" และเปลี่ยนไปใช้กรอบงานที่ยืดหยุ่นมากขึ้น

- บริษัทกล่าวหาอย่างเป็นทางการว่า บริษัท AI สามแห่งจากจีนทำการ "โจมตีแบบกลั่นกรองระดับอุตสาหกรรม" ต่อ Claude แต่ตัวเองกลับต้องจ่ายค่าปรับ和解 1.5 พันล้านดอลลาร์จากการใช้ข้อมูลหนังสือเถื่อนเพื่อฝึกโมเดล ถูกวิจารณ์ว่ามีมาตรฐานสองหน้า

- ในขณะที่ได้รับมูลค่าตลาดสูงถึง 38 พันล้านดอลลาร์และเงินทุนมหาศาล เรื่องเล่าด้านความปลอดภัยของบริษัทกำลังเปลี่ยนจาก "จุดเด่นที่แตกต่าง" สู่ "สินทรัพย์ทางการเมืองที่เป็นภาระ" เผชิญกับความขัดแย้งรุนแรงระหว่างแบรนด์และความเป็นจริงทางธุรกิจ

- ตรรกะการกระทำของบริษัทขัดแย้งกันเอง: ทั้งปฏิเสธข้อเรียกร้องบางส่วนจากกองทัพโดยอ้างเหตุผลด้านความปลอดภัยและกล่าวหาว่าประเทศอื่นเป็นภัยคุกคาม แต่ในขณะเดียวกันก็ลบมาตรการป้องกันความปลอดภัยสำคัญของตัวเองออกเพื่อการแข่งขัน สิ่งนี้เผยให้เห็นธรรมชาติของเรื่องเล่า "ความปลอดภัย" ที่เป็นเพียงแบรนด์เชิงพาณิชย์

ผู้เขียนต้นฉบับ: Ada, Shenchao TechFlow

วันอังคารที่ 24 กุมภาพันธ์ วอชิงตัน ดี.ซี. เพนตากอน

Dario Amodei ซีอีโอของ Anthropic นั่งอยู่ตรงข้ามกับ Pete Hegseth รัฐมนตรีกลาโหม ตามรายงานของ NPR และ CNN ที่อ้างอิงแหล่งข่าวภายใน บรรยากาศการประชุมเป็นไปอย่าง "สุภาพ" แต่เนื้อหาไม่ได้สุภาพเลย

Hegseth ได้ให้คำขาดกับเขา: ก่อนเวลา 17:01 น. ของวันศุกร์ ให้ยกเลิกข้อจำกัดการใช้งานทางทหารของ Claude อนุญาตให้เพนตากอนใช้มันสำหรับ "วัตถุประสงค์ที่ถูกกฎหมายทั้งหมด" รวมถึงการกำหนดเป้าหมายอาวุธอัตโนมัติและการเฝ้าระวังมวลชนภายในประเทศ

มิฉะนั้นจะยกเลิกสัญญามูลค่า 200 ล้านดอลลาร์ ใช้พระราชบัญญัติการผลิตเพื่อการป้องกันประเทศ (Defense Production Act) บังคับยึดทรัพย์ และจัดให้ Anthropic เป็น "ความเสี่ยงในห่วงโซ่อุปทาน" ซึ่งเทียบเท่ากับการใส่ชื่อบริษัทลงในบัญชีดำของหน่วยงานที่เป็นปรปักษ์กับรัสเซียและจีน

ในวันเดียวกัน Anthropic ได้เผยแพร่ "นโยบายการขยายตัวอย่างรับผิดชอบ" รุ่นที่สาม (RSP 3.0) และลบคำมั่นสัญญาหลักที่สุดนับตั้งแต่ก่อตั้งบริษัทออกอย่างเงียบ ๆ: หากไม่สามารถรับประกันได้ว่ามีมาตรการความปลอดภัยที่เพียงพอ ก็จะไม่ฝึกโมเดลที่ทรงพลังกว่า

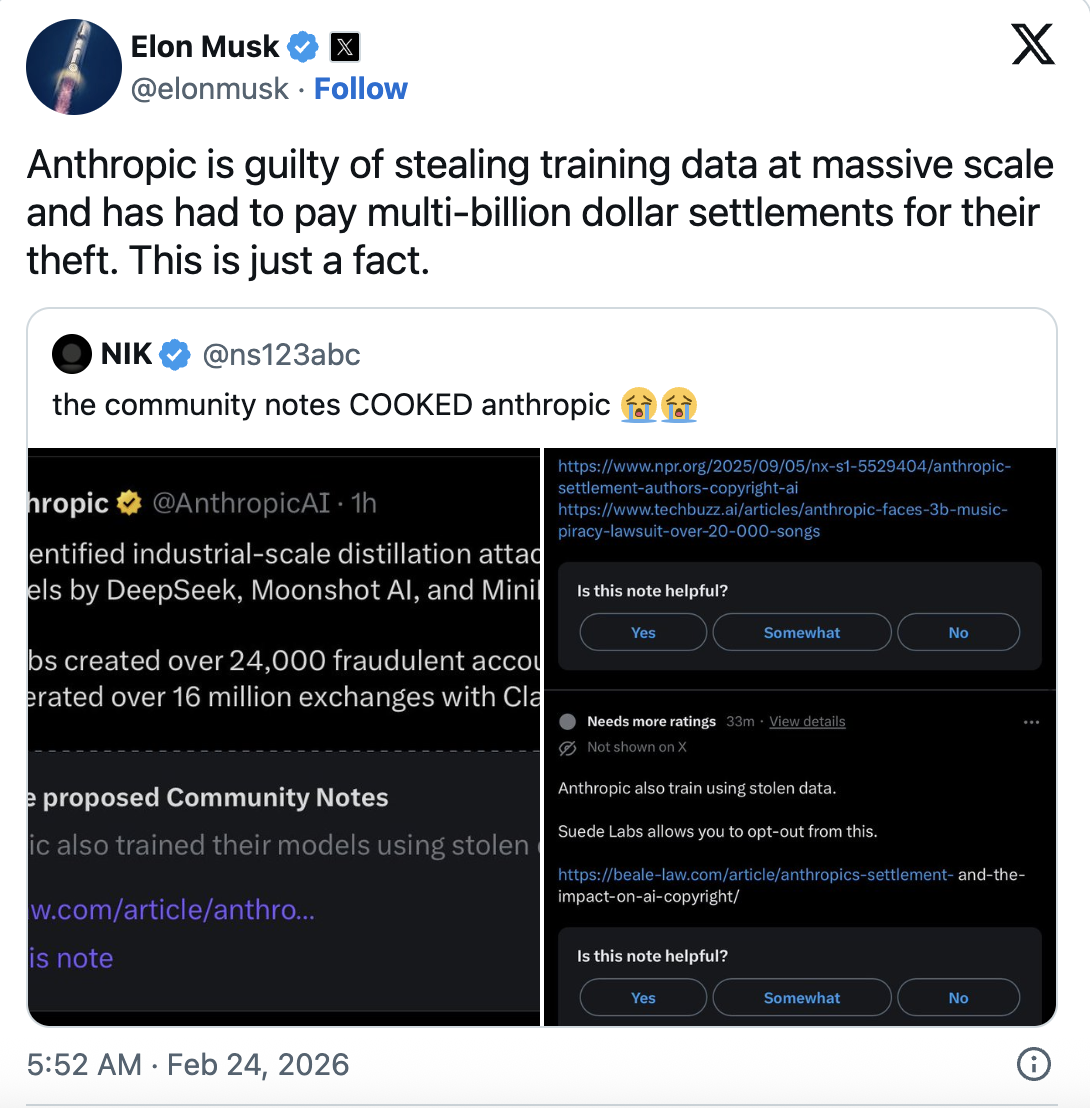

ในวันเดียวกัน Elon Musk โพสต์บน X ว่า: "Anthropic ขโมยข้อมูลการฝึกอบรมในวงกว้าง นี่คือข้อเท็จจริง" ในขณะเดียวกัน Community Notes ของ X ได้เพิ่มเติมรายงานว่า Anthropic จ่ายเงินชำระหนี้ 1.5 พันล้านดอลลาร์ เนื่องจากใช้หนังสือละเมิดลิขสิทธิ์ในการฝึก Claude

ภายในเจ็ดสิบสองชั่วโมง บริษัท AI ที่อ้างว่ามี "จิตวิญญาณ" แห่งนี้ ได้สวมบทบาทสามบทบาทพร้อมกัน: ผู้ยอมเสียสละเพื่อความปลอดภัย โจรขโมยทรัพย์สินทางปัญญา และผู้ทรยศต่อเพนตากอน

อันไหนคือเรื่องจริง?

อาจจะเป็นทั้งหมด

"ยอมทำตามหรือไม่ก็ออกไป" ของเพนตากอน

เลเยอร์แรกของเรื่องราวนั้นเรียบง่าย

Anthropic เป็นบริษัท AI แรกที่ได้รับสิทธิ์การเข้าถึงระดับความลับจากกระทรวงกลาโหมสหรัฐฯ ได้รับสัญญาในฤดูร้อนปีที่แล้ว มูลค่าสูงสุด 200 ล้านดอลลาร์ หลังจากนั้น OpenAI, Google, xAI ก็ได้รับสัญญาขนาดเท่ากันเช่นกัน

ตามรายงานของ Al Jazeera Claude ถูกใช้ในการปฏิบัติการของกองทัพสหรัฐฯ ครั้งหนึ่งในเดือนมกราคมปีนี้ รายงานระบุว่าการปฏิบัติการดังกล่าวเกี่ยวข้องกับการลักพาตัวประธานาธิบดี Maduro ของเวเนซุเอลา

แต่ Anthropic ได้ขีดเส้นแดงสองเส้น: ไม่สนับสนุนการกำหนดเป้าหมายอาวุธอัตโนมัติเต็มรูปแบบ และไม่สนับสนุนการเฝ้าระวังมวลชนต่อพลเมืองอเมริกัน Anthropic เชื่อว่าความน่าเชื่อถือของปัญญาประดิษฐ์ยังไม่เพียงพอที่จะควบคุมอาวุธ และขณะนี้ยังไม่มีกฎหมายหรือข้อบังคับใดที่ควบคุมการใช้งาน AI ในการเฝ้าระวังมวลชน

เพนตากอนไม่ยอมรับ

David Sacks ที่ปรึกษาด้าน AI ของทำเนียบขาว กล่าวหา Anthropic อย่างเปิดเผยบน X ในเดือนตุลาคมปีที่แล้วว่า "ใช้ความกลัวเป็นอาวุธ ดำเนินการจับกุมเชิงกำกับดูแล"

คู่แข่งยอมแพ้แล้ว OpenAI, Google, xAI ตกลงให้กองทัพใช้ AI ของตนใน "ทุกสถานการณ์ที่ถูกกฎหมาย" Grok ของ Musk เพิ่งได้รับการอนุมัติให้เข้าสู่ระบบความลับในสัปดาห์นี้

Anthropic เป็นคนสุดท้ายที่ยังยืนหยัดอยู่

ณ เวลาที่เผยแพร่ Anthropic ระบุในแถลงการณ์ล่าสุดว่า พวกเขาไม่ได้ตั้งใจจะยอม让步 แต่เส้นตายเวลา 17:01 น. ของวันศุกร์ ใกล้เข้ามาแล้ว

อดีตเจ้าหน้าที่ประสานงานระหว่างกระทรวงยุติธรรมและกระทรวงกลาโหมที่ไม่ประสงค์ออกนาม แสดงความสับสนต่อ CNN: "คุณจะประกาศให้บริษัทหนึ่งเป็น 'ความเสี่ยงในห่วงโซ่อุปทาน' ในขณะที่บังคับให้บริษัทเดียวกันนี้ทำงานให้กองทัพของคุณได้อย่างไร?"

คำถามที่ดี แต่สิ่งนี้ไม่อยู่ในขอบเขตการพิจารณาของเพนตากอน สิ่งที่พวกเขาใส่ใจคือ หาก Anthropic ไม่ประนีประนอม จะใช้มาตรการบังคับ หรือกลายเป็นผู้ถูกทอดทิ้งในวอชิงตัน

"การโจมตีแบบกลั่น": ข้อกล่าวหาที่ตบหน้า

วันที่ 23 กุมภาพันธ์ Anthropic เผยแพร่บล็อกโพสต์ที่มีถ้อยคำรุนแรง กล่าวหาบริษัท AI ของจีนสามแห่งว่าดำเนิน "การโจมตีแบบกลั่นระดับอุตสาหกรรม" ต่อ Claude

จำเลยคือ DeepSeek, Moonshot AI, MiniMax

Anthropic กล่าวหาว่าพวกเขาใช้บัญชีปลอม 24,000 บัญชี ส่งคำขอโต้ตอบกับ Claude มากกว่า 16 ล้านครั้ง เพื่อแยกความสามารถหลักของ Claude ในด้านการให้เหตุผลของเอเจนต์ การเรียกใช้เครื่องมือ และการเขียนโปรแกรมออกมาโดยตรง

Anthropic กำหนดให้เรื่องนี้เป็นภัยคุกคามต่อความมั่นคงแห่งชาติ อ้างว่าโมเดลที่ผ่านการกลั่นแล้ว "มีแนวโน้มน้อยที่จะคงรั้วกั้นความปลอดภัยไว้" และอาจถูกรัฐบาลอำนาจนิยมใช้สำหรับการโจมตีทางไซเบอร์ ข้อมูลเท็จ และการเฝ้าระวังมวลชน

การเล่าเรื่องสมบูรณ์แบบ เวลาก็สมบูรณ์แบบ

พอดีหลังจากที่รัฐบาลทรัมป์เพิ่งผ่อนคลายการควบคุมการส่งออกชิปไปจีน พอดีในเวลาที่ Anthropic ต้องการหาลูกกระสุนสำหรับตำแหน่งการล็อบบี้เรื่องการควบคุมการส่งออกชิปของตัวเอง

แต่ Musk ยิงคำพูดออกมา: "Anthropic ขโมยข้อมูลการฝึกอบรมในวงกว้าง และจ่ายเงินชำระหนี้หลายพันล้านดอลลาร์สำหรับเรื่องนี้ นี่คือข้อเท็จจริง"

Tory Green ผู้ร่วมก่อตั้ง IO.Net บริษัทโครงสร้างพื้นฐาน AI กล่าวว่า: "พวกคุณใช้ข้อมูลจากทั้งอินเทอร์เน็ตฝึกโมเดลของตัวเอง แล้วเมื่อคนอื่นใช้ API สาธารณะของพวกคุณเรียนรู้จากพวกคุณ ก็เรียกว่า 'การโจมตีแบบกลั่น' แล้วเหรอ?"

Anthropic เรียกการกลั่นว่า "การโจมตี" แต่เรื่องนี้เป็นเรื่องปกติในอุตสาหกรรม AI OpenAI ใช้มันบีบอัด GPT-4, Google ใช้มันปรับ优化 Gemini แม้แต่ Anthropic เองก็ทำ สิ่งเดียวที่แตกต่างคือ ครั้งนี้ผู้ถูกกลั่นคือตัวมันเอง

ตามที่ Erik Cambria ศาสตราจารย์ AI แห่งมหาวิทยาลัยเทคโนโลยีหนานหยาง สิงคโปร์ กล่าวกับ CNBC: "เส้นแบ่งระหว่างการใช้ที่ถูกกฎหมายและการใช้ในทางที่ผิดมักจะคลุมเครือ"

ที่เหน็บแนมยิ่งกว่าคือ Anthropic เพิ่งจ่ายเงินชำระหนี้ 1.5 พันล้านดอลลาร์ เนื่องจากใช้หนังสือละเมิดลิขสิทธิ์ฝึก Claude มันใช้ข้อมูลจากทั้งอินเทอร์เน็ตฝึกโมเดล แล้วกล่าวหาคนอื่นที่ใช้ API สาธารณะของมันเรียนรู้จากมัน นี่ไม่ใช่สองมาตรฐาน นี่คือสามมาตรฐาน

Anthropic ตั้งใจจะสวมบทบาทเป็นผู้เสียหาย แต่กลับถูกเปิดโปงกลายเป็นจำเลย

การรื้อถอนคำมั่นสัญญาด้านความปลอดภัย: RSP 3.0

ในวันเดียวกันกับการเผชิญหน้ากับเพนตากอน และการทะเลาะวิวาทกับซิลิคอนวัลเลย์ Anthropic ได้เผยแพร่นโยบายการขยายตัวอย่างรับผิดชอบรุ่นที่สาม

Jared Kaplan หัวหน้านักวิทยาศาสตร์ของ Anthropic กล่าวในการให้สัมภาษณ์สื่อว่า: "เรารู้สึกว่าการหยุดฝึกโมเดล AI ไม่ได้ช่วยใครเลย ในบริบทของการพัฒนา AI ที่รวดเร็ว การให้คำมั่นสัญญาเพียงฝ่ายเดียว... ในขณะที่คู่แข่งกำลังดำเนินการเต็มที่ มันไม่สมเหตุสมผล"

พูดง่ายๆ คือ คนอื่นไม่เล่นตามกติกา เราก็ไม่แสร้งทำแล้ว

แกนกลางของ RSP 1.0 และ 2.0 คือคำมั่นสัญญาที่เข้มงวด: หากความสามารถของโมเดลเกินขอบเขตที่มาตรการความปลอดภัยครอบคลุม ให้หยุดฝึก คำมั่นสัญญานี้ทำให้ Anthropic ได้รับชื่อเสียงที่ไม่เหมือนใครในแวดวงความปลอดภัย AI

แต่รุ่น 3.0 ลบมันออก

แทนที่ด้วยกรอบงานที่ "ยืดหยุ่น" มากขึ้น นั่นคือ แบ่งมาตรการความปลอดภัยที่ Anthropic สามารถทำได้เอง และคำแนะนำด้านความปลอดภัยที่ต้องการความร่วมมือจากทั้งอุตสาหกรรม ออกเป็นสองเส้นทาง ออกรายงานความเสี่ยงทุก 3-6 เดือน เชิญผู้เชี่ยวชาญภายนอกตรวจสอบ

ฟังดูรับผิดชอบ?

Chris Painter ผู้ตรวจสอบอิสระจากองค์กรไม่แสวงหาผลกำไร METR กล่าวหลังจากดูร่างนโยบายฉบับแรกเริ่มว่า: "นี่แสดงว่า Anthropic คิดว่าจำเป็นต้องเข้าสู่ 'โหมดการคัดแยก' เพราะวิธีการประเมินและบรรเทาความเสี่ยงตามไม่ทันความเร็วของการเติบโตของความ能力 นี่พิสูจน์มากขึ้นว่าสังคมยังไม่พร้อมสำหรับความเสี่ยงหายนะที่อาจเกิดขึ้นจาก AI"

ตามรายงานของ TIME Anthropic ใช้เวลาเกือบหนึ่งปีในการอภิปรายภายในเกี่ยวกับการเขียนใหม่ครั้งนี้ ซีอีโอ Amodei และคณะกรรมการบริษัทเห็นชอบเป็นเอกฉันท์ คำอธิบายอย่างเป็นทางการคือ นโยบายเดิมออกแบบมาเพื่อขับเคลื่อนฉันทามติของอุตสาหกรรม แต่ผลลัพธ์คืออุตสาหกรรมไม่ตามมาเลย รัฐบาลทรัมป์ใช้แนวทางปล่อยปละละเลยต่อการพัฒนา AI และพยายามยกเลิกกฎระเบียบที่เกี่ยวข้องของแต่ละรัฐ กฎหมาย AI ในระดับรัฐบาลกลางยังอีกยาวไกล แม้ว่าการสร้างกรอบการกำกับดูแลระดับโลกในปี 2023 จะดูเป็นไปได้ แต่สามปีผ่านไป ประตูบานนี้ปิดลงอย่างชัดเจนแล้ว

นักวิจัยนิรนามที่ติดตามการกำกับดูแล AI มาเป็นเวลานาน กล่าวตรงไปตรงมามากขึ้น: "RSP เป็นสินทรัพย์แบรนด์ที่มีค่าที่สุดของ Anthropic การลบคำมั่นสัญญาหยุดฝึกออก ก็เหมือนกับบริษัทอาหารออร์แกนิกค่อยๆ ฉีกลาย 'ออร์แกนิก' ออกจากบรรจุภัณฑ์ แล้วบอกคุณว่าตอนนี้การตรวจสอบของพวกเขามีความโปร่งใสมากขึ้น"

การแตกแยกของอัตลักษณ์ภายใต้มูลค่า 3.8 ล้านล้านดอลลาร์

ต้นเดือนกุมภาพันธ์ Anthropic ดำเนินการระดมทุน 300 พันล้านดอลลาร์ ด้วยมูลค่าบริษัท 3.8 ล้านล้านดอลลาร์ โดย Amazon เป็นนักลงทุนหลัก นับตั้งแต่ก่อตั้ง บริษัทมีรายได้ประจำปี 140 พันล้านดอลลาร์ ในช่วงสามปีที่ผ่านมา ตัวเลขนี้เติบโตเกิน 10 เท่าทุกปี

ในเวลาเดียวกัน เพนตากอนขู่จะใส่ชื่อบริษัทในบัญชีดำ Musk กล่าวหาอย่างเปิดเผยว่าขโมยข้อมูล คำมั่นสัญญาด้านความปลอดภัยหลักของตัวเองถูกลบออก Mrinank Sharma หัวหน้าฝ่ายความปลอดภัย AI ของ Anthropic ลาออกและเขียนบน X ว่า: "โลกกำลังตกอยู่ในอันตราย"

ขัดแย้ง?

บางทีความขัดแย้งอาจเป็น DNA ของ Anthropic

บริษัทนี้ก่อตั้งโดยอดีตผู้บริหารระดับสูงของ OpenAI เพราะพวกเขากังวลว่า OpenAI จะเดินเร็วเกินไปในเรื่องความปลอดภัย จากนั้นพวกเขาก็สร้างบริษัทของตัวเอง สร้างโมเดลที่ทรงพลังยิ่งขึ้นด้วยความเร็วที่เร็วกว่า ในขณะเดียวกันก็บอกทั้งโลกว่าโมเดลเหล่านี้อันตรายแค่ไหน

รูปแบบธุรกิจสามารถสรุปได้ในหนึ่งประโยค: เรากลัว AI มากกว่าคนอื่นใด ดังนั้นคุณควรจ่ายเงินให้เราสร้าง AI

การเล่าเรื่องนี้ทำงานได้อย่างสมบูรณ์แบบในปี 2023-2024 ความปลอดภัย AI เป็นคำฮิตในวอชิงตัน Anthropic เป็นผู้ล็อบบี้ที่ได้รับความนิยมมากที่สุด

ปี 2026 ทิศทางเปลี่ยน

"woke AI" กลายเป็นป้ายโจมตี ร่างกฎหมายกำกับดูแล AI ระดับรัฐถูกทำเนียบขาวขัดขวาง SB 53 ของแคลิฟอร์เนียที่ Anthropic สนับสนุน แม้จะลงนามเป็นกฎหมายแล้ว แต่ในระดับรัฐบาลกลางกลับว่างเปล่า

ไพ่ความปลอดภัยของ Anthropic กำลังเลื่อนจาก "ข้อได้เปรียบที่แตกต่าง" สู่ "สินทรัพย์ทางการเมืองที่เป็นลบ"

Anthropic กำลังทำการทรงตัวที่ซับซ้อน มันต้อง "ปลอดภัย" พอที่จะรักษาแบรนด์ และต้อง "ยืดหยุ่น" พอที่จะไม่ถูกตลาดและรัฐบาลทอดทิ้ง ปัญหาคือ พื้นที่ความอดทนของทั้งสองด้านกำลังหดเล็กลง