9000억 달러 저장장치 주식을 붕괴시킨 구글 AI 논문, 실험 조작 의혹 제기

- 핵심 관점: 구글의 AI 메모리 압축 기술 TurboQuant에 관한 논문이 비교 실험에서 불공정성, 선행 연구 미흡한 인용, 성능 우위 왜곡 가능성 등의 의혹을 받아 학계 논란을 일으켰으며, 시장 홍보는 전 세계 저장장치 반도체 섹터의 격렬한 변동을 직접 초래했다.

- 핵심 요소:

- 핵심 논란 의혹: 논문이 RaBitQ 알고리즘과의 핵심 기술적 연관성을 충분히 설명하지 않았으며, 속도 비교에서 RaBitQ는 단일 코어 CPU의 Python 스크립트로 테스트한 반면, 자체 기술은 A100 GPU로 테스트하여 불공정 비교를 구성한 것으로 지적받았다.

- 시장 격렬한 반응: 구글 공식 블로그가 해당 논문을 홍보한 후, 시장이 AI 메모리 수요 감소를 우려하여 Micron, SanDisk 등의 저장장치 반도체 주식 시가총액이 단일 거래일 동안 9000억 달러 이상 증발했다.

- 기술 기여 사실: 독립 커뮤니티 검증에 따르면, TurboQuant 알고리즘의 압축 효과는 기본적으로 사실이며, 수학적 측면의 기여는 실재한다.

- 기관 분석 반박: Morgan Stanley 등의 기관 애널리스트들은 해당 기술이 특정 캐시(KV Cache)만 압축하는 것으로, 정상적인 효율성 개선에 속하며, 효율성 향상이 오히려 더 큰 AI 배치를 자극하여 궁극적으로 메모리 수요를 증가시킬 수 있다고 지적했다.

- 전달 고리 위험 부각: 이 사건은 기존 학술 논문을 시장 내러티브로 재포장할 때, 실험 편향이나 표현 문제가 존재할 경우 금융 시장에 막대한 충격을 줄 수 있는 시스템적 위험을 드러냈다.

원문 저자: Deep Tide TechFlow

구글의 'AI 메모리 사용량을 1/6로 압축했다'고 주장하는 논문이 지난주 마이크론, 샌디스크 등 글로벌 메모리 반도체 주식의 시가총액 9,000억 달러 이상을 증발시키는 계기가 되었습니다.

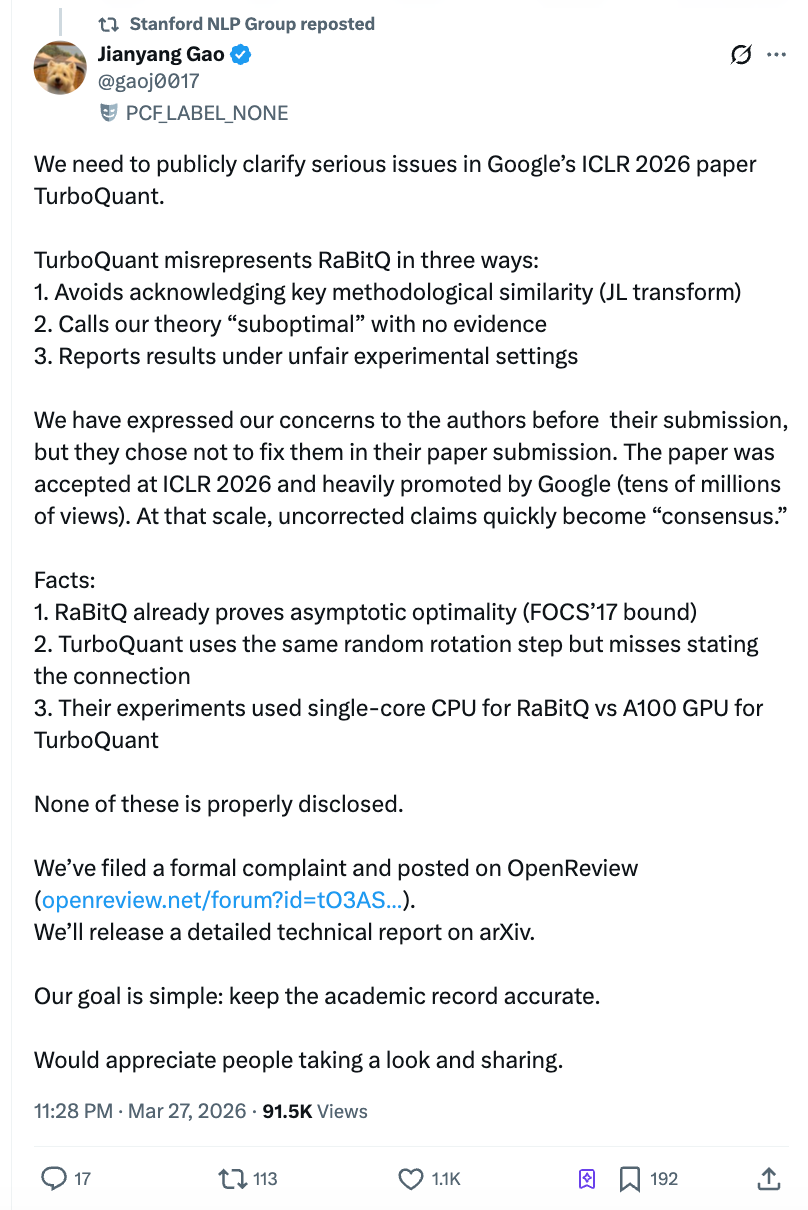

그러나 논문 발표 불과 이틀 만에, 알고리즘이 '압도했다'고 비교 대상이 된 취리히 연방공대 박사후연구원 고젠양이 만 자가 넘는 공개 서한을 발표하며 구글 팀이 실험에서 상대방은 단일 코어 CPU의 Python 스크립트로 테스트하고 자신들은 A100 GPU로 테스트했으며, 투고 전 문제점을 알려줬음에도 수정을 거부했다고 비난했습니다. 중국 지식 플랫폼 'Zhihu'의 조회수는 빠르게 400만을 돌파했고, 스탠포드 NLP 공식 계정이 이를 전파하며 학계와 시장이 동시에 충격에 휩싸였습니다.

이 논란의 핵심 문제는 복잡하지 않습니다: 구글이 공식적으로 대대적으로 홍보하고 글로벌 칩 부문의 공황적 매도세를 직접 촉발시킨 AI 최고 학회 논문이, 발표된 선행 연구를 체계적으로 왜곡하고 의도적으로 조성된 불공정한 실험을 통해 허위의 성능 우위 서사를 구축했는가 하는 점입니다.

TurboQuant가 한 일: AI의 '초안지'를 원래 두께의 6분의 1로 얇게 만들다

대형 언어 모델이 답변을 생성할 때는, 쓰면서 이전에 계산한 내용을 다시 뒤져봐야 합니다. 이러한 중간 결과는 임시로 GPU 메모리에 저장되는데, 업계에서는 이를 'KV 캐시(키-값 캐시)'라고 부릅니다. 대화가 길어질수록 이 '초안지'는 두꺼워지고, GPU 메모리 소비가 커지며 비용도 높아집니다.

구글 연구팀이 개발한 TurboQuant 알고리즘의 핵심 장점은 바로 이 초안지를 원래의 1/6로 압축하면서도 정밀도 손실은 제로, 추론 속도는 최대 8배 향상시켰다고 주장한다는 점입니다. 이 논문은 2025년 4월 학술 사전 인쇄 플랫폼 arXiv에 처음 발표되었고, 2026년 1월 AI 분야 최고 학회인 ICLR 2026에 채택되었으며, 3월 24일 구글 공식 블로그를 통해 재포장되어 홍보되었습니다.

기술적 측면에서 TurboQuant의 접근법은 간단히 설명하면 다음과 같습니다: 먼저 수학적 변환을 사용해 엉망진창인 데이터를 '씻어' 통일된 형식으로 만든 다음, 미리 계산된 최적 압축 테이블을 사용해 하나씩 압축하고, 마지막으로 1비트 오류 수정 메커니즘을 사용해 압축으로 인한 계산 오차를 수정합니다. 커뮤니티의 독립적 구현은 그 압축 효과가 기본적으로 사실임을 검증했으며, 알고리즘 차원의 수학적 기여는 실재합니다.

논란은 TurboQuant가 쓸모가 있느냐 없느냐가 아니라, 구글이 그것이 '경쟁사를 훨씬 능가한다'는 것을 증명하기 위해 무엇을 했느냐에 있습니다.

고젠양의 공개 서한: 세 가지 비난, 하나하나 급소를 찌르다

3월 27일 오후 10시, 고젠양은 Zhihu에 장문의 글을 게시했으며, 동시에 ICLR 공식 심사 플랫폼 OpenReview에 공식 논평을 제출했습니다. 고젠양은 RaBitQ 알고리즘의 제1저자로, 이 알고리즘은 2024년 데이터베이스 분야 최고 학회 SIGMOD에 발표되었으며, 동일한 유형의 문제—고차원 벡터의 효율적 압축—를 해결합니다.

그의 비난은 세 가지로 나뉘며, 각각 이메일 기록과 타임라인으로 뒷받침됩니다.

비난 1: 타인의 핵심 방법을 사용했으면서 논문 전체에 언급하지 않음.

TurboQuant와 RaBitQ의 기술 핵심에는 중요한 공통 단계가 있습니다: 데이터를 압축하기 전에, 먼저 데이터에 '랜덤 회전'을 가하는 것입니다. 이 단계 작업의 역할은 원래 불규칙하게 분포된 데이터를 예측 가능한 균일 분포로 만들어 압축 난이도를 크게 낮추는 것입니다. 이는 두 알고리즘의 가장 핵심적이고 가장 유사한 부분입니다.

TurboQuant 저자들도 심사 회신에서 이 점을 인정했지만, 논문 전체에서 이 방법과 RaBitQ의 연관성을 정면으로 설명한 적이 없습니다. 더 중요한 배경은 다음과 같습니다: TurboQuant의 제2저자인 Majid Daliri는 2025년 1월 고젠양 팀에 자발적으로 연락하여, 그가 RaBitQ 소스 코드를 기반으로 수정한 Python 버전의 디버깅을 도와달라고 요청했습니다. 이메일에는 재현 단계와 오류 정보가 상세히 기술되어 있었습니다—다시 말해, TurboQuant 팀은 RaBitQ의 기술적 세부 사항을 잘 알고 있었습니다.

ICLR의 한 익명 심사위원도 독립적으로 두 연구가 동일한 기술을 사용하고 있음을 지적하며 충분한 논의를 요구했습니다. 그러나 최종판 논문에서 TurboQuant 팀은 논의를 보충하지 않았을 뿐만 아니라, 오히려 원래 본문에 있던 (이미 불완전했던) RaBitQ에 대한 설명을 부록으로 옮겼습니다.

비난 2: 근거 없이 상대방의 이론을 '차선(次善)'이라고 칭함.

TurboQuant 논문은 RaBitQ에 '이론적으로 차선(suboptimal)'이라는 딱지를 직접 붙였으며, 그 이유는 RaBitQ의 수학적 분석이 '상대적으로 조잡'하기 때문이라고 했습니다. 그러나 고젠양은 지적하기를, RaBitQ 확장판 논문은 이미 그 압축 오차가 수학적으로 최적의 경계에 도달했음을 엄격하게 증명했다고 합니다—이 결론은 이론 컴퓨터 과학 최고 학회에 발표되었습니다.

2025년 5월, 고젠양 팀은 여러 차례의 이메일을 통해 RaBitQ 이론의 최적성에 대해 상세히 설명한 바 있습니다. TurboQuant 제2저자 Daliri는 모든 저자들에게 알렸음을 확인했습니다. 그러나 논문은 최종적으로 '차선'이라는 표현을 그대로 유지했으며, 어떤 반박 논거도 제시하지 않았습니다.

비난 3: 실험 비교에서 '왼손으로 상대를 묶고, 오른손으로 칼을 든' 행위.

이는 전체 글에서 가장 파괴력 있는 비난입니다. 고젠양은 지적하기를, TurboQuant 논문이 속도 비교 실험에서 두 층위의 불공정 조건을 중첩시켰다고 합니다:

첫째, RaBitQ 측은 최적화된 C++ 코드(기본적으로 멀티스레드 병렬 처리 지원)를 제공했지만, TurboQuant 팀은 이를 사용하지 않고 자신들이 번역한 Python 버전으로 RaBitQ를 테스트했습니다. 둘째, RaBitQ를 테스트할 때는 단일 코어 CPU를 사용했고 멀티스레딩을 비활성화했으며, 반면 TurboQuant는 NVIDIA A100 GPU를 사용했습니다.

이 두 조건이 중첩된 효과는 다음과 같습니다: 독자들은 'RaBitQ가 TurboQuant보다 수 개의 자릿수만큼 느리다'는 결론을 보게 되지만, 이 결론의 전제가 구글 팀이 상대방의 손발을 묶은 뒤에 경주를 벌인 것이라는 사실을 알 수 없습니다. 논문에는 이러한 실험 조건의 차이를 충분히 공개하지 않았습니다.

구글의 답변: '랜덤 회전은 범용 기술, 모든 논문을 인용할 수는 없다'

고젠양이 공개한 바에 따르면, TurboQuant 팀은 2026년 3월 이메일 회신에서 다음과 같이 밝혔습니다: "랜덤 회전과 Johnson-Lindenstrauss 변환의 사용은 이미 해당 분야의 표준 기술이며, 우리는 이러한 방법을 사용한 모든 논문을 인용할 수는 없습니다."

고젠양 팀은 이것이 논점을 흐리는 것이라고 생각합니다: 문제는 랜덤 회전을 사용한 모든 논문을 인용할 것인지의 여부가 아니라, RaBitQ가 완전히 동일한 문제 설정 하에서 이 방법을 벡터 압축과 결합하고 그 최적성을 증명한 최초의 연구라는 점이며, TurboQuant 논문은 당연히 양자의 관계를 정확하게 기술해야 한다는 것입니다.

스탠포드 NLP 그룹 공식 X 계정이 고젠양의 성명을 전파했습니다. 고젠양 팀은 이미 ICLR OpenReview 플랫폼에 공개 논평을 게시했으며, ICLR 학회 의장 및 윤리 위원회에 공식 불만 사항을 제출했고, 추후 arXiv에 상세 기술 보고서도 발표할 예정입니다.

독립 기술 블로거 Dario Salvati는 분석에서 상대적으로 중립적인 평가를 내렸습니다: TurboQuant는 수학적 방법론에서 확실히 실질적인 기여가 있지만, RaBitQ와의 관계는 논문이 표현한 것보다 훨씬 긴밀합니다.

9,000억 달러 시가총액 증발: 논문 논란과 시장 공황의 중첩

이 학술 논란은 시점이 매우 미묘하게 발생했습니다. 구글이 3월 24일 공식 블로그를 통해 TurboQuant를 발표한 후, 글로벌 메모리 반도체 부문은 맹렬한 매도세에 직면했습니다. CNBC 등 여러 매체 보도에 따르면, 마이크론 테크놀로지는 연속 6거래일 동안 하락하며 누적 하락폭이 20%를 넘었습니다; 샌디스크는 단일 거래일 동안 11% 하락했습니다; 한국 SK하이닉스는 약 6% 하락했고, 삼성전자는 약 5% 하락했으며, 일본 키오시아는 약 6% 하락했습니다. 시장의 공황 논리는 단순무식했습니다: 소프트웨어 압축이 AI 추론 메모리 요구량을 6분의 1로 낮출 수 있다면, 메모리 반도체의 수요 전망은 구조적으로 하향 조정될 것이라는 것이었습니다.

모건 스탠리 애널리스트 Joseph Moore는 3월 26일 연구 보고서에서 이 논리를 반박하며 마이크론과 샌디스크에 대한 '비중확대(增持)' 등급을 유지했습니다. Moore는 지적하기를, TurboQuant가 압축하는 것은 KV 캐시라는 특정 유형의 캐시일 뿐, 전체 메모리 사용량이 아니며, 이를 '정상적인 생산성 개선'으로 규정했습니다. 웰스 파고 애널리스트 Andrew Rocha 역시 제번스의 역설을 인용하며, 효율성 향상으로 비용이 낮아지면 오히려 더 대규모의 AI 배치를 자극하여 궁극적으로 메모리 수요를 끌어올릴 수 있다고 봤습니다.

오래된 논문, 새로운 포장: AI 연구에서 시장 서사로의 전달 경로 위험

기술 블로거 Ben Pouladian의 분석에 따르면, TurboQuant 논문은 2025년 4월에 이미 공개 발표된 것으로, 새로운 연구가 아닙니다. 3월 24일 구글이 공식 블로그를 통해 재포장해 홍보했지만, 시장은 이를 완전히 새로운 돌파구로 간주하고 가격을 책정했습니다. 이러한 '오래된 논문, 새로운 발표' 홍보 전략은 논문에 존재할 수 있는 실험 편향과 중첩되며, AI 연구가 학술 논문에서 시장 서사로 전달되는 경로의 체계적 위험을 반영합니다.

AI 인프라 투자자들에게는, 한 논문이 '수 개의 자릿수'에 달하는 성능 향상을 달성했다고 주장할 때, 먼저 추궁해야 할 것은 벤치마크 비교 조건이 공정한가 하는 점입니다.

고젠양 팀은 문제의 공식적 해결을 계속 추진할 것이라고 명확히 밝혔습니다. 구글 측은 아직 공개 서한의 구체적 비난에 대해 공식적으로 답변하지 않았습니다.