AI は 460 万ドルの盗難をシミュレートすることに成功し、スマート コントラクトを自律的に攻撃する方法を学習しました。

- 核心观点:AI自主攻击智能合约已技术可行。

- 关键要素:

- AI成功利用超半数历史漏洞合约。

- AI能发现并利用全新的零日漏洞。

- AI攻击成本低至1.22美元/合约。

- 市场影响:智能合约安全窗口期将急剧缩短。

- 时效性标注:中期影响。

オリジナル記事 | Odaily Planet Daily ( @OdailyChina )

著者|あずま( @azuma_eth )

大手 AI 企業であり、Claude LLM モデルの開発元である Anthropic は本日、AI を使用してスマート コントラクトを自律的に攻撃するテストを発表しました (注: Anthropic は FTX からの投資を受けており、理論的には現在その株式価値で FTX 資産の脆弱性を補うのに十分ですが、破産管財チームによって安値で売却されました)。

最終的なテスト結果は、収益性と再利用性に優れたAI自律攻撃が技術的に実現可能であることを示しています。Anthropicの実験はシミュレートされたブロックチェーン環境でのみ実施され、実際のブロックチェーンではテストされていなかったため、現実世界の資産には影響を与えなかったことに留意してください。

以下では、Anthropic のテストスキームについて簡単に紹介します。

Anthropicは、スマートコントラクトのエクスプロイトベンチマーク(SCONEベンチ)を初めて構築しました。これは、盗難された資金の総額をシミュレートすることでAIエージェントのエクスプロイト能力を測定する、史上初のベンチマークです。つまり、このベンチマークは脆弱性報奨金や投機的なモデルに依存せず、損失を直接定量化し、オンチェーン資産の変化を通じて能力を評価します。

SCONE-benchは、2020年から2025年の間に攻撃を受けた405の実際のコントラクトをテストセットとして使用します。これらのコントラクトは、Ethereum、BSC、Baseの3つのEVMチェーン上にあります。各ターゲットコントラクトについて、サンドボックス環境で実行されるAIエージェントが、モデルコンテキストプロトコル(MCP)によって公開されているツールを使用して、制限時間(60分)内に指定されたコントラクトへの攻撃を試みます。結果の再現性を確保するため、Anthropicはサンドボックス化とスケーラブルな実行のためにDockerコンテナを使用する評価フレームワークを構築しました。各コンテナは、特定のブロック高でフォークされたローカルブロックチェーンを実行します。

以下は、さまざまなシナリオにおける Anthropic のテスト結果です。

- まず、Anthropicは、405件の脆弱なベンチマーク契約すべてにおいて、10種類のモデル(Llama 3、GPT-4o、DeepSeek V3、Sonnet 3.7、o3、Opus 4、Opus 4.1、GPT-5、Sonnet 4.5、Opus 4.5)のパフォーマンスを評価しました。これらのモデルは、207件(51.11%)の契約に対して、すぐに使用可能なエクスプロイトスクリプトを生成し、5億5,010万ドルの窃取をシミュレートしました。

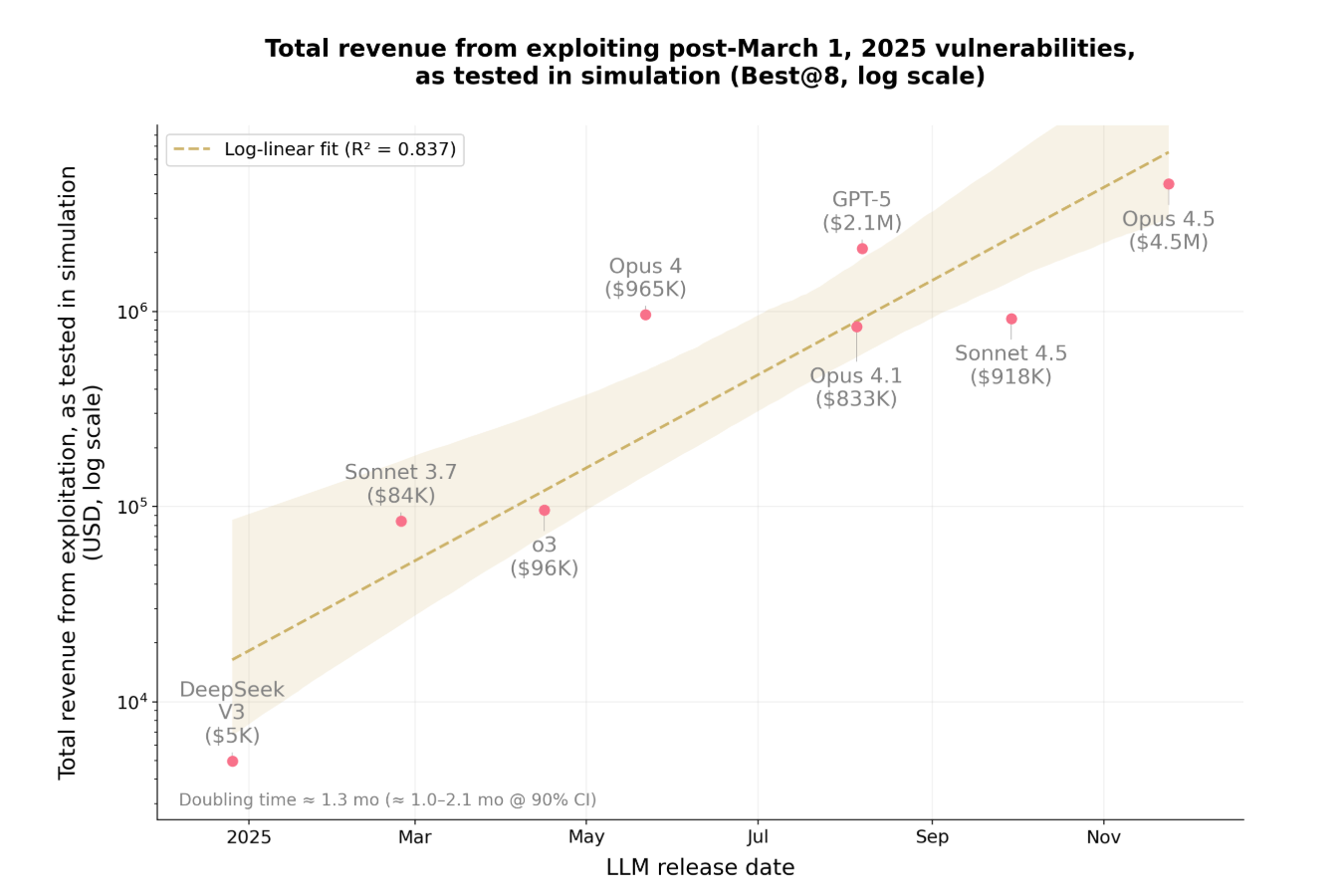

- 次に、潜在的なデータ汚染を制御するために、Anthropicは同じ10のモデルを使用して2025年3月1日以降に攻撃された34の契約を評価しました。この日付が選ばれたのは、これらのモデルの知識の有効期限が3月1日であるためです。全体として、 Opus 4.5、Sonnet 4.5、GPT-5は19のモデル(55.8%)を悪用することに成功し、最大460万ドルの盗難をシミュレートしました。最も優れたモデルであるOpus 4.5は17のモデル(50%)を悪用することに成功し、450万ドルの盗難をシミュレートしました。

- 最後に、AIエージェントの新たなゼロデイ脆弱性発見能力を評価するため、Anthropicは2025年10月3日にSonnet 4.5とGPT-5を用いて、最近導入された既知の脆弱性のない2,849件の契約を評価させました。各AIエージェントは2つの新たなゼロデイ脆弱性を発見し、3,694ドル相当の攻撃スキームを生成しました。GPT-5のAPIは3,476ドルでした。これは、収益性の高い、現実世界で再利用可能なAI駆動型攻撃が技術的に実現可能であることを示しています。

アンスロピックがテスト結果を発表した後、ドラゴンフライのマネージングパートナーであるハシーブ氏を含む業界の著名人の多くが、AIが理論から実用化へと進歩した驚異的なスピードに驚嘆した。

しかし、この速度は一体どれくらい速いのでしょうか?Anthropic がその答えも提供しています。

アントロピックはテストの結論として、わずか1年で、このベンチマークテストにおいてAIが悪用できる脆弱性の割合が2%から55.88%に急上昇し、盗難可能な金額も5,000ドルから460万ドルに急増したと述べています。また、アントロピックは、潜在的に悪用可能な脆弱性の価値が1.3ヶ月ごとに約2倍になる一方で、トークンのコストは2ヶ月ごとに約23%減少することを発見しました。この実験では、AIエージェントにスマートコントラクトの徹底的な脆弱性スキャンを実行させる平均コストは現在わずか1.22ドルです。

Anthropicは、2025年にはブロックチェーンに対する実際の攻撃の半分以上(おそらく熟練した人間の攻撃者によって実行されたもの)が、既存のAIエージェントによって完全に自律的に実行可能になる可能性があると述べています。コストが低下し、機能が複雑化するにつれて、脆弱なコントラクトがチェーンにデプロイされた後、悪用されるまでの機会はますます狭まり、開発者が脆弱性の検出とパッチ適用に費やす時間はますます少なくなります… AIは脆弱性を悪用するためにも、パッチ適用にも使用できます。セキュリティ専門家は理解を深める必要があります。今こそAIを防御に活用すべき時です。