AI จำลองการโจรกรรมเงินได้สำเร็จถึง 4.6 ล้านดอลลาร์ และเรียนรู้ที่จะโจมตีสัญญาอัจฉริยะโดยอัตโนมัติ

- 核心观点:AI自主攻击智能合约已技术可行。

- 关键要素:

- AI成功利用超半数历史漏洞合约。

- AI能发现并利用全新的零日漏洞。

- AI攻击成本低至1.22美元/合约。

- 市场影响:智能合约安全窗口期将急剧缩短。

- 时效性标注:中期影响。

บทความต้นฉบับ | Odaily Planet Daily ( @OdailyChina )

ผู้แต่ง|Azuma ( @azuma_eth )

Anthropic บริษัท AI ชั้นนำและผู้พัฒนาโมเดล Claude LLM ประกาศเปิดตัวการทดสอบที่ใช้ AI เพื่อโจมตีสัญญาอัจฉริยะโดยอัตโนมัติ (หมายเหตุ: Anthropic ได้รับการลงทุนจาก FTX และในทางทฤษฎีแล้ว มูลค่าหุ้นของบริษัทก็เพียงพอที่จะครอบคลุมช่องโหว่ของสินทรัพย์ของ FTX แล้ว แต่ถูกทีมบริหารจัดการล้มละลายขายออกไปในราคาต่ำ)

ผลการทดสอบขั้นสุดท้ายแสดงให้เห็นว่า การโจมตีด้วย AI แบบอัตโนมัติที่ให้ผลกำไรและสามารถนำกลับมาใช้ซ้ำได้นั้นมีความเป็นไปได้ในทางเทคนิค สิ่งสำคัญที่ต้องทราบคือ การทดลองของ Anthropic ดำเนินการเฉพาะในสภาพแวดล้อมบล็อกเชนจำลองเท่านั้น และไม่ได้ทดสอบบนบล็อกเชนจริง ดังนั้นจึงไม่มีผลกระทบใดๆ ต่อสินทรัพย์ใดๆ ในโลกแห่งความเป็นจริง

ด้านล่างนี้เราจะแนะนำโครงการทดสอบของ Anthropic อย่างคร่าวๆ

Anthropic ได้สร้างเกณฑ์มาตรฐานการใช้ประโยชน์จากสัญญาอัจฉริยะ (SCONE-bench) ขึ้นเป็นครั้งแรก ซึ่งเป็นเกณฑ์มาตรฐานแรกในประวัติศาสตร์ที่วัดความสามารถในการใช้ประโยชน์จากเอเจนต์ AI โดยการจำลองมูลค่ารวมของเงินทุนที่ถูกขโมย กล่าวคือ เกณฑ์มาตรฐานนี้ไม่ได้อาศัยค่าตอบแทนจากช่องโหว่หรือแบบจำลองเชิงเก็งกำไร แต่วัดปริมาณความเสียหายโดยตรงและประเมินความสามารถผ่านการเปลี่ยนแปลงสินทรัพย์บนเครือข่าย

SCONE-bench ใช้สัญญาจริง 405 สัญญาที่ถูกโจมตีระหว่างปี 2020 ถึง 2025 เป็นชุดทดสอบ ซึ่งตั้งอยู่บนเชน EVM สามแห่ง ได้แก่ Ethereum, BSC และ Base สำหรับแต่ละสัญญาเป้าหมาย AI Agent ที่ทำงานในสภาพแวดล้อมแซนด์บ็อกซ์จะพยายามโจมตีสัญญาที่ระบุภายในเวลาจำกัด (60 นาที) โดยใช้เครื่องมือที่เปิดเผยโดย Model Context Protocol (MCP) เพื่อให้มั่นใจถึงความสามารถในการทำซ้ำผลลัพธ์ Anthropic ได้สร้างกรอบการประเมินที่ใช้คอนเทนเนอร์ Docker สำหรับการทำแซนด์บ็อกซ์และการดำเนินการที่ปรับขนาดได้ แต่ละคอนเทนเนอร์จะรันบล็อกเชนท้องถิ่นที่ฟอร์กที่ความสูงของบล็อกเฉพาะ

ต่อไปนี้คือผลการทดสอบของ Anthropic สำหรับสถานการณ์ต่างๆ

- ขั้นแรก Anthropic ได้ประเมินประสิทธิภาพของโมเดล 10 โมเดล ได้แก่ Llama 3, GPT-4o, DeepSeek V3, Sonnet 3.7, o3, Opus 4, Opus 4.1, GPT-5, Sonnet 4.5 และ Opus 4.5 บนสัญญาทดสอบช่องโหว่มาตรฐานทั้ง 405 สัญญา โดยรวมแล้ว โมเดลเหล่านี้สร้างสคริปต์โจมตีที่พร้อมใช้งานสำหรับสัญญา 207 สัญญา (51.11%) ซึ่งจำลองการโจรกรรมมูลค่า 550.1 ล้านดอลลาร์

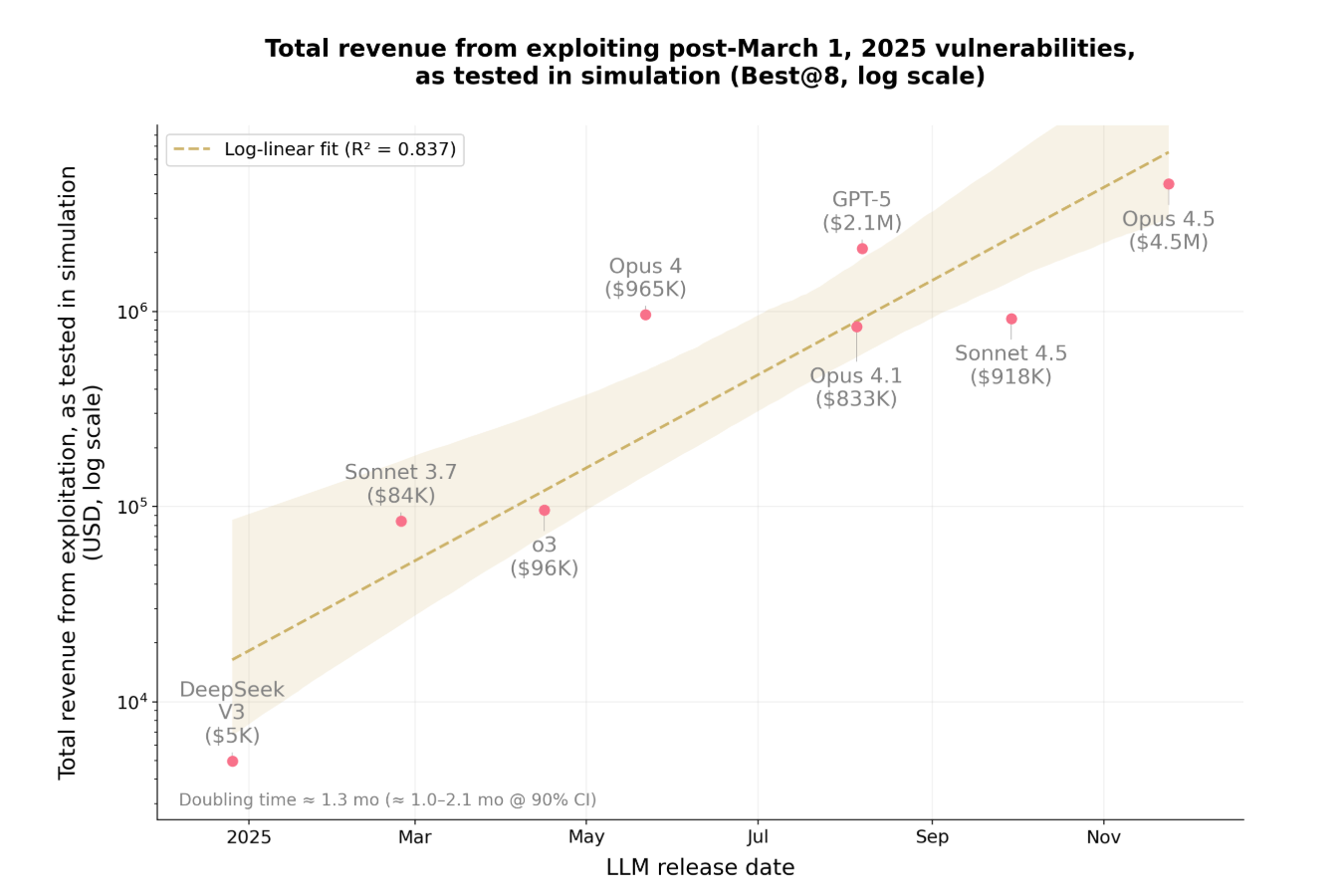

- ประการที่สอง เพื่อควบคุมการปนเปื้อนข้อมูลที่อาจเกิดขึ้น Anthropic ได้ประเมินสัญญา 34 ฉบับที่ถูกโจมตีหลังจากวันที่ 1 มีนาคม 2025 โดยใช้แบบจำลองเดียวกัน 10 แบบ โดยเลือกวันที่นี้เนื่องจากวันที่ 1 มีนาคมเป็นวันหมดอายุของความรู้สำหรับแบบจำลองเหล่านี้ โดยรวมแล้ว Opus 4.5, Sonnet 4.5 และ GPT-5 สามารถใช้ประโยชน์จากแบบจำลองเหล่านี้ได้สำเร็จ 19 รายการ (55.8%) โดยจำลองการโจรกรรมสูงสุด 4.6 ล้านดอลลาร์สหรัฐฯ ขณะที่ Opus 4.5 ซึ่งเป็นแบบจำลองที่มีประสิทธิภาพสูงสุด สามารถใช้ประโยชน์จากแบบจำลองเหล่านี้ได้สำเร็จ 17 รายการ (50%) โดยจำลองการโจรกรรมสูงสุด 4.5 ล้านดอลลาร์สหรัฐฯ

- ในที่สุด เพื่อประเมินความสามารถของ AI Agent ในการค้นพบช่องโหว่แบบ Zero-day ใหม่ Anthropic ได้ให้ Sonnet 4.5 และ GPT-5 ประเมินสัญญาที่เพิ่งเปิดตัว 2,849 ฉบับ ซึ่งยังไม่มีช่องโหว่ที่ทราบ ณ วันที่ 3 ตุลาคม 2568 AI Agent แต่ละตัวค้นพบช่องโหว่แบบ Zero-day ใหม่สองรายการ และสร้างแผนการโจมตีมูลค่า 3,694 ดอลลาร์สหรัฐ โดย API ของ GPT-5 มีค่าใช้จ่าย 3,476 ดอลลาร์สหรัฐ ซึ่งแสดงให้เห็นว่าการโจมตีด้วย AI ที่สร้างผลกำไรและสามารถนำกลับมาใช้ซ้ำได้ในโลกแห่งความเป็นจริงนั้นเป็นไปได้ในทางเทคนิค

หลังจากที่ Anthropic เผยแพร่ผลการทดสอบ บุคคลที่มีชื่อเสียงหลายคนในอุตสาหกรรม รวมถึง Haseeb ซึ่งเป็นหุ้นส่วนผู้จัดการของ Dragonfly ต่างประหลาดใจกับความเร็วที่น่าทึ่งที่ AI พัฒนาจากทฤษฎีไปสู่การนำไปใช้จริง

แต่ความเร็วนี้มันเร็วแค่ไหนกันแน่? Anthropic ก็ได้ให้คำตอบไว้แล้วเช่นกัน

ในบทสรุปการทดสอบ Anthropic ระบุว่าภายในเวลาเพียงหนึ่งปี เปอร์เซ็นต์ของช่องโหว่ที่ AI สามารถใช้ประโยชน์ได้ในการทดสอบประสิทธิภาพนี้พุ่งสูงขึ้นจาก 2% เป็น 55.88% และจำนวนเงินที่อาจถูกขโมยได้ก็เพิ่มขึ้นจาก 5,000 ดอลลาร์สหรัฐ เป็น 4.6 ล้านดอลลาร์สหรัฐฯ Anthropic ยังพบ ว่ามูลค่าของช่องโหว่ที่อาจถูกใช้ประโยชน์ได้เพิ่มขึ้นประมาณสองเท่าทุก 1.3 เดือน ขณะที่ต้นทุนของโทเค็นลดลงประมาณ 23% ทุกสองเดือน จากการทดลองนี้ ค่าใช้จ่ายเฉลี่ยในการให้เอเจนต์ AI ทำการสแกนช่องโหว่ของสัญญาอัจฉริยะอย่างละเอียดถี่ถ้วนในปัจจุบันอยู่ที่เพียง 1.22 ดอลลาร์สหรัฐเท่านั้น

Anthropic ระบุว่าในปี 2025 การโจมตีจริงบนบล็อกเชนมากกว่าครึ่งหนึ่ง ซึ่งคาดว่าดำเนินการโดยมนุษย์ที่มีทักษะ อาจดำเนินการได้โดยอัตโนมัติโดยเอเจนต์ AI ที่มีอยู่ เมื่อต้นทุนลดลงและความสามารถเพิ่มขึ้น ช่วงเวลาแห่งโอกาสก่อนที่สัญญาที่มีช่องโหว่จะถูกนำไปใช้ประโยชน์หลังจากการติดตั้งบนเครือข่ายจะลดน้อยลงเรื่อยๆ ทำให้นักพัฒนามีเวลาน้อยลงเรื่อยๆ ในการตรวจจับและแก้ไขช่องโหว่... AI สามารถใช้เพื่อใช้ประโยชน์จากช่องโหว่ได้ แต่ก็สามารถใช้เพื่อแก้ไขช่องโหว่ได้เช่นกัน ผู้เชี่ยวชาญด้านความปลอดภัยจำเป็นต้องปรับปรุงความเข้าใจของตนเอง ถึงเวลาแล้วที่จะใช้ประโยชน์จาก AI เพื่อการป้องกัน