황런쉰이 지목했다? SN3 한 달 만에 5배 상승, 대체 무슨 일이 있었나?

- 핵심 관점: Bittensor 서브넷 SN3(Templar)가 무허가 분산형 컴퓨팅 파워 네트워크를 통해 720억 개의 파라미터를 가진 대형 모델 Covenant-72B를 성공적으로 훈련시켰으며, 그 성능은 Meta의 2023년 LLaMA-2-70B와 비슷한 수준으로 평가받고 있습니다. 이는 분산형 AI 훈련 분야의 중요한 기술적 돌파구로 간주되어 시장에서 관련 토큰에 대한 강한 관심을 불러일으켰습니다.

- 핵심 요소:

- 기술적 돌파구: Covenant-72B는 MMLU 벤치마크 테스트에서 67.1점을 기록하여 분산형 훈련 트랙에서 두각을 나타냈으며, 대형 모델의 분산형 훈련 가능성을 입증했습니다.

- 무허가 참여: 화이트리스트 심사 없이 70개 이상의 독립 노드가 훈련에 참여하여 진정한 분산형 참여를 실현했습니다.

- 핵심 메커니즘: SparseLoCo 기술을 통한 효율적인 그래디언트 압축(압축률 146배 이상)과 Gauntlet 메커니즘을 통한 노드 기여도 품질 검증으로 분산형 훈련의 효율성과 인센티브 문제를 해결했습니다.

- 시장 반응: SN3 토큰은 지난 한 달 동안 440% 이상 상승했으며, 이에 대한 내러티브 가치가 Bittensor 메인넷 토큰 TAO로 전파되어 가격이 빠르게 상승하는 데 기여했습니다.

- 업계적 의의: 이 성과는 AI 훈련의 자원 독점 구조에 도전하며 분산형 AI 개발의 정치경제적 잠재력을 보여주었지만, 모델 성능은 현재 최첨단 모델과 여전히 세대 차이가 있습니다.

- 잠재적 문제점: 모델 벤치마크 비교의 시의성, 고품질 데이터 확보의 병목 현상, 무허가 참여로 인한 보안 및 규제 준수 위험, 그리고 토큰 가치와 모델 산출물 지속성 간의 강한 연관성 위험 등이 포함됩니다.

원문 저자: KarenZ, Foresight News

2026년 3월 20일, All-In 벤처캐스트 팟캐스트에서 이례적인 대화가 오갔다.

벤처 캐피털 거물인 Chamath Palihapitiya가 엔비디아 CEO 젠슨 황에게 화제를 던졌다. 그는 Bittensor에 '상당히 미친 기술적 성과'를 이룬 프로젝트가 있다고 말했는데, 분산 컴퓨팅 파워로 인터넷 상에서 대규모 언어 모델을 훈련시켰으며, 이 과정은 완전히 탈중앙화되어 어떠한 중앙화된 데이터 센터도 참여하지 않았다고 설명했다.

젠슨 황은 피하지 않았다. 그는 이 사건을 'Folding@home의 현대판'에 비유했는데, 이는 2000년대에 일반 사용자들이 유휴 컴퓨팅 파워를 기여하여 단백질 접힘 문제를 함께 해결했던 분산 프로젝트였다.

이보다 4일 전인 3월 16일, Anthropic의 공동 창립자인 Jack Clark도 AI 연구 진전 보고서를 발표하면서 이 돌파구를 상당한 분량으로 소개하고 인용했다: Bittensor 생태계 서브넷 Templar(SN3)가 720억 개 파라미터 대형 모델(Covenant 72B)의 분산 훈련을 완료했으며, 모델 성능은 Meta가 2023년에 출시한 LLaMA-2와 비슷한 수준이다.

Jack Clark은 해당 장의 제목을 '분산 훈련을 통한 AI 정치경제학 도전'으로 정했으며, 분석에서 이것은 지속적으로 추적할 가치가 있는 기술이라고 강조했다. 그는 미래를 상상할 수 있다고 말했다: 엣지 디바이스 AI는 탈중앙화 훈련으로 생산된 모델을 대량으로 채택하고, 클라우드 AI는 계속해서 독점적인 대형 모델을 운영할 것이다.

시장의 반응은 약간 늦었지만 매우 격렬했다: SN3은 지난 한 달 동안 440% 이상, 지난 2주 동안 340% 이상 상승했으며, 시가총액은 1억 3천만 달러에 달했다. 서브넷의 내러티브 폭발은 직접적으로 TAO의 구매 압력으로 전달된다. 이 때문에 TAO도 급등하여 한때 377달러에 도달했고, 지난 한 달 동안 두 배로 증가했으며, 완전 희석 시가총액(FDV)은 약 75억 달러에 달했다.

문제가 생겼다: SN3은 도대체 무엇을 했는가? 왜 스포트라이트를 받게 되었는가? 분산 훈련과 탈중앙화 AI의 가치 내러티브는 어떻게 진화할 것인가?

그 72B 모델

이 질문에 답하려면 먼저 SN3이 제출한 성적표를 똑바로 봐야 한다.

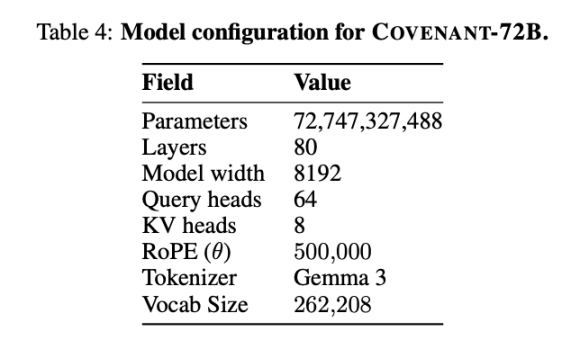

2026년 3월 10일, Covenant AI 팀은 arXiv에 기술 보고서를 발표하여 Covenant-72B 훈련 완료를 공식 발표했다. 이는 720억 개 파라미터의 대규모 언어 모델로, 70개 이상의 독립적인 노드 피어들(매 라운드 약 20개 노드 동기화, 각 노드에 B200 8장 장착)이 약 1조 1천억 개의 토큰 코퍼스에서 720억 개 파라미터 모델의 사전 훈련을 완료했다.

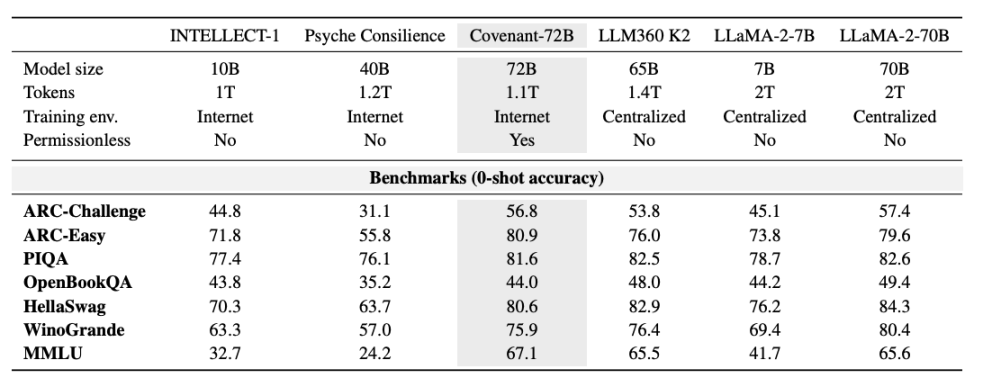

Templar는 벤치마크 테스트 측면에서 일부 데이터를 제시했는데, 물론 비교 대상인 LLaMA-2-70B는 Meta가 2023년에 출시한 대형 모델이다. Anthropic 공동 창립자 Jack Clark이 말했듯이, Covenant-72B는 2026년 기준으로는 다소 구식일 수 있다. Covenant-72B의 MMLU 점수 67.1점은 대략 Meta가 2023년에 출시한 LLaMA-2-70B(65.6점)에 대응한다.

그러나 2026년의 최첨단 모델들—GPT 시리즈, Claude, Gemini 모두—은 이미 수십만 개의 GPU에서 1000억 개를 훨씬 넘는 파라미터로 훈련을 완료했으며, 추론, 코드, 수학 능력의 격차는 백분율이 아닌 수준의 문제다. 이 현실적인 격차는 시장 정서에 묻혀서는 안 된다.

하지만 '개방형 인터넷 상의 분산 컴퓨팅 파워로 훈련되었다'는 전제로 환산하면 의미는 완전히 달라진다.

비교를 해보자: 동일하게 탈중앙화 훈련을 받은 INTELLECT-1(Prime Intellect 팀 제작, 100억 개 파라미터)의 MMLU 점수는 32.7점이다. 화이트리스트 참가자들 사이에서 진행된 또 다른 분산 훈련 프로젝트인 Psyche Consilience(400억 개 파라미터)의 점수는 24.2점이다. Covenant-72B는 72B 규모, 67.1 MMLU 점수로 탈중앙화 훈련 트랙에서 눈에 띄는 숫자다.

더 중요한 것은 이번 훈련이 '무허가' 방식이라는 점이다. 누구나 충분한 컴퓨팅 파워를 가지고 있다면 참여 노드로 연결될 수 있으며, 사전 심사나 화이트리스트가 필요하지 않다. 70개 이상의 독립 노드가 모델 업데이트에 참여했으며, 전 세계 각지에서 연결되어 컴퓨팅 파워를 기여했다.

젠슨 황이 말한 것과 말하지 않은 것

그 팟캐스트 대화의 세부 사항을 복원하는 것은 외부의 이번 '지지' 해석을 바로잡는 데 도움이 될 것이다.

Chamath Palihapitiya는 대화 중 Bittensor의 기술적 성과를 젠슨 황에게 제시하며, 분산 컴퓨팅 파워로 Llama 모델을 훈련시켰다고 묘사했고, 그 과정이 '완전히 분산되었으며 동시에 상태를 유지했다'고 설명했다. 젠슨 황의 응답은 이것을 '현대판 Folding@home'에 비유했으며, 오픈소스와 독점 모델이 병행 공존해야 할 필요성에 대해 논의를 펼쳤다.

주목할 점은, 젠슨 황이 Bittensor의 토큰이나 어떠한 투자적 함의도 직접 언급하지 않았으며, 탈중앙화 AI 훈련에 대해 더 논의하지도 않았다는 것이다.

Bittensor 서브넷과 SN3 이해하기

SN3의 돌파구를 이해하려면 먼저 Bittensor와 그 서브넷의 운영 논리를 명확히 해야 한다. 간단히 말해, Bittensor는 하나의 AI 공개 블록체인 및 플랫폼으로 볼 수 있으며, 각 서브넷은 독립적인 'AI 생산 라인'에 해당한다. 각각 핵심 임무를 명확히 하고 인센티브 메커니즘을 설계하여 협력하여 탈중앙화 AI 생태계를 구성한다.

그 운영 프로세스는 명확하고 탈중앙화되어 있다: 서브넷 소유자는 서브넷 목표를 정의하고 인센티브 모델을 작성한다. 채굴자(마이너)는 서브넷에서 컴퓨팅 파워를 제공하고 AI 관련 작업(추론, 훈련, 저장 등)을 완료한다. 검증자(밸리데이터)는 채굴자의 기여에 점수를 매기고, 그 점수를 Bittensor 합의 레이어에 업로드한다. 최종적으로, Bittensor의 Yuma 합의 알고리즘은 각 서브넷이 누적한 보상에 따라 서브넷 참여자들에게 해당 수익을 분배한다.

현재 Bittensor에는 128개의 서브넷이 있으며, 추론, 서버리스 AI 클라우드 서비스, 이미지, 데이터 라벨링, 강화 학습, 저장, 컴퓨팅 등 다양한 AI 작업을 포괄한다.

SN3은 그 중 하나의 서브넷이다. 이는 애플리케이션 레이어 래핑을 하지 않으며, 기성 대형 모델 API를 임대하지 않고, AI 산업 체인에서 가장 비싸고 가장 폐쇄적인 핵심 링크 중 하나인 대형 모델 사전 훈련 자체를 직접 겨냥했다.

SN3은 Bittensor 네트워크를 이용하여 이기종 컴퓨팅 자원의 분산 훈련을 조정하고, 인센티브 기반 분산 대형 모델 훈련을 통해 값비싼 중앙화된 슈퍼컴퓨터 클러스터 없이도 강력한 기초 모델을 훈련시킬 수 있음을 증명하고자 한다. 핵심 매력은 '평등화'에 있다—중앙화 훈련의 자원 독점을 깨고, 일반 개인이나 중소 기관도 대형 모델 훈련에 참여할 수 있게 하며, 동시에 분산 컴퓨팅 파워를 통해 훈련 비용을 낮추는 것이다.

SN3 발전을 추진하는 핵심 세력은 Templar이며, 그 배후 연구 팀은 Covenant Labs이다. 이 팀은 또한 다른 두 개의 서브넷을 동시에 운영하고 있다: Basilica(SN39, 컴퓨팅 서비스 전담)와 Grail(SN81, RL 사후 훈련 및 모델 평가 전담). 세 개의 서브넷은 수직 통합을 이루어 대형 모델의 사전 훈련부터 정렬 최적화까지의 전 과정을 완전히 커버하며, 탈중앙화 대형 모델 훈련의 완전한 생태계를 구축한다.

구체적으로, 채굴자는 컴퓨팅 자원을 기여하여 그래디언트 업데이트(모델 파라미터의 조정 방향과 강도)를 네트워크에 업로드한다. 검증자는 각 채굴자의 기여 품질을 평가하여 오차 개선 정도에 따라 온체인 점수를 부여한다. 결과는 보상 가중치를 결정하며, 자동으로 분배되어 제3자를 신뢰할 필요가 없다.

인센티브 메커니즘 설계의 핵심은 보상이 단순한 컴퓨팅 파워 출석이 아닌 '당신의 기여가 모델을 얼마나 좋게 만들었는가'와 직접적으로 연결된다는 점이다. 이는 근본적으로 탈중앙화 시나리오에서 가장 어려운 문제인 '채굴자가 태만하게 행동하는 것을 어떻게 방지할 것인가'를 해결한다.

그렇다면 Covenant-72B는 통신 효율성과 인센티브 호환 문제를 어떻게 해결했는가?

서로를 신뢰하지 않고, 하드웨어가 다르며, 네트워크 품질이 고르지 않은 수십 개의 노드가 동일한 모델을 협력하여 훈련하도록 하는 데는 두 가지 도전이 있다: 첫째는 통신 효율성으로, 표준 분산 훈련 솔루션은 노드 간 고대역폭, 저지연 연결을 요구한다. 둘째는 인센티브 호환성으로, 악의적인 노드가 잘못된 그래디언트를 제출하는 것을 어떻게 방지할 것인가? 각 참여자가 성실히 훈련하고 다른 사람의 결과를 표절하지 않도록 어떻게 보장할 것인가?

SN3은 두 가지 핵심 구성 요소로 이 두 문제를 해결했다: SparseLoCo와 Gauntlet.

SparseLoCo는 통신 효율성 문제를 해결한다. 기존의 분산 훈련은 매 단계마다 완전한 그래디언트를 동기화해야 하며 데이터 양이 방대하다. SparseLoCo가 채택한 방안은: 각 노드가 로컬에서 30단계의 내부 최적화(AdamW)를 실행한 후, 생성된 '의사 그래디언트'를 압축한 후 다른 노드에 업로드한다. 압축 방식에는 Top-k 희소화(가장 중요한 그래디언트 구성 요소만 보존), 오류 피드백(버려진 부분을 저장하여 다음 라운드에 누적), 그리고 2비트 양자화가 포함된다. 최종 압축 비율은 146배를 초과한다.

다시 말해, 원래 100MB를 전송해야 했던 것을 이제는 1MB 미만으로 줄였다.

이로 인해 시스템은 일반 인터넷(업로드 110Mbps, 다운로드 500Mbps)의 대역폭 제한 하에서도 컴퓨팅 활용률을 약 94.5%로 유지할 수 있었다—20개 노드, 노드당 B200 8개, 라운드당 통신 소요 시간은 단 70초였다.

Gauntlet은 인센티브 호환성 문제를 해결한다. 이는 Bittensor 블록체인(Subnet 3)에서 실행되며, 각 노드가 제출한 의사 그래디언트의 품질을 검증하는 역할을 한다. 구체적인 방식은: 소량의 데이터 배치를 사용하여 '이 노드의 그래디언트를 적용했을 때 모델 손실이 얼마나 감소했는가'를 테스트하며, 그 결과를 LossScore라고 부른다. 동시에 시스템은 노드가 자신에게 할당된 데이터로 훈련하고 있는지도 확인한다—만약 한 노드가 무작위 데이터에서의 손실 개선이 자신에게 할당된 데이터에서의 개선보다 더 좋다면, 음수 점수를 받게 된다.

최종적으로, 매 라운드 훈련에서는 가장 높은 점수를 받은 노드의 그래디언트만 집계에 참여시키고, 나머지 노드는 해당 라운드에서 탈락한다. 초과된 참여자는 언제든지 보충되어 시스템이 견고하게 유지되도록 한다. 전체 훈련 과정에서 평균적으로 라운드당 16.9개 노드의 그래디언트가 집계에 포함되었으며, 누적 참여한 고유 노드 ID는 70개를 넘었다.

탈중앙화 AI의 가치 내러티브, 근본적인 전환을 겪고 있다

기술 및 업계 시각에서 이 사건을 볼 때, Covenant-72B가 대표하는 방향에는 몇 가지 실제적인 의미가 있다.

첫째, '분산 훈련은 소형 모델에만 적합하다'는 가정을 깼다. 비록 최첨단 모델과는 아직 거리가 멀지만, 이 방향의 확장 가능성을 증명했다.

둘째, 무허가 참여는 실제로 가능하다. 이 점은 과소평가되었다. 이전의 분산 훈련 프로젝트들은 화이트리스트에 의존했다—심사를 거친 참여자만 컴퓨팅 파워를 기여할 수 있었다. SN3의 이번 훈련에서는 충분한 컴퓨팅 파워를 가진 누구나 연결할 수 있었으며, 검증 메커니즘이 악의적인 기여를 걸러