48時間の禁止後、ClaudeがApp Storeで1位に

- 核心的な見解:OpenAIが国防総省と契約を結んだことで、ユーザーが大規模にChatGPTをボイコットしClaudeに転向した。これは単なる商業競争ではなく、AnthropicとOpenAIのAI軍事利用に関する安全哲学の根本的な相違を浮き彫りにしている。前者は法的な空白地帯に自発的に制限を設けようとし、後者は現行の法的枠組みに依存している。

- 重要な要素:

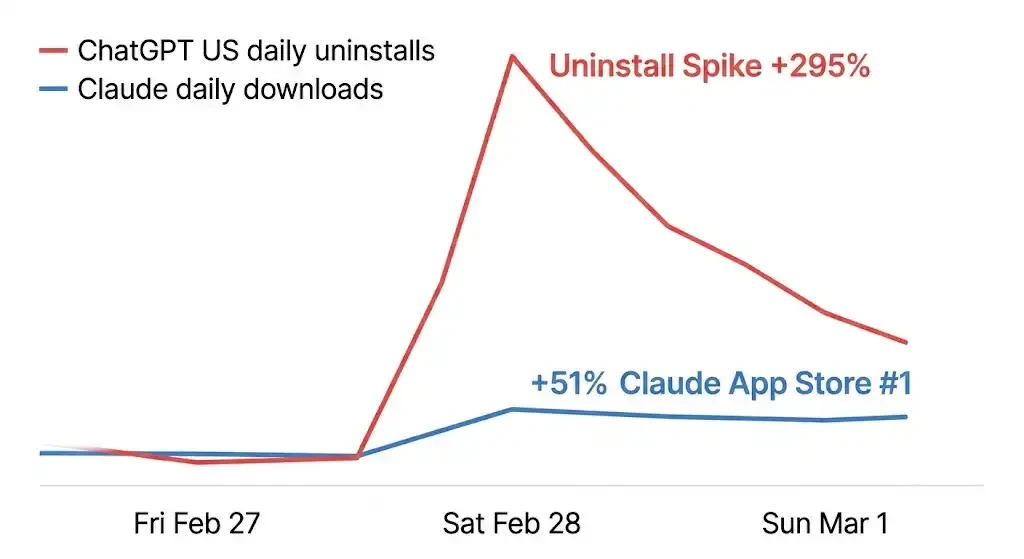

- 市場の激しい反応:この出来事により、ChatGPTの米国における1日あたりのアンインストール数は295%急増し、1つ星レビューは775%増加した。一方、Claudeのダウンロード数は51%増加し、App Store無料ランキングで首位に立った。

- 製品による的確な反撃:Anthropicはタイミングよく「記憶移行ツール」をリリースし、記憶機能を無料開放したことで、ユーザーがChatGPTから切り替えるコストを大幅に削減した。

- 契約条項の相違:論争の核心は、国防総省がAIを「すべての合法的な目的」に使用できることを要求した点にある。Anthropicはこの条項を拒否し、2つの具体的な禁止事項を書き込むことを主張したため契約を失った。一方、OpenAIはこの条項を受け入れたが、契約内に同じ保護条項があると主張している。

- 安全哲学の違い:OpenAIのボトムラインは「違法なことはしない」であるのに対し、Anthropicのボトムラインは「法律で禁止されていないが、すべきでないと考えられること」まで拡張されている。これが異なる商業的選択と内部論争を引き起こしている。

- ブランド・ナラティブの両面性:Anthropicは長らく「文明レベルのリスクを防止する」というナラティブを強調してきた。これにより軍との契約を失い、セキュリティリスクとしてリストアップされたが、同じナラティブが多くの一般ユーザーの道徳的支持を意外にも獲得し、ユーザー数の急増を後押しした。

- 商業的影響の格差:Anthropicが失った軍との契約の価値は約2億ドルと推定されるが、その年間収益は140億ドルに達し、最近の評価額は3800億ドルである。これは、ユーザー増加による潜在的な価値が契約損失をはるかに上回っていることを示している。

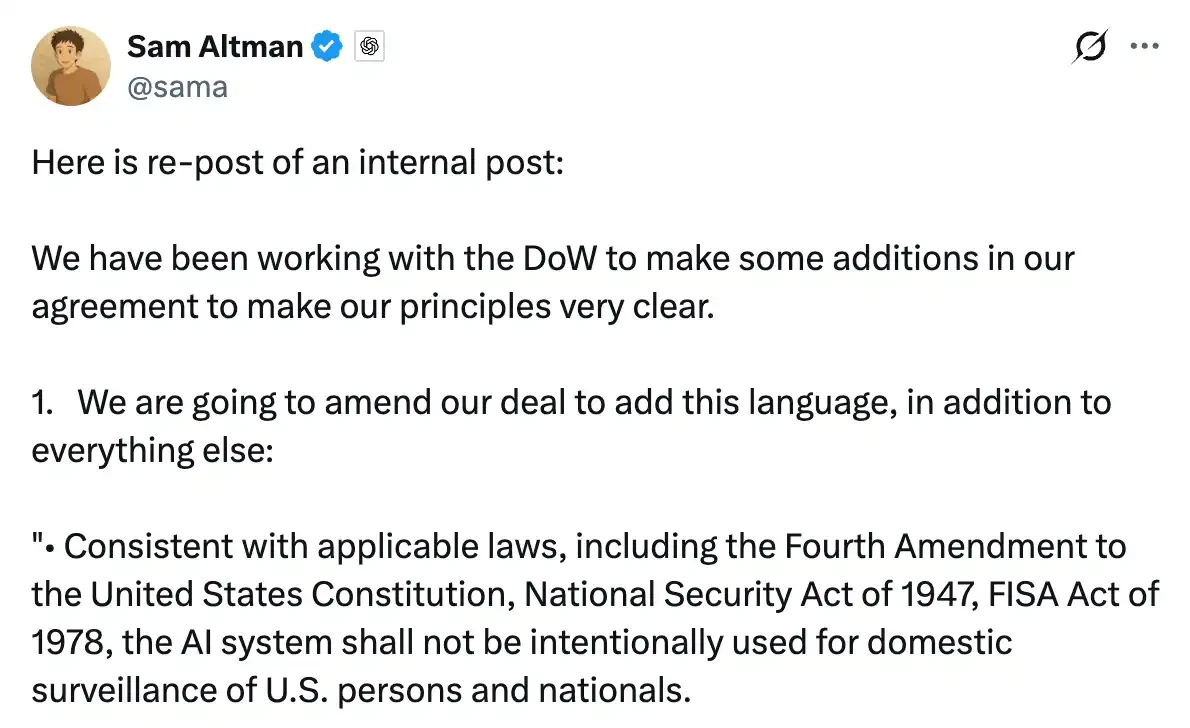

土曜日の朝、オルトマンはXで内部文書のスクリーンショットを転送した。

それは彼が木曜日の夜にOpenAIの従業員に書いた手紙で、会社が国防総省と話し合っていること、彼が「緊張緩和」に役立ちたいと願っていることを述べていた。彼はこの手紙を転送し、ここ数日で何が起こったかを公に説明したいという主旨の数行の説明を添えた。

彼がこのツイートを投稿した時、Claudeはすでに米国App Storeの無料ランキングで1位に上昇していた。その前日まで、ChatGPTがその座にあった。

Sensor Towerのデータはその後数時間に起こったことを記録している:土曜日単日で、ChatGPTの米国におけるアンインストール数は平日比で295%急増し、1つ星レビューは775%急増した。一方、Claudeのダウンロード数は単日で51%上昇した。Redditには「Cancel ChatGPT」(ChatGPTをボイコット)という投稿の波が押し寄せ、ユーザーはサブスクリプション解約のスクリーンショットを晒し、コメントには「fastest install of my life」と書く者もいた。QuitGPT.orgというウェブサイトが立ち上がり、150万人がすでに行動を起こしたと主張した。

月曜日、流入するユーザーが多すぎて、Claudeは大規模なダウンタイムを発生させた。連邦政府によって「サプライチェーン安全保障リスク」に指定されたあの会社は、ユーザーが殺到したため、サーバーが圧迫されたのだ。

精密な製品による反撃

アンインストールの波が高まったのと同じ日、Anthropicは記憶移行ツールをリリースした。

機能自体は複雑ではない。ユーザーはプロンプトの一部をChatGPTにコピーし、保存されているすべての記憶と好みを出力させ、それをClaudeに貼り付けると、Claudeがワンクリックでインポートし、あなたがChatGPTを離れたところから続けることができる。公式サイトのキャッチコピーはたった一言:「switch to Claude without starting over」。

このツールのタイミングが、その最も重要な特性だ。

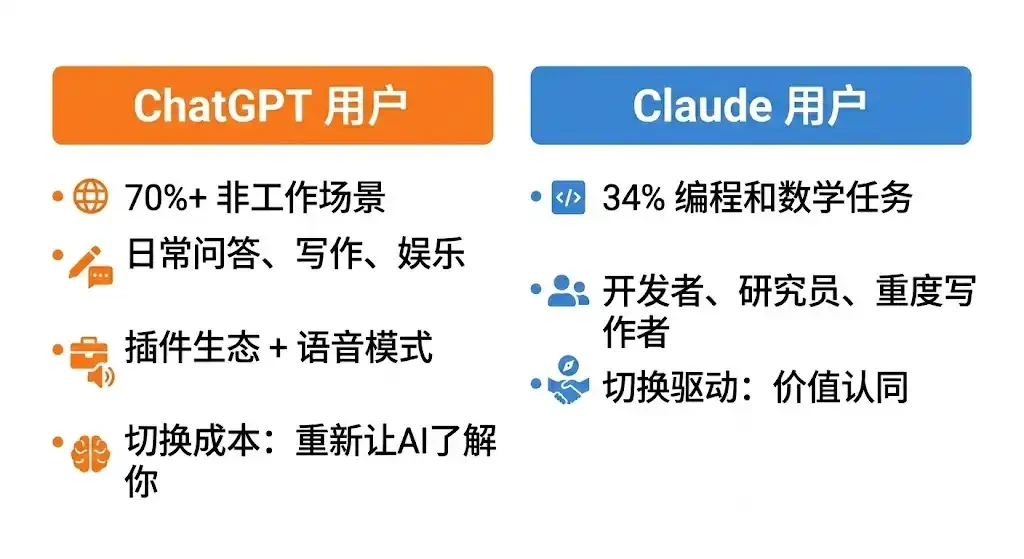

OpenAI自身のデータによると、2025年半ばまでに、ChatGPTユーザーの70%以上が仕事以外のシナリオで使用しており、日常的な質疑応答、執筆、娯楽、情報検索が含まれている。それは多くの人が初めて触れるAIであり、膨大なプラグインエコシステム、Voice Mode、そして深く統合されたサードパーティアプリケーションによって日常生活に組み込まれている。この種のユーザーの切り替えコストは単なる「新しいアプリをダウンロードする」ことではなく、あなたを知らないAIにゼロからあなたが誰であるかを理解させることだ。記憶の蓄積は、これまで残るための最強の理由だった。

Anthropic自身の調査データによると、Claudeの使用シナリオは高度に集中している。プログラミングと数学タスクが34%を占め、単一最大のカテゴリーであり、教育と科学研究は過去1年間で最も成長が速い方向性だ。コアユーザーは開発者、研究者、そしてヘビーライターであり、この人々はより理性的で、明確な価値判断があれば、移行コストが十分に低ければ、ツールを交換しやすい。

記憶移行ツールはこのコストを最低限に抑えた。同時に、Anthropicは記憶機能を無料ユーザーに全面開放すると発表した。この機能は以前、有料ユーザー専用だった。

しかし、この波で流入したユーザーのうち、かなりの部分は元々のClaudeのターゲットユーザーではない。

ソーシャルメディア上のフィードバックから見ると、ChatGPTから移行してきた大量の一般ユーザーが、初めてClaudeを使用した時の反応は往々にして:「これは違う。」Claudeの回答はより深みがあり、何でも「はい」と言うのではなく、自ら考えを巡らせて返してくると感じる人もいる。執筆においてより洗練されているが、画像を生成せず、Voice Modeのようなインタラクティブな体験もないと気づく人もいる。

「より従順なChatGPTの代替品」を探していたが、Claudeの個性がより強く、適応に時間がかかると気づいた人もいる。TechRadarの移行ガイドがこの数日間で大量にシェアされ、タイトルは「I wish someone had told me these things」で、記事の核心メッセージは:ClaudeとChatGPTの使用ロジックは根本的に異なり、前者はより立場を持つ仕事仲間に、後者はより万能なアシスタントに似ている。

この違いは本来、二つの製品それぞれのポジショニングだったが、この事件によって予期せず拡大された。ユーザーは道徳的立場からClaudeに殺到し、そして彼らの予想とは異なる製品、より厳格で、より境界線を持つAIを発見した。これは本来、離脱の理由になり得たが、この特別なタイミングでは、むしろ残る理由になった:あなたはある会社の立場を信じれば、その製品のロジックを受け入れやすくなる。

リリース後数日で、Anthropicはデータを公表した:無料アクティブユーザー数は1月比で60%以上増加し、日次新規登録数は4倍になった。Claudeは一時、アクセス過多でダウンし、数千人のユーザーがログインできないと報告したが、数時間以内に復旧した。

契約書の中の三文字:OpenAIは何を言い、何をしたのか

Anthropicは、AIモデルを米軍の機密ネットワークに配備した最初の商業企業であり、協力はPalantirを通じて行われ、契約価値は約2億ドルとされる。しかし過去数ヶ月、双方の関係は悪化し続けた。論争の核心は一つの条項にある:国防総省はAIモデルが「すべての合法的な目的」に使用可能であり、いかなる条件も付加しないことを要求した。Anthropicは逆に、二つの例外、すなわち米国市民に対する大規模監視への使用と、完全自律兵器システムへの使用を禁止することを明記することを主張した。

2月20日前後、報道によると、Anthropicの幹部が1月の米軍によるベネズエラ大統領マドゥロ拘束作戦におけるClaudeの使用法について、協力相手のPalantirに質問を提起し、軍部はこれに強い不満を示した。木曜日、国防総省は最後通告を下し、Dario Amodeiにその日の午後5時までに回答を求めた。

Amodeiは期限前に声明を発表し、会社は現在の条項を受け入れることができないと述べた。「軍事用途に反対するからではなく、少数のケースにおいて、AIが民主主義的価値を守るのではなく破壊する可能性があると信じるからだ」。トランプは直ちに連邦機関に対し6ヶ月以内にAnthropic製品の全面使用停止を命じ、Hegsethは同社を「サプライチェーン安全保障リスク」に指定した。このラベルは通常、外国の対抗企業に使用される。契約はこれにより終了した。

空いたポジションには、すぐに誰かが埋めた。その日の遅く、OpenAIは国防総省との契約を発表した。オルトマンは木曜日の内部文書の中で、立場はまだ明確で、これはすでに「業界全体の問題」であり、OpenAIとAnthropicは同じ「レッドライン」、すなわち大規模監視と自律兵器に反対することを共有していると書いた。金曜日、合意が成立し、軍の機密ネットワークにモデルを配備することになり、クラウド上でのみ実行可能と制限され、エンジニアが監視に派遣され、契約書には同じ二つの制限が明記されたと述べた。

オルトマンはその後Xで質問を受け付け、数時間にわたって回答した。誰かが彼に尋ねた:なぜ国防総省はOpenAIを受け入れたのに、Anthropicを禁止したのか?彼の回答は:「Anthropicは、適用される法律を引用するよりも、契約書の具体的な禁止条項に焦点を当てているようだ。我々は法律を引用することに満足している。」

この言葉は方法論の違いを語っているが、それはこの事柄の真の論争の所在を開いた。

Anthropicが交渉を決裂させた鍵は、国防総省が書き込むことを主張したフレーズ:「all lawful purposes」(すべての合法的目的)にAIシステムを使用できるというものだ。Anthropicが拒否した理由は、このフレーズが国家安全保障の文脈では固定された境界線ではないからだ。現行法は多くの面でAIの能力に追いついておらず、「合法的」の範囲は政府自身の解釈によって決定されることになる。OpenAIはこのフレーズに署名し、同時に契約書で同じ保護について話し合ったと主張した。

法律専門家はその後、OpenAIが公開した契約条項を分析し、二つの具体的な表現の問題点を指摘した。

監視条項には、システムは米国市民の個人情報に対する「無制限の(unconstrained)」監視に使用してはならないと書かれている。民主主義と技術センターの政策担当副社長、Samir Jainは、この表現は「制限付きの」監視バージョンが許可されていることを意味すると指摘した。そして現行法の枠組みでは、政府はデータブローカーから市民の位置記録、閲覧履歴、金融データを合法的に購入し、AIにこれらのデータを分析させることが完全に可能であり、技術的には「違法監視」を構成しない。Amodeiはその後CBSのインタビューで挙げた例はまさにこれだった。

兵器条項には、システムは「法律、規制、または部門の方針が人間の制御を要求する場合」に自律兵器に使用してはならないと書かれている。この限定語は、制限が他の規定がすでに人間の制御を要求している前提でのみ発効することを意味し、拘束力は完全に既存の方針に依存している。そして国防総省は自らの内部方針をいつでも修正する権限を持つ。法律学者のCharles BullockはXで、契約書の兵器条項はDoD指令3000.09に依存しており、この指令は指揮官が「適切なレベルの人間の判断」を保持することを要求しているが、この「適切なレベル」は柔軟に解釈可能な基準だと書いた。

OpenAIはこれらの疑問に対し、モデルはクラウド上でのみ実行可能であり、これがアーキテクチャ上、兵器システムに直接統合される可能性を排除していると応じた。契約書には具体的な法的根拠も明記されており、文字通りの禁止条項よりも拘束力がある。なぜなら法律はすでに検証された枠組みだからだ。オルトマン自身も質疑応答で認めた:「もし将来この戦いを戦う必要があれば、戦うだろう。しかし、これは明らかに我々にいくつかのリスクをもたらす。」

これは、一社が妥協をいとわず、もう一社が原則を守るという問題ではない。これは二つの根本的に異なる安全保障哲学だ。OpenAIのボトムラインは:違法なことはしない。Anthropicのボトムラインは:法律がまだ禁止していないが、私はすべきでないと思うことも、しない。

この相違は、OpenAI内部にも亀裂を残した。先週、複数のOpenAI従業員が公開書簡に署名し、Anthropicの立場を支持し、同社をサプライチェーンリスクに指定することに反対した。アライメント研究者のLeo Gaoは、会社の契約が十分な保護を提供しているかどうかを公に疑問視した。OpenAIサンフランシスコオフィスの外の歩道には、チョークで書かれた批判的な落書きが現れた。Anthropicオフィスの外には支持のメッセージが残された。オルトマンが数時間にわたって行ったXでの質疑応答は、相当程度、自社内部の、本来Anthropic側に立っていた人々に向けられていた。

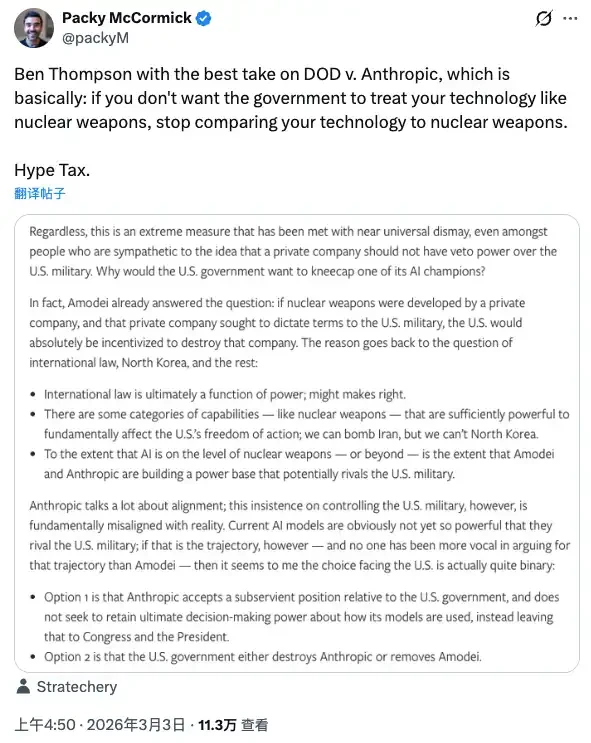

同じナラティブの二つの結果

Anthropicは長年、「文明レベルのリスクを防ぐ」という枠組みで自らの安全保障ミッションを定義し、最先端AIの潜在的脅威を核兵器と同等に扱い、自らをこの防衛線の門番として位置づけてきた。このナラティブはそのブランドの核心であり、資本市場で信頼を獲得する方法でもあった。

テクノロジー評論家のPacky McCormickは、この事件が発酵している間、Ben Thompsonの一つの概念:Hype Tax(誇大広告税)を引用した。意味は、もし極端なナラティブを使って自らの影響力を構築するなら、そのナラティブが真の権力に遭遇した時、あなたはそれに対して代償を払わなければならないということだ。あなたがAI技術を核兵器に例えれば、政府は核兵器に対する方法であなたを扱う。

Anthropicはこのナラティブに対して代償を払った:一つの契約を失い、安全保障リスクに指定され、大統領に名指しされ、同社のすべての製品が6ヶ月以内に連邦システムから排除されるよう要求された。

しかし、同じ週末、同じナラティブが別の次元で全く逆の効果を生み出した。

一般ユーザーが見たのは、契約条項でも、法律解釈でも、安全保障哲学の論争でもなかった。彼らが見たのは:一社が「ノー」と言い、政府から追い出された。もう一社が「イエス」と言い、契約を獲得した。彼らは自らの判断フレームワークで選択を行い、295%のアンインストール増加、App Store1位、ダウンしたサーバーという結果になった。

これはAI業界史上、稀に見る消費者の集団的道徳的表明だ。

Anthropicはこの件に一銭も広報予算をかけなかった。Amodeiの声明は控えめな表現で、ユーザーの支持を呼びかけず、OpenAIを名指しせず、自らを殉教者として描かなかった。しかし結果は起こった。

ここに注目すべき詳細がある:ユーザーがClaudeに殺到させたあの事件の本質は、OpenAIが商業的に完全に合理的なことを行い、競合他社が禁止され、契約が宙に浮いた時に合意に署名し、同じ保護条項について話し合ったと主張したことだ。オルトマンも明確に、彼がこうしたのは一部、緊張を緩和し、Anthropicに対するさらなる損害を防ぐためだと述べた。

動機がどうであれ、結果はOpenAIが契約を獲得し、Anthropicのユーザーが