五角大樓的最後通牒:Anthropic的72小時生死劫

- 核心觀點:Anthropic正面臨嚴峻的身份與商業危機,其長期標榜的「負責任AI」品牌承諾,在政府壓力、市場競爭和自身發展需求的多重夾擊下迅速瓦解,公司行為出現多重矛盾。

- 關鍵要素:

- 五角大樓發出最後通牒,要求其解除Claude的軍事應用限制(包括自主武器瞄準),否則將取消2億美元合同並可能將其列入「供應鏈風險」黑名單。

- Anthropic發布新版「負責任擴展政策」(RSP 3.0),刪除了「若安全措施不到位則暫停訓練更強模型」的核心承諾,轉向更靈活的框架。

- 公司公開指控三家中國AI公司對Claude進行「工業級蒸餾攻擊」,但自身因使用盜版書籍訓練數據而支付了15億美元和解金,被指雙重標準。

- 在獲得3800億美元高估值和巨額融資的同時,其安全敘事正從「差異化優勢」滑向「政治負資產」,面臨品牌與商業現實的激烈衝突。

- 公司行為邏輯矛盾:既以安全為由拒絕軍方部分要求、指控他國威脅,又為競爭刪除了自身關鍵安全護欄,暴露了「安全」敘事的商業品牌本質。

原文作者:Ada,深潮 TechFlow

2月24日,星期二。華盛頓,五角大廈。

Anthropic CEO Dario Amodei 坐在國防部長 Pete Hegseth 對面。據 NPR 和 CNN 多家媒體援引知情人士透露,會面的氣氛「禮貌」,但內容一點都不客氣。

Hegseth 給了他一個最後通牒:週五下午 5:01 之前,放開 Claude 的軍事使用限制,允許五角大廈將其用於「所有合法用途」,包括自主武器瞄準和國內大規模監控。

否則取消 2 億美元合約。啟動《國防生產法》,強制徵用。將 Anthropic 列為「供應鏈風險」,這等同於把它歸入俄羅斯和中國敵對實體的黑名單。

同一天,Anthropic 發布了第三版「負責任擴展政策」(RSP 3.0),悄悄刪掉了公司成立以來最核心的一條承諾:如果無法保證安全措施到位,就不訓練更強大的模型。

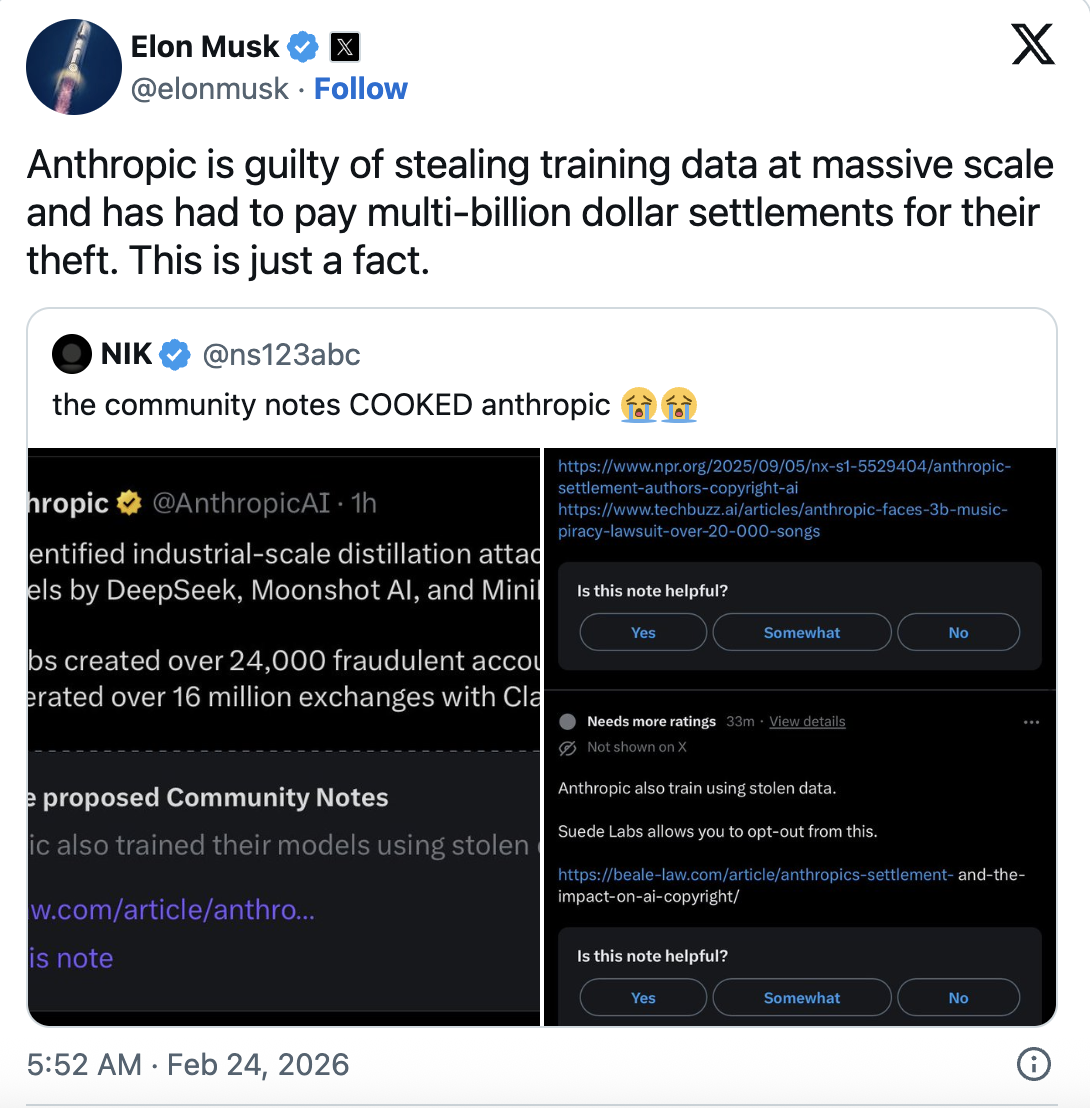

也是同一天,Elon Musk 在 X 上發帖說:「Anthropic 大規模竊取訓練數據,這是事實。」同時,X 的社群筆記補充了 Anthropic 因使用盜版書籍訓練 Claude 而支付 15 億美元和解金的報導。

七十二小時內,這家自稱有「靈魂」的 AI 公司,同時扮演了三個角色:安全殉道者、智慧財產權竊賊、五角大廈的叛徒。

哪個才是真的?

也許都是。

五角大廈的「要么服從,要么滾」

故事的第一層很簡單。

Anthropic 是第一家獲得美國國防部機密級訪問權限的 AI 公司。去年夏天拿到的合約,上限 2 億美元。OpenAI、Google、xAI 隨後也各拿了同等規模的合約。

據 Al Jazeera 報導,Claude 曾被用於今年 1 月的一次美軍行動。報導稱該行動涉及委內瑞拉總統馬杜羅的綁架。

但 Anthropic 劃了兩條紅線:不支持全自主武器瞄準,不支持對美國公民的大規模監控。Anthropic 認為,人工智慧的可靠性不足以操控武器,而且目前還沒有任何法律法規規範人工智慧在大規模監控中的應用。

五角大廈不買賬。

白宮 AI 顧問 David Sacks 去年 10 月在 X 上公開指控 Anthropic「以恐懼為武器,搞監管俘獲」。

競爭對手已經跪了。OpenAI、Google、xAI 都同意讓軍方將其 AI 用於「所有合法場景」。Musk 的 Grok 本週剛獲批進入機密系統。

Anthropic 是最後一個站著的。

截至發稿,Anthropic 在最新發表的聲明中表示,他們並沒有打算讓步。但週五 5:01 的大限,已經近在眼前。

一位匿名的前司法部與國防部聯絡員對 CNN 表示了困惑:「你怎麼能同時宣布一家公司是『供應鏈風險』,又強迫這家公司為你的軍隊工作?」

好問題,但這不在五角大廈考慮範圍之內。他們在乎的是,如果 Anthropic 不妥協,將採取強制手段,或者,成為華盛頓棄兒。

「蒸餾攻擊」:一場打臉式的控訴

2月23日,Anthropic 發了一篇措辭激烈的部落格,指控三家中國 AI 公司對 Claude 進行了「工業級蒸餾攻擊」。

被告是 DeepSeek、Moonshot AI、MiniMax。

Anthropic 指控它們通過 2.4 萬個偽造帳戶,對 Claude 發起超過 1600 萬次互動,定向提取 Claude 在智慧體推理、工具調用和程式設計方面的核心能力。

Anthropic 把這件事定性為國家安全威脅,聲稱蒸餾後的模型「不太可能保留安全護欄」,可能被威權政府用於網路攻擊、虛假資訊和大規模監控。

敘事很完美,時機也很完美。

恰好在 川普政府剛剛放寬對華晶片出口管制之後,恰好在 Anthropic 需要為自己的晶片出口管制遊說立場尋找彈藥的時候。

但是 Musk 開了一槍:「Anthropic 大規模竊取訓練數據,還為此支付了數十億美元和解金。這是事實。」

AI 基礎設施公司 IO.Net 聯合創始人 Tory Green 表示:「你們用全網的數據訓練自己的模型,然後別人用你們的公共 API 學習你們,就叫『蒸餾攻擊』了?」

Anthropic 把蒸餾叫「攻擊」,但這件事在 AI 行業是家常便飯。OpenAI 用它壓縮 GPT-4,Google 用它優化 Gemini,連 Anthropic 自己也在做。唯一的區別是,這次被蒸的是它自己。

據新加坡南洋理工大學 AI 教授 Erik Cambria 對 CNBC 表示:「合法使用和惡意利用之間的邊界往往是模糊的。」

更諷刺的是,Anthropic 剛為使用盜版書籍訓練 Claude 支付了 15 億美元和解金。它用全網的數據訓練模型,然後指控別人用它的公開 API 學習它。這不是雙標,這是三標。

Anthropic 本想扮演受害者,結果被扒成了被告。

安全承諾的拆除:RSP 3.0

就在與五角大廈對峙、與矽谷互撕的同一天,Anthropic 發布了第三版負責任擴展政策。

Anthropic 首席科學家 Jared Kaplan 在接受媒體採訪時表示:「我們覺得停止訓練 AI 模型對任何人都沒有幫助。在 AI 快速發展的背景下,單方面做出承諾……而競爭對手在全速推進,這沒有意義。」

換句話說,別人不講武德,我們也不裝了。

RSP 1.0 和 2.0 的核心是一條硬性承諾,如果模型的能力超過了安全措施的覆蓋範圍,就暫停訓練。這條承諾讓 Anthropic 在 AI 安全圈獲得了獨一無二的聲譽。

但 3.0 刪了。

取而代之的是一個更「靈活」的框架,即把 Anthropic 自己能做的安全措施和需要全行業協作的安全建議分成兩條軌道。每 3-6 個月發一份風險報告。請外部專家審閱。

聽起來很負責?

來自非營利組織 METR 的獨立審查員 Chris Painter 在看完政策早期草案後對表示:「這說明 Anthropic 認為需要進入『分診模式』,因為評估和緩解風險的方法跟不上能力增長的速度。這更多地證明了社會對 AI 潛在災難性風險沒有做好準備。」

根據 TIME 報導,Anthropic 花了將近一年時間內部討論這次改寫,CEO Amodei 和董事會全票通過。官方說法是,原來的政策設計初衷是推動行業共識,結果行業根本沒跟上。川普政府對人工智慧發展採取了放任自流的態度,甚至試圖廢除各州的相關法規。聯邦層面的人工智慧法律遙遙無期。儘管在 2023 年建立全球治理框架似乎還有可能,但三年過去了,這扇門顯然已經關閉。

一位長期跟蹤 AI 治理的匿名研究員說得更直接:「RSP 是 Anthropic 最值錢的品牌資產。刪掉暫停訓練承諾,就像一家有機食品公司悄悄把『有機』兩個字從包裝上撕下來,然後告訴你他們現在的檢測更透明了。」

3800 億估值下的身份撕裂

2月初,Anthropic 以 3800 億美元估值完成 300 億美元融資,亞馬遜是錨定投資者。自成立以來,就實現了 140 億美元的年化收入。過去三年,這一數字每年都增長超過 10 倍。

同時,五角大廈威脅將其列入黑名單。Musk 公開指控其數據盜竊。自己的核心安全承諾被刪除。Anthropic 的人工智慧安全負責人 Mrinank Sharma 辭職後在 X 上寫道:「世界正處於危險之中。」

矛盾?

或許矛盾是 Anthropic 的基因。

這家公司由前 OpenAI 高管創立,因為他們擔心 OpenAI 在安全問題上走得太快。然後他們自己建了一家公司,以更快的速度建構更強大的模型,同時告訴全世界這些模型有多危險。

商業模式可以概括為一句話,我們比任何人都更害怕 AI,所以你應該出錢讓我們來造 AI。

這個敘事在 2023-2024 年完美運轉。AI 安全是華盛頓的熱詞,Anthropic 是最受歡迎的遊說者。

2026 年,風向變了。

「woke AI」成了攻擊標籤,州級 AI 監管法案被白宮阻擊,Anthropic 支持的加州 SB 53 雖然簽署成法,但聯邦層面一片荒蕪。

Anthropic 的安全牌,正在從「差異化優勢」滑向「政治負資產」。

Anthropic 在做一個複雜的平衡術,它需要足夠「安全」來維持品牌,又需要足夠「靈活」來不被市場和政府拋棄。問題是,兩頭的容忍空間都在縮小。

安全敘事,還值多少錢?

把三件事疊在一起看,畫面就清楚了。

指控中國公司蒸餾 Claude,是為了強化晶片出口管制的遊說敘事。為了在軍備競賽中不掉隊,刪除了安全暫停承諾。拒絕五角大廈的自主武器要求,是為了保住最後一層道德外衣。

每一步都有邏輯,但每一步之間又互相矛盾。

你不能一邊說中國公司「蒸餾」你的模型會危害國家安全,一邊刪掉防止你自己的模型失控的承諾。如果模型真的那麼危險,你應該更謹慎,而不是更激進。

除非你是 Anthropic。

在 AI 行業,身份不是由你的聲明定義的,是由你的資產負債表定義的。Anthropic 的「安全」敘事,本質上是一種品牌溢價。

在 AI 軍備競賽的早期,這種溢價值錢。投資者願意為「負責任的 AI」支付更高的估值,政府願意為「可信賴的 AI」開綠燈,客戶願意為「更安全的 AI」付費。

但 2026 年,這個溢價正在蒸發。

Anthropic 現在面臨的,不是「要不要妥協」的選擇題,而是「先向誰妥協」的排序題。向五角大廈妥協,品牌受損。向競爭對手妥協,安全承諾作廢。向投資者妥協,兩頭都得讓。

週五下午 5:01,Anthropic 會交出它的答案。

但無論答案是什麼,有一件事已經確定:那個曾經靠「我們和 OpenAI 不一樣」立足的 Anthropic,正在變得和所有人一樣。

身份危機的終點,往往是身份的消失。