หลังจากถูกแบน 48 ชั่วโมง Claude ขึ้นอันดับ 1 ใน App Store

- มุมมองหลัก: การที่ OpenAI ลงนามสัญญากับกระทรวงกลาโหมสหรัฐฯ ทำให้ผู้ใช้จำนวนมากต่อต้าน ChatGPT และหันไปใช้ Claude ซึ่งไม่เพียงแต่เป็นการแข่งขันทางธุรกิจเท่านั้น แต่ยังสะท้อนความแตกต่างทางปรัชญาด้านความปลอดภัยในการใช้ AI ทางทหารระหว่าง Anthropic และ OpenAI อย่างชัดเจน: อดีตพยายามกำหนดขีดจำกัดเชิงรุกในพื้นที่ที่กฎหมายยังว่างเปล่า ในขณะที่หลังพึ่งพากรอบกฎหมายที่มีอยู่

- องค์ประกอบสำคัญ:

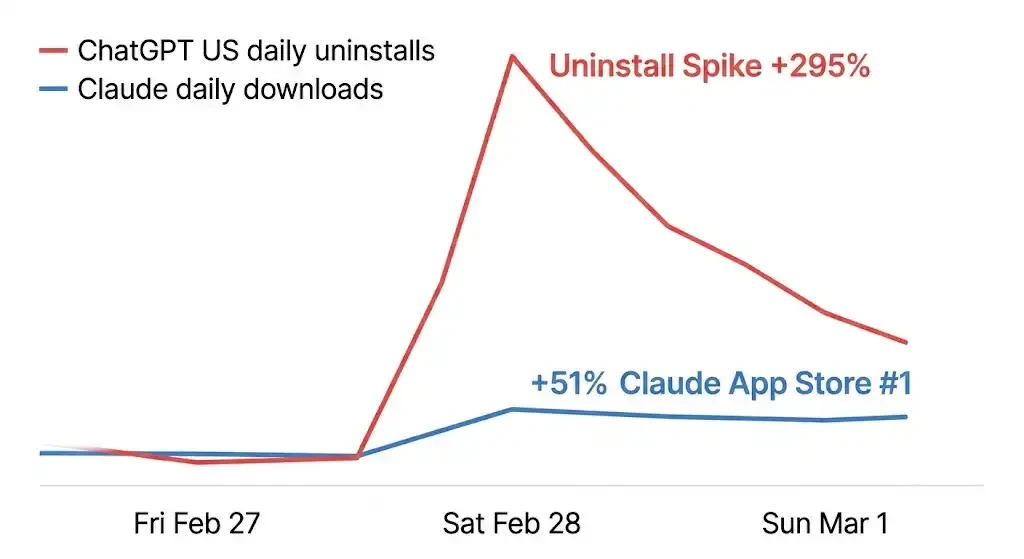

- ปฏิกิริยาตลาดรุนแรง: เหตุการณ์ทำให้จำนวนการถอนการติดตั้ง ChatGPT ในสหรัฐฯ เพิ่มขึ้น 295% ต่อวัน ความคิดเห็น 1 ดาวเพิ่มขึ้น 775% ในขณะที่จำนวนการดาวน์โหลด Claude เพิ่มขึ้น 51% และขึ้นสู่ตำแหน่งสูงสุดในชาร์ตแอปฟรีของ App Store

- การตอบโต้ผลิตภัณฑ์อย่างแม่นยำ: Anthropic เปิดตัว "เครื่องมือโอนย้ายความทรงจำ" ทันเวลาและเปิดฟังก์ชันความจำให้ใช้ฟรี ซึ่งลดต้นทุนการเปลี่ยนจาก ChatGPT อย่างมาก

- ความแตกต่างในเงื่อนไขสัญญา: จุดขัดแย้งหลักคือกระทรวงกลาโหมต้องการให้ AI สามารถใช้เพื่อ "วัตถุประสงค์ที่ถูกกฎหมายทั้งหมด" Anthropic สูญเสียสัญญาเพราะปฏิเสธข้อกำหนดนี้และยืนกรานที่จะเขียนข้อห้ามสองข้อที่เฉพาะเจาะจง ในขณะที่ OpenAI ยอมรับข้อกำหนดแต่ยืนยันว่าสัญญามีการป้องกันที่เหมือนกัน

- ความแตกต่างทางปรัชญาด้านความปลอดภัย: ขีดจำกัดของ OpenAI คือ "ไม่ทำสิ่งผิดกฎหมาย" ในขณะที่ขีดจำกัดของ Anthropic ขยายไปถึง "สิ่งที่กฎหมายไม่อาจห้ามแต่เห็นว่าไม่ควรทำ" ซึ่งนำไปสู่ทางเลือกทางธุรกิจและความขัดแย้งภายในที่แตกต่างกัน

- สองด้านของเรื่องเล่าแบรนด์: Anthropic มักเน้นเรื่องเล่าเรื่อง "ป้องกันความเสี่ยงระดับอารยธรรม" ซึ่งทำให้สูญเสียสัญญากองทัพและถูกจัดเป็นความเสี่ยงด้านความปลอดภัย แต่เรื่องเล่าเดียวกันกลับได้รับความสนับสนุนทางศีลธรรมจากผู้ใช้ทั่วไปจำนวนมากโดยไม่คาดคิด และช่วยให้ผู้ใช้เพิ่มขึ้นอย่างรวดเร็ว

- ผลกระทบทางธุรกิจแตกต่างกันมาก: สัญญากองทัพที่ Anthropic สูญเสียมีมูลค่าประมาณ 200 ล้านดอลลาร์ แต่รายได้ต่อปีสูงถึง 140 พันล้านดอลลาร์ และการประเมินมูลค่าล่าสุดอยู่ที่ 3.8 ล้านล้านดอลลาร์ ซึ่งบ่งชี้ว่ามูลค่าที่อาจเกิดขึ้นจากการเติบโตของผู้ใช้มีมากกว่าความสูญเสียจากสัญญามาก

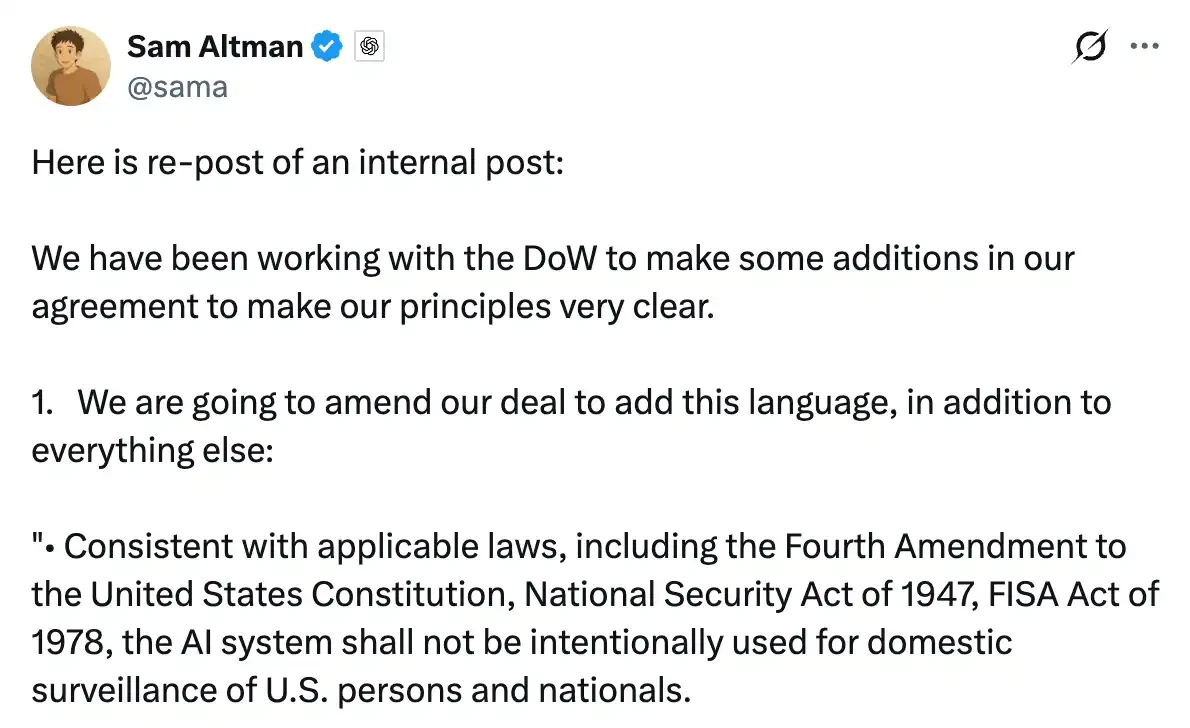

เช้าวันเสาร์ Altman ได้รีโพสต์ภาพหน้าจอของจดหมายภายในบน X

จดหมายนี้เขาเขียนถึงพนักงาน OpenAI ในคืนวันพฤหัสบดี กล่าวว่าบริษัทกำลังเจรจากับเพนตากอน เขาหวังว่าจะช่วย "บรรเทาสถานการณ์" เขารีโพสต์จดหมายนี้ พร้อมคำอธิบายสั้นๆ ใจความคือต้องการอธิบายต่อสาธารณะว่าเกิดอะไรขึ้นในช่วงไม่กี่วันที่ผ่านมา

ขณะที่เขาโพสต์ทวีตนี้ Claude ขึ้นถึงอันดับ 1 ในชาร์ตแอปฟรีของ App Store สหรัฐฯ แล้ว ในวันก่อนหน้า ChatGPT ยังครองตำแหน่งนั้นอยู่

ข้อมูลจาก Sensor Tower บันทึกสิ่งที่เกิดขึ้นในชั่วโมงต่อมา: ในวันเสาร์วันเดียว ยอดถอนการติดตั้ง ChatGPT ในสหรัฐฯ พุ่งสูงขึ้น 295% เมื่อเทียบกับวันปกติ ความคิดเห็น 1 ดาวเพิ่มขึ้น 775% ในเวลาเดียวกัน ยอดดาวน์โหลด Claude เพิ่มขึ้น 51% ในวันเดียว บน Reddit มีคลื่นโพสต์ "Cancel ChatGPT" (คว่ำบาตร ChatGPT) ผู้ใช้โพสต์ภาพหน้าจอการยกเลิกการสมัครสมาชิก มีคนเขียนในความคิดเห็นว่า "fastest install of my life" เว็บไซต์ชื่อ QuitGPT.org เปิดตัว อ้างว่ามีคน 1.5 ล้านคนได้ดำเนินการแล้ว

วันจันทร์ ผู้ใช้หลั่งไหลเข้ามามากเกินไป Claude เกิดการล่มครั้งใหญ่ บริษัทที่ถูกรัฐบาลกลางจัดเป็น "ความเสี่ยงด้านความปลอดภัยของห่วงโซ่อุปทาน" เนื่องจากผู้ใช้หลั่งไหลเข้ามา เซิร์ฟเวอร์รับแรงกดดัน

การตอบโต้ด้วยผลิตภัณฑ์ที่แม่นยำ

ในวันเดียวกับที่กระแสการถอนการติดตั้งกำลังแพร่กระจาย Anthropic เปิดตัวเครื่องมือย้ายความทรงจำ

ฟังก์ชันเองไม่ซับซ้อน ผู้ใช้คัดลอกพรอมต์หนึ่งชุดไปที่ ChatGPT ให้มันส่งออกความทรงจำและความชอบทั้งหมดที่เก็บไว้ จากนั้นวางลงใน Claude Claude นำเข้าในคลิกเดียว เริ่มต่อจากจุดที่คุณออกจาก ChatGPT ข้อความบนเว็บไซต์ทางการมีเพียงประโยคเดียว: "switch to Claude without starting over"

เวลาของเครื่องมือนี้ คือคุณสมบัติที่สำคัญที่สุดของมัน

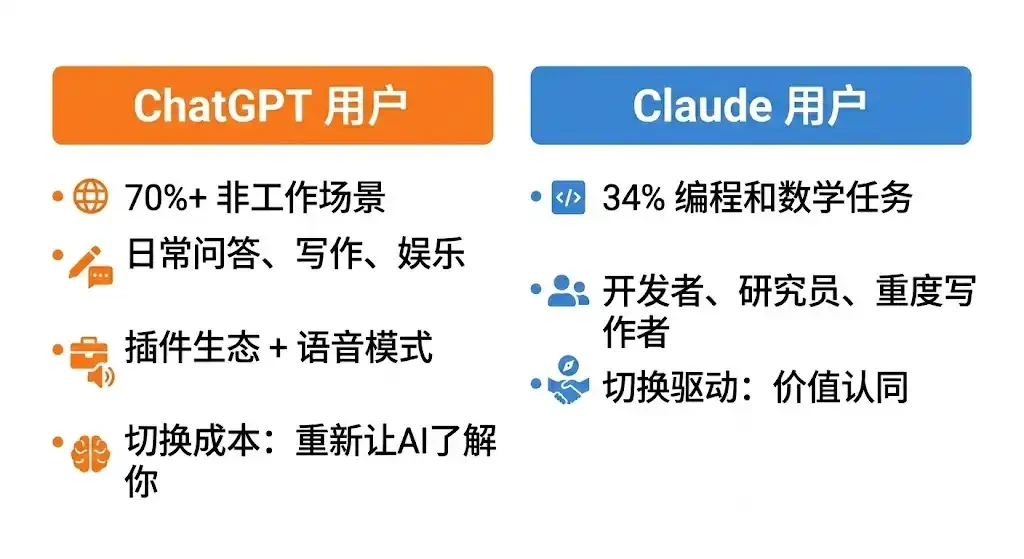

ข้อมูลของ OpenAI เองแสดงว่า ถึงกลางปี 2025 ผู้ใช้ ChatGPT กว่า 70% ใช้ในสถานการณ์ที่ไม่เกี่ยวข้องกับงาน การถามตอบทั่วไป การเขียน ความบันเทิง การค้นหาข้อมูลรวมอยู่ด้วย มันคือ AI ตัวแรกที่หลายคนได้สัมผัส พึ่งพาระบบนิเวศปลั๊กอินขนาดใหญ่ Voice Mode และการผสานรวมแอปพลิเคชันบุคคลที่สามอย่างลึกซึ้งเข้าไปในชีวิตประจำวัน ค่าใช้จ่ายในการเปลี่ยนของผู้ใช้ประเภทนี้ไม่ใช่แค่ "ดาวน์โหลดแอปใหม่" แต่เป็นการให้ AI ที่ไม่รู้จักคุณเริ่มต้นเรียนรู้ว่าคุณเป็นใครจากศูนย์ใหม่ การสะสมความทรงจำ ในอดีตคือเหตุผลที่แข็งแกร่งที่สุดที่จะอยู่ต่อ

ข้อมูลวิจัยของ Anthropic เองแสดงว่า สถานการณ์การใช้งาน Claude มีความเข้มข้นสูง งานเขียนโปรแกรมและคณิตศาสตร์คิดเป็น 34% เป็นหมวดหมู่เดี่ยวที่ใหญ่ที่สุด การศึกษาและการวิจัยคือทิศทางที่เติบโตเร็วที่สุดในปีที่ผ่านมา ผู้ใช้หลักคือนักพัฒนา นักวิจัย และนักเขียนหนัก กลุ่มคนเหล่านี้มีเหตุผลมากกว่า เปลี่ยนเครื่องมือได้ง่ายกว่าเพราะการตัดสินคุณค่าที่ชัดเจน ตราบใดที่ต้นทุนการย้ายต่ำพอ

เครื่องมือย้ายความทรงจำกดต้นทุนนี้ลงไปต่ำสุด ในเวลาเดียวกัน Anthropic ประกาศจะเปิดฟังก์ชันความทรงจำให้ผู้ใช้ฟรีทั้งหมด ฟังก์ชันนี้ก่อนหน้านี้เป็นสิทธิพิเศษสำหรับผู้ใช้จ่ายเงิน

แต่ผู้ใช้ที่หลั่งไหลเข้ามาครั้งนี้ ส่วนหนึ่งไม่ใช่ผู้ใช้เป้าหมายดั้งเดิมของ Claude

จากข้อเสนอแนะบนโซเชียลมีเดีย ผู้ใช้ทั่วไปจำนวนมากที่ย้ายมาจาก ChatGPT เมื่อใช้ Claude ครั้งแรกมักมีปฏิกิริยา: "มันแตกต่าง" บางคนรู้สึกว่าคำตอบของ Claude ลึกซึ้งกว่า จะผลักกลับมาเอง แทนที่จะพูดดีไปหมดทุกอย่าง บางคนพบว่ามันเขียนได้สะอาดกว่า แต่ไม่สามารถสร้างภาพได้ และไม่มีประสบการณ์การโต้ตอบแบบ Voice Mode

บางคนเดิมอยากหา "ตัวแทน ChatGPT ที่เชื่อฟังกว่า" แต่พบว่าบุคลิกของ Claude แข็งแกร่งกว่า การปรับตัวต้องใช้เวลา คู่มือการย้ายข้อมูลของ TechRadar ถูกแชร์อย่างแพร่หลายในช่วงสองสามวันนี้ หัวข้อคือ "ฉันหวังว่ามีคนบอกฉันสิ่งเหล่านี้มาก่อน" ข้อมูลหลักของบทความคือ: ตรรกะการใช้งานของ Claude และ ChatGPT แตกต่างกันโดยพื้นฐาน อันแรก更像เพื่อนร่วมงานที่มีจุดยืน อันหลัง更像ผู้ช่วยสารพัดประโยชน์

ความแตกต่างนี้เดิมคือตำแหน่งของผลิตภัณฑ์ทั้งสอง แต่ถูกขยายโดยเหตุการณ์นี้โดยไม่คาดคิด ผู้ใช้หลั่งไหลเข้ามาที่ Claude เพราะจุดยืนทางศีลธรรม จากนั้นพบผลิตภัณฑ์ที่แตกต่างจากที่คาดไว้ AI ที่จุกจิกกว่า มีขอบเขตความรู้สึกมากกว่า สิ่งนี้อาจเป็นเหตุผลที่จะสูญเสียผู้ใช้ แต่ในช่วงเวลาพิเศษนี้ มันกลับกลายเป็นเหตุผลที่จะอยู่ต่อ: คุณเชื่อในจุดยืนของบริษัทหนึ่ง ก็ยอมรับตรรกะของผลิตภัณฑ์มันได้ง่ายกว่า

หลังจากเปิดตัวไม่กี่วัน Anthropic เปิดเผยข้อมูล: ผู้ใช้ฟรีที่ใช้งานจริงเพิ่มขึ้นกว่า 60% เมื่อเทียบกับเดือนมกราคม จำนวนการลงทะเบียนใหม่รายวันเพิ่มขึ้นสี่เท่า Claude เคยล่มเนื่องจากปริมาณการเข้าชมมากเกินไป ผู้ใช้หลายพันคนรายงานว่าไม่สามารถเข้าสู่ระบบได้ ซ่อมแซมภายในไม่กี่ชั่วโมง

สามคำในสัญญา: OpenAI พูดอะไร และทำอะไร

Anthropic เป็นบริษัทพาณิชย์รายแรกที่ปรับใช้โมเดล AI ลงในเครือข่ายลับของกองทัพสหรัฐฯ ความร่วมมือดำเนินการผ่าน Palantir มูลค่าสัญญาประมาณ 200 ล้านดอลลาร์ แต่ในช่วงหลายเดือนที่ผ่านมา ความสัมพันธ์ของทั้งสองฝ่ายเลวร้ายลงอย่างต่อเนื่อง แกนกลางของข้อพิพาทคือข้อกำหนดหนึ่ง: เพนตากอนต้องการให้โมเดล AI เปิดให้ใช้ใน "วัตถุประสงค์ที่ถูกกฎหมายทั้งหมด" โดยไม่มีเงื่อนไขเพิ่มเติม Anthropic ยืนยันเขียนข้อยกเว้นสองข้อชัดเจน ไม่อนุญาตให้ใช้สำหรับการเฝ้าระวังพลเมืองอเมริกันในวงกว้าง ไม่อนุญาตให้ใช้สำหรับระบบอาวุธอัตโนมัติเต็มรูปแบบ

ประมาณวันที่ 20 กุมภาพันธ์ มีรายงานว่าผู้บริหารระดับสูงของ Anthropic คนหนึ่งสอบถามวิธีการใช้ Claude ในการปฏิบัติการจับกุมประธานาธิบดี Maduro ของเวเนซุเอลาโดยกองทัพสหรัฐฯ ในเดือนมกราคม กับคู่ค้า Palantir กองทัพไม่พอใจอย่างมาก วันพฤหัสบดี เพนตากอนออกคำขาด กำหนดให้ Dario Amodei ตอบกลับก่อน 17:00 น. ของวันนั้น

Amodei ออกแถลงการณ์ก่อนหมดเวลา กล่าวว่าบริษัทไม่สามารถยอมรับข้อกำหนดในปัจจุบันได้ "ไม่ใช่เพราะเราคัดค้านการใช้งานทางทหาร แต่ในบางกรณี เรามีความเชื่อว่า AI มีศักยภาพที่จะทำลายมากกว่าปกป้องคุณค่าประชาธิปไตย" ทรัมป์ประกาศทันทีว่าหน่วยงานของรัฐบาลกลางหยุดใช้ผลิตภัณฑ์ Anthropic ทั้งหมดภายในหกเดือน Hegseth จัดให้อยู่ในหมวด "ความเสี่ยงด้านความปลอดภัยของห่วงโซ่อุปทาน" ป้ายนี้มักใช้กับบริษัทคู่แข่งต่างชาติ สัญญาจบลง

ตำแหน่งที่ว่าง มีคนเข้ามาเติมเต็มในไม่ช้า ในวันเดียวกันช่วงดึก OpenAI ประกาศเซ็นสัญญากับเพนตากอน Altman ในจดหมายภายในวันพฤหัสบดี จุดยืนยังชัดเจน เขาเขียนว่านี่เป็น "ปัญหาของอุตสาหกรรมทั้งหมดแล้ว" กล่าวว่า OpenAI และ Anthropic ถือ "เส้นแดง" เดียวกัน: คัดค้านการเฝ้าระวังวงกว้าง คัดค้านอาวุธอัตโนมัติ วันศุกร์ บรรลุข้อตกลง จะปรับใช้โมเดลในเครือข่ายลับของกองทัพ จำกัดให้ทำงานบนคลาวด์เท่านั้น ส่งวิศวกรไปดูแล และอ้างว่าได้เขียนข้อจำกัดสองข้อเดียวกันไว้ในสัญญาแล้ว

Altman หลังจากนั้นเปิดให้ถามคำถามบน X ตอบคำถามเป็นเวลาหลายชั่วโมง มีคนถามเขา: ทำไมเพนตากอนยอมรับ OpenAI แต่แบน Anthropic? คำตอบของเขาคือ: "Anthropic ดูเหมือนจะมุ่งเน้นไปที่ข้อห้ามเฉพาะในสัญญา มากกว่าการอ้างอิงกฎหมายที่ใช้บังคับได้ และเราพอใจกับการอ้างอิงกฎหมาย"

ประโยคนี้พูดถึงความแตกต่างในวิธีการ แต่มันเปิดประเด็นข้อพิพาทที่แท้จริงของเรื่องนี้

ประเด็นสำคัญที่ Anthropic เจรจาแตก คือวลีที่เพนตากอนยืนยันให้เขียนเข้าไป: ระบบ AI สามารถใช้สำหรับ "all lawful purposes" หรือวัตถุประสงค์ที่ถูกกฎหมายทั้งหมด เหตุผลที่ Anthropic ปฏิเสธคือ วลีนี้ในบริบทความมั่นคงแห่งชาติไม่ใช่ขอบเขตที่ตายตัว กฎหมายปัจจุบันในหลายด้านยังตามความสามารถของ AI ไม่ทัน ขอบเขตของ "ถูกกฎหมาย" จะถูกกำหนดโดยการตีความของรัฐบาลเอง OpenAI เซ็นวลีนี้ ในขณะที่อ้างว่าได้พูดคุยถึงการป้องกันเดียวกันในสัญญา

ผู้เชี่ยวชาญด้านกฎหมายหลังจากนั้นวิเคราะห์ข้อกำหนดสัญญาที่ OpenAI เปิดเผย ชี้ปัญหาการแสดงออกสองจุดที่เฉพาะเจาะจง

ข้อกำหนดการเฝ้าระวังเขียนว่า ระบบไม่อนุญาตให้ใช้สำหรับการเฝ้าระวังข้อมูลส่วนบุคคลของพลเมืองอเมริกันแบบ "unconstrained" (ไร้ข้อจำกัด) Samir Jain รองประธานฝ่ายนโยบายของศูนย์ประชาธิปไตยและเทคโนโลยีชี้ว่า ถ้อยคำที่นี่หมายความว่า รุ่นการเฝ้าระวังแบบ "มีข้อจำกัด" 是被允许的 และภายใต้กรอบกฎหมายปัจจุบัน รัฐบาลสามารถซื้อบันทึกตำแหน่ง ประวัติการท่องเว็บ และข้อมูลทางการเงินของพลเมืองจากนายหน้าข้อมูลได้อย่างถูกกฎหมาย ให้ AI วิเคราะห์ข้อมูลเหล่านี้ ในทางเทคนิคไม่ถือเป็น "การเฝ้าระวังที่ผิดกฎหมาย" Amodei ในระหว่างให้สัมภาษณ์ CBS หลังจากนั้น ยกตัวอย่างนี้พอดี

ข้อกำหนดอาวุธเขียนว่า ระบบไม่อนุญาตให้ใช้สำหรับอาวุธอัตโนมัติในกรณีที่ "กฎหมาย ระเบียบข้อบังคับ หรือนโยบายของกรมกำหนดให้ต้องมีการควบคุมโดยมนุษย์" คำจำกัดความนี้หมายความว่า ข้อจำกัดจะมีผลก็ต่อเมื่อข้อกำหนดอื่นๆ กำหนดให้ต้องมีการควบคุมโดยมนุษย์อยู่แล้ว อำนาจผูกพัน完全借用于นโยบายที่มีอยู่ และเพนตากอนมีสิทธิ์แก้ไขนโยบายภายในของตัวเองได้ตลอดเวลา นักวิชาการกฎหมาย Charles Bullock เขียนบน X ว่า ข้อกำหนดอาวุธในสัญญาพึ่งพาคำสั่ง DoD 3000.09 ซึ่งกำหนดให้ผู้บัญชาการรักษา "ระดับการตัดสินใจของมนุษย์ที่เหมาะสม" และ "ระดับที่เหมาะสม" นี้คือมาตรฐานที่สามารถตีความได้อย่างยืดหยุ่น

การตอบโต้ของ OpenAI ต่อข้อสงสัยเหล่านี้คือ: โมเดลสามารถทำงานบนคลาวด์เท่านั้น ซึ่งในเชิงสถาปัตยกรรมตัดความเป็นไปได้ที่จะถูกผสานรวมโดยตรงเข้ากับระบบอาวุธ สัญญายังเขียนพื้นฐานทางกฎหมายที่เฉพาะเจาะจง มีอำนาจผูกพันมากกว่าข้อกำหนดการห้ามที่เป็นตัวอักษร เพราะกฎหมายคือกรอบที่ผ่านการทดสอบแล้ว Altman เองในการตอบคำถามยอมรับ: "หากในอนาคตเราต้องสู้รบในสงครามนี้ เราจะสู้ แต่นี่ทำให้เราเผชิญความเสี่ยงบางอย่างอย่างชัดเจน"

นี่ไม่ใช่ปัญหาที่บริษัทหนึ่งยินยอมประนีประนอม อีกบริษัทหนึ่งยึดมั่นในหลักการ นี่คือปรัชญาความปลอดภัยสองแบบที่แตกต่างกันโดยพื้นฐาน เส้น底线ของ OpenAI คือ: สิ่งที่ผิดกฎหมายฉันไม่ทำ เส้น底线ของ Anthropic คือ: สิ่งที่กฎหมายยังไม่อาจห้ามทัน แต่ฉันคิดว่าไม่ควรทำ ฉันก็ไม่ทำ

ความแตกต่างนี้ ทิ้งรอยร้าวภายใน OpenAI ด้วย สัปดาห์ที่แล้ว พนักงาน OpenAI หลายคนลงนามในจดหมายเปิดผนึก สนับสนุนจุดยืนของ Anthropic คัดค้านการจัดให้อยู่ในหมวดความเสี่ยงด้านห่วงโซ่อุปทาน นักวิจัยการจัดตำแหน่ง Leo Gao ตั้งคำถามต่อสาธารณะว่าสัญญาของบริษัทให้การปกป้องเพียงพอหรือไม่ บนทางเท้าร้านสำนักงานเก่าของ OpenAI ในซานฟรานซิสโก ปรากฏภาพวาดวิจารณ์ด้วยชอล์ก นอกสำนักงาน Anthropic คือข้อความสนับสนุน การตอบคำถามบน X ของ Altman ที่ดำเนินต่อเนื่องหลายชั่วโมง 面向ผู้คนภายในบริษัทของตัวเองที่เดิม站在 Anthropic 一边 เป็นส่วนใหญ่

สองผลลัพธ์ของเรื่องเล่าเดียวกัน

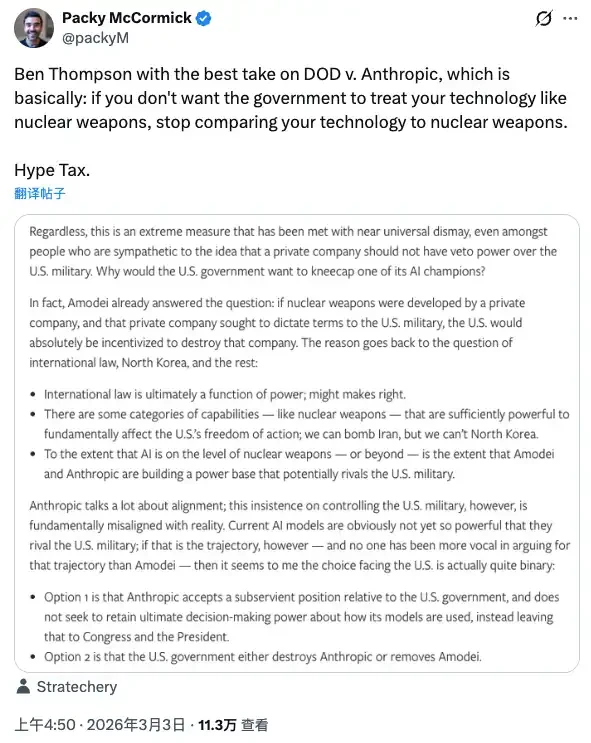

Anthropic 多年来一直用 "ป้องกันความเสี่ยงระดับอารยธรรม" 来框定ภารกิจความปลอดภัยของตัวเอง เทียบภัยคุกคามที่อาจเกิดขึ้นจาก AI ขั้นสูงกับอาวุธนิวเคลียร์ วางตำแหน่งตัวเองเป็นผู้เฝ้าประตูบนแนวป้องกันนี้ เรื่องเล่าชุดนี้คือแกนกลางของแบรนด์มัน และคือวิธีที่มันได้รับความไว้วางใจในตลาดทุน

นักวิจารณ์เทคโนโลยี Packy McCormick ในช่วงที่เรื่องนี้แพร่กระจาย อ้างอิงแนวคิดหนึ่งของ Ben Thompson: Hype Tax ความหมายคือ หากคุณใช้เรื่องเล่าสุดโต่ง来สร้างอิทธิพลของตัวเอง เมื่อเรื่องเล่าชุดนี้เผชิญกับอำนาจที่แท้จริง คุณต้องจ่ายค่าธรรมเนียมให้มัน คุณเปรียบเทียบเทคโนโลยี AI กับอาวุธนิวเคลียร์ รัฐบาล就会用对待核武器的方式对待你

Anthropic จ่ายค่าธรรมเนียมให้เรื่องเล่าชุดนี้: สูญเสียสัญญาหนึ่งฉบับ ถูกจัดเป็นความเสี่ยงด้านความปลอดภัย ถูกประธานาธิบดี指名 ผลิตภัณฑ์ทั้งหมดของบริษัทถูกกำหนดให้ต้องลบออกจากระบบของรัฐบาลกลางภายในหกเดือน

但在同一个周末 เรื่องเล่าเดียวกันในอีกมิติหนึ่งสร้างผลลัพธ์ที่ตรงกันข้ามโดยสิ้นเชิง

ผู้ใช้ทั่วไปมองไม่เห็นข้อกำหนดสัญญา ไม่เห็นการตีความกฎหมาย ไม่เห็นการโต้แย้งปรัชญาความปลอดภัย พ