GPTとClaudeが手を組んだのは、国防総省に反対するため?

- 核心的な視点:本稿は、AI企業が米国政府と協力する際に直面する倫理とビジネスのジレンマを明らかにしている。Anthropicが特定のAI使用原則を堅持したために国防総省から制裁を受け、OpenAIが順調に契約を結んだ例を挙げ、国家安全保障問題の前では、テクノロジー企業の原則的立場が政治的姿勢や交渉戦略の違いによって全く異なる結果を生みうることを示している。その核心は、政府が市場参入の権力を利用してルールの主導権を確立することにある。

- 重要な要素:

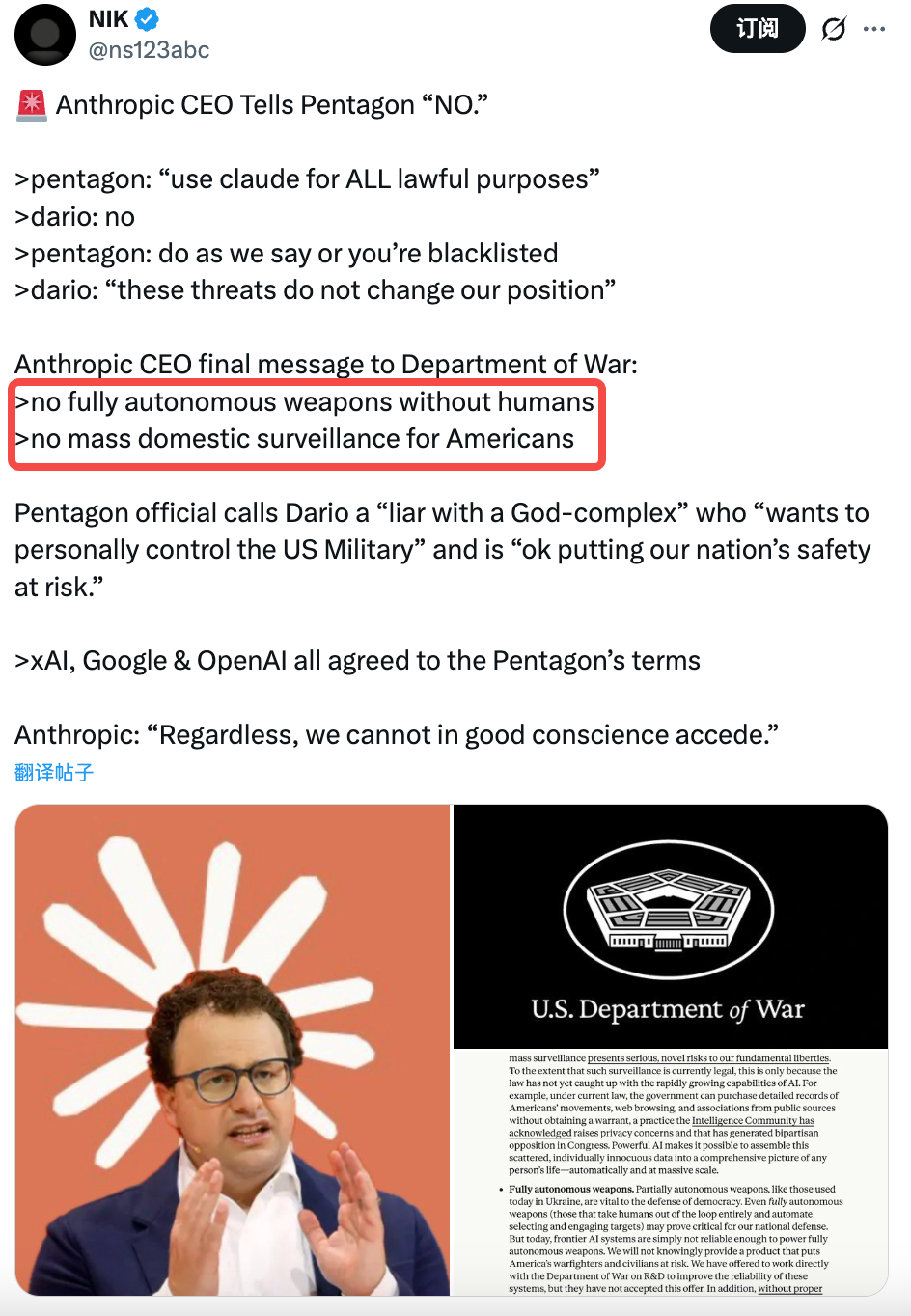

- 事件の発端:Anthropicは、米軍との2億ドル契約において「市民の大規模監視の禁止」と「完全自律兵器の禁止」という2つの一線を堅持し、法的抜け穴を塞ぐことを主張したため、国防総省に拒否され、最後通告を突きつけられた。

- 立場の分化と短期的な連合:Anthropicが妥協を拒否した後、OpenAIの従業員が連名で支援を表明し、そのCEOも同じ一線を守ると声明を出し、業界が倫理問題において初期の団結を示した。

- 制裁のエスカレーション:Anthropicが署名を拒否した後、国防総省によって「サプライチェーン安全保障リスク」(華為技術への扱いに類似)に指定され、前大統領トランプ氏から公に非難され、連邦政府のサプライチェーン全体から排除されるリスクに直面した。

- 競合他社の利益:OpenAIは迅速に国防総省と合意に達し、Anthropicが残した空白を埋めたが、受け入れた条件にはAnthropicが堅持した「法的抜け穴を塞ぐ」条項は含まれていなかった。

- 政治的・イデオロギー的要因:本稿は、Anthropicが一部の官僚から「目覚めたAI(woke AI)」と批判され、そのCEOの政治的傾向(トランプ氏の就任式に出席しなかったこと)が交渉結果に影響を与えた可能性があり、論争が純粋な商業や技術の範疇を超えていることを示していると指摘する。

- 業界への警告信号:この事件の核心的な影響は「見せしめ」にあり、Anthropicへの制裁を通じて政府の権威を明確にし、他のAI企業が将来同様の選択を迫られた際に「合理的な」商業的判断を行わせ、業界の倫理的抵抗を抑制する可能性があることだ。

原文著者:Kuli、深潮 TechFlow

数日前、ある写真がネット上で話題になった。

インドで開催されたAIサミットで、モディ首相が壇上に立ち、両側にはシリコンバレーの大物たちが並んでいた。記念撮影の際、モディ首相は隣の人の手を取り頭上に掲げ、他の人々もそれに倣って手をつないだ。団結した光景だった。

しかし、手をつなぐことを拒んだ二人だけがいた。

OpenAIのCEOとAnthropicのCEO、つまりChatGPTとClaudeを背後に持つ二社のトップが、互いの隣に立ち、それぞれ拳を掲げていた。

手をつなぐこともなく、視線を合わせることもなく、まるで先生に隣同士にさせられた仲の悪い生徒のようだった。

この二社はここ数年、激しい競争を繰り広げてきた。ClaudeはOpenAIから離脱したチームが立ち上げたもので、両社はユーザー、企業顧客、資金調達を奪い合い、今年のスーパーボウルの期間中には、Anthropicが広告を出してChatGPTの広告掲載を嘲笑するほどだった。

だから、手をつながないのも当然だ。

しかし、今日、彼らは手をつないだ。ペンタゴンのせいで。

事の経緯はこうだ。

Claudeを背後に持つAnthropicは、昨年、米国防総省と最大2億ドルの契約を結んだ。Claudeは米軍の機密ネットワークに配備された最初のAIモデルとなり、情報分析や任務計画などの作業を支援することになった。

しかし、Anthropicは契約に二つのレッドラインを設けた:

Claudeは米国民に対する大規模な監視には使用できず、人間が関与しない自律兵器にも使用できない。(参考記事:Anthropic アイデンティティ危機の72時間)

しかし、ペンタゴンはこれを受け入れなかった。

彼らの要求は四文字:無制限。購入したツールは自由に使えるべきであり、一民間企業が米軍に何をすべきで何をすべきでないかを指示する権利はない、というものだ。

先週火曜日、ヘグセス国防長官はAnthropicのCEOに対し、直接最後通告を突きつけた:金曜日午後5時1分までに承諾しなければ、結果は自己責任と。

Anthropicは承諾しなかった。

同社CEOは公開声明を発表し、大意はこうだ:AIが米国の国防にとって重要であることは理解しているが、一部のケースでは、AIは民主主義的価値を守るのではなく損なう可能性がある。この要求を良心に従って受け入れることはできない。

ペンタゴンの交渉担当者、エミル・マイケル国防副長官はその後、ソーシャルメディアで彼を嘘つき呼ばわりし、神様気取りで国家安全保障を弄んでいる、と非難した。

束の間の手つなぎ

そして、予想外のことが起こった。

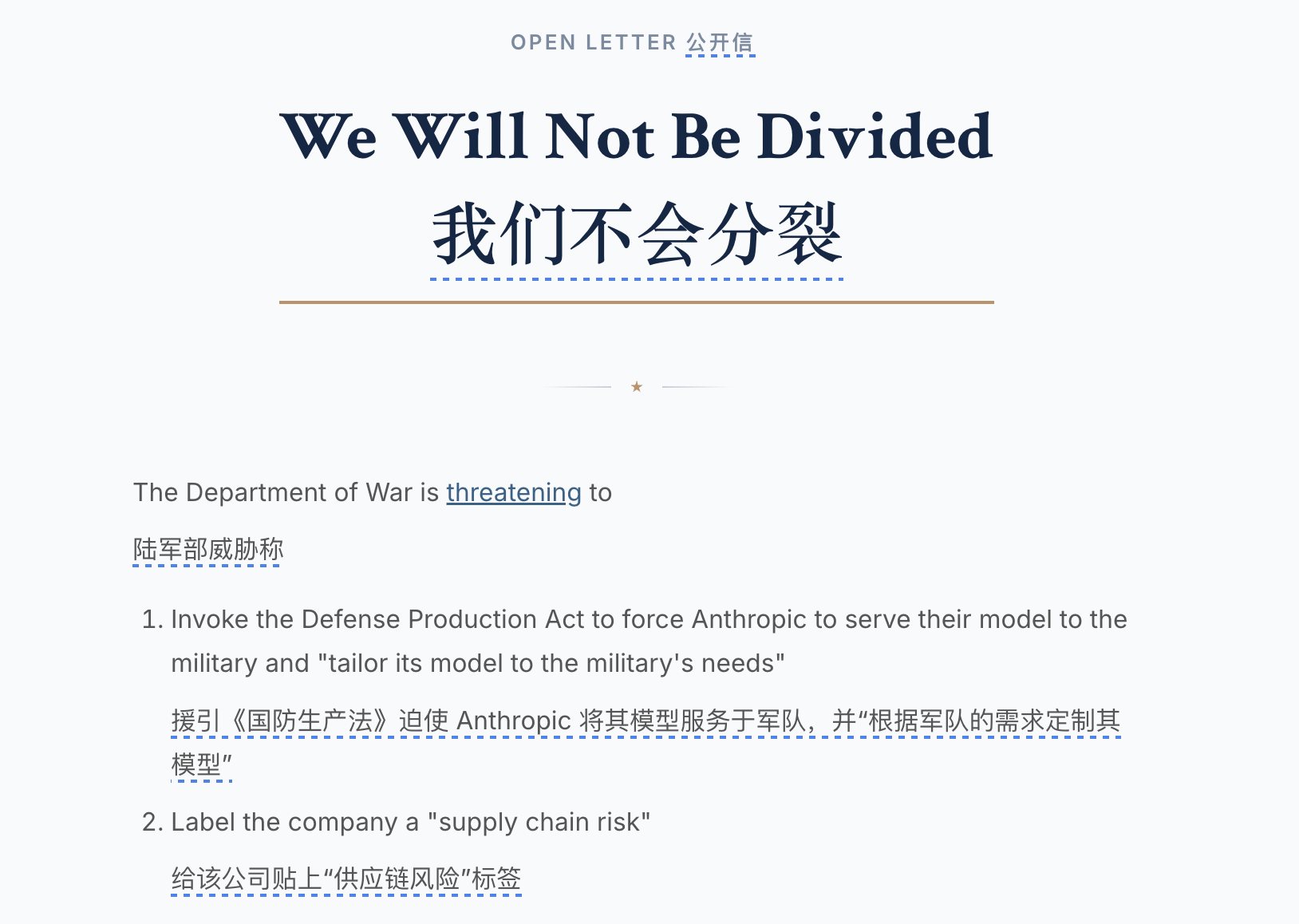

OpenAIとGoogleの従業員、合計400人以上が連名の公開書簡に署名した。タイトルは「我々は分断されない」。

書簡には、ペンタゴンがAI企業を一つずつ交渉し、Anthropicが承諾しなかった条件を他の企業に飲ませようとしており、恐怖で各社を分断しようとしている、と記されていた。

OpenAIのCEOも全従業員に内部文書を送り、OpenAIもAnthropicと同じレッドラインを持っていると述べた:

大規模監視は行わない、自律殺傷兵器は作らない。

ほんの数日前まで手をつなぐことを拒んでいた二社が、突然、ペンタゴンのせいで同じ側に立った。

しかし、この団結はおそらく数時間しか続かなかった。

金曜日午後5時1分、ペンタゴンの最後通告の期限が切れた。Anthropicは署名しなかった。

時価総額3800億ドルの米国テック企業が、2億ドルの契約が無効になるリスクを背負い、米国防総省を拒否した。以前なら、これはせいぜい契約解除して別のサプライヤーを探す程度の話だった。しかし、今回のワシントンの反応は、まったく商業レベルではなかった。

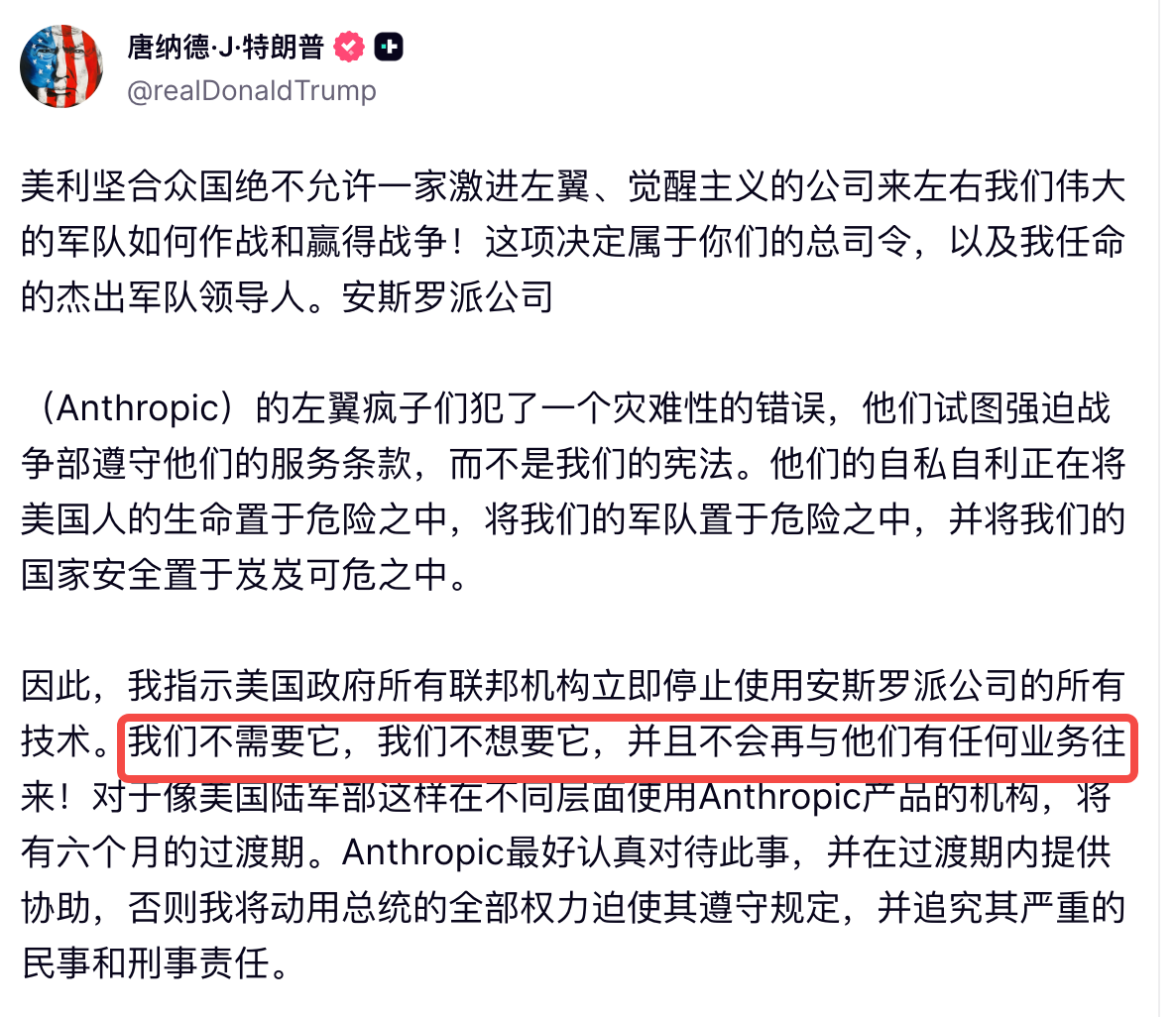

トランプ氏は約1時間後にTruth Socialに投稿し、Anthropicを「左翼の狂信者」と呼び、彼らが憲法の上に立とうとし、米軍兵士の命を弄んでいる、と述べた。

彼はすべての連邦機関に対し、直ちにAnthropicの技術の使用を停止するよう要求した。

続いて、米国防長官ヘグセスは、Anthropicを「サプライチェーン安全保障リスク」に指定すると発表した。このラベルは通常、ファーウェイのような企業に貼られるものだ。意味は明確で、米軍と取引するすべての請負業者は、Anthropicの製品に触れてはならない。

Anthropicは訴訟を起こすと述べた。

そして、同じ夜、先ほどまで同じ立場を保っていたOpenAIが、ペンタゴンと契約を結んだ。

イデオロギーの問題

OpenAIは何を得たのか?

Claudeが追い出された後に残されたポジション:米軍機密ネットワークのAIサプライヤー。ただし、OpenAIはペンタゴンに三つの条件を提示した。大規模監視は行わない、自律兵器は作らない、高リスクの意思決定には必ず人間が関与する、というものだ。

ペンタゴンは、了解した、と言った。

間違いではない。Anthropicが数週間かけても受け入れられなかった条件が、別の企業が提示したら、数日でまとまったのか?

もちろん、両者の提案は完全に同じではない。

Anthropicはもう一層のものを要求した:現在の法律はAIの能力に追いついていない、例えばAIはあなたの位置データ、閲覧履歴、ソーシャルメディア情報をすべて合法的に購入し、合法的に集約でき、最終的には監視と同等の効果を持つが、各ステップは違法ではない、と彼らは考えている。

Anthropicは、「監視を行わない」と書くだけでは不十分で、この抜け穴を塞ぐ必要がある、と言った。OpenAIはこの点を堅持せず、ペンタゴンの主張、つまり現行法で十分だという説を受け入れた。

しかし、これが単なる条項の相違だと思うなら、それは甘すぎる。この交渉は最初から条項だけの話ではなかった。

ホワイトハウスのAI担当トップ、デイビッド・サックスは以前から、Anthropicが「目覚めたAI(woke AI)」(イデオロギー先行、政治的正しさを追求する)をやっていると公に批判してきた。ペンタゴンの高官はメディアに対し、ダリオ(Anthropic CEO)の問題はイデオロギーに駆動されたものであり、「我々は誰と交渉しているかを知っている」と語った。

イーロン・マスクのxAIは、そもそもAnthropicの直接の競合相手であり、彼は今週Xで繰り返しAnthropicを攻撃し、同社は「西洋文明を憎んでいる」と述べた。

そして、AnthropicのCEOは昨年、トランプ氏の就任式に出席しなかった。OpenAIのCEOは出席した。

見せしめ

では、何が起こったのかを整理しよう。

同じ原則、同じレッドラインにもかかわらず、Anthropicはもう一層の保証を要求し、間違った側に立ち、間違った姿勢を取ったために、ファーウェイと同じレベルの、いわゆる米国国家安全保障上の脅威と烙印を押された。

OpenAIは一層少ない要求で、関係をうまく築き、契約を獲得した。これは原則の勝利なのか、それとも原則の値付けなのか?

ペンタゴンの契約が拒否されるのは、実はこれが初めてではない。

2018年、Googleの従業員4000人以上が請願書に署名し、十数人が辞職して、同社がペンタゴンの「プロジェクト・メイヴン」と呼ばれるプロジェクトに参加することに抗議した。そのプロジェクトはAIを使ってドローンが撮影した映像を分析し、軍がより速く標的を識別するのを支援するものだった。

Googleは最終的に撤退した。契約を更新せずに去った。従業員が勝った。

8年が経ち、同じ論争が再び繰り返された。しかし、今回はルールが完全に変わった。ある米国企業が、軍の仕事はできるが、二つのことはできない、と言った。米政府の対応は、それを連邦システム全体から追い出すことだった。

しかも、「サプライチェーン安全保障リスク」というラベルの殺傷力は、たった2億ドルの契約を失うことにとどまらない。

Anthropicの今年の収益は約140億ドルと見られており、2億ドルの契約は端数にも満たない。しかし、このラベルが意味するのは、米軍と取引のある企業はすべて、Claudeを使用できなくなるということだ。

これらの企業はペンタゴンの立場を支持する必要はない。彼らがする必要があるのは、リスク評価をすることだ:Claudeを使い続ければ、政府契約を失う可能性がある;別のモデルに切り替えれば、何の問題もない。

選択は容易だ。これがこの事件の真の信号だ。

Anthropicが持ちこたえられるかどうかは重要ではない。重要なのは、次の企業がまだ持ちこたえようとする勇気があるかどうかだ。彼らはこの結果を見て、原則を堅持するコストを見て、そして非常に合理的な決定を下すだろう。

あのインドの写真を振り返ると、全員が手をつないで頭上に掲げている中、彼ら二人だけがそれぞれ拳を握りしめていた。

おそらく、これが常態なのだ。

AI企業の原則は同じでも、手は必ずしもつなげるわけではない。