Bị cấm 48 giờ, Claude đứng đầu App Store

- Quan điểm cốt lõi: Việc OpenAI ký hợp đồng với Lầu Năm Góc đã dẫn đến sự phản đối hàng loạt của người dùng đối với ChatGPT và chuyển sang Claude. Đây không chỉ là cạnh tranh thương mại, mà còn làm nổi bật sự khác biệt triết lý cơ bản giữa Anthropic và OpenAI về an toàn ứng dụng quân sự AI: bên trước cố gắng chủ động đặt ra giới hạn trong khoảng trống pháp lý, trong khi bên sau dựa vào khuôn khổ pháp luật hiện hành.

- Yếu tố then chốt:

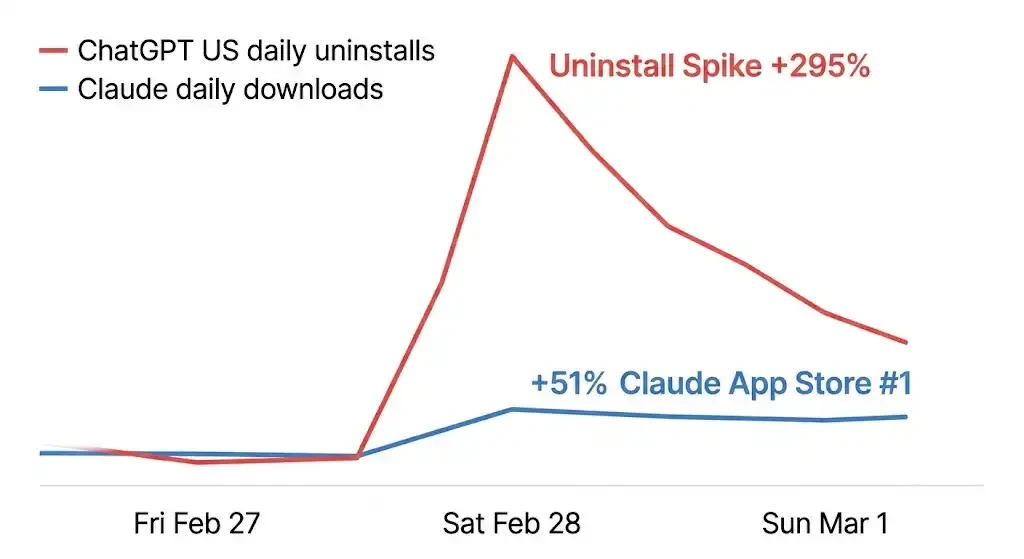

- Phản ứng thị trường dữ dội: Sự kiện khiến số lượt gỡ cài đặt ChatGPT tại Mỹ trong một ngày tăng 295%, đánh giá 1 sao tăng 775%, trong khi lượt tải Claude tăng 51% và đứng đầu bảng xếp hạng ứng dụng miễn phí App Store.

- Phản công sản phẩm chính xác: Anthropic kịp thời ra mắt "công cụ di chuyển ký ức" và mở miễn phí tính năng ghi nhớ, giảm đáng kể chi phí chuyển đổi từ ChatGPT.

- Bất đồng về điều khoản hợp đồng: Trọng tâm tranh cãi là yêu cầu của Lầu Năm Góc rằng AI có thể được sử dụng cho "tất cả mục đích hợp pháp". Anthropic mất hợp đồng vì từ chối điều khoản này và kiên trì đưa vào hai lệnh cấm cụ thể, trong khi OpenAI chấp nhận điều khoản nhưng tuyên bố hợp đồng có các biện pháp bảo vệ tương tự.

- Khác biệt triết lý an toàn: Giới hạn của OpenAI là "không làm điều bất hợp pháp", trong khi giới hạn của Anthropic mở rộng đến "những việc pháp luật chưa cấm nhưng cho là không nên làm", dẫn đến các lựa chọn thương mại và tranh cãi nội bộ khác nhau.

- Tính hai mặt của câu chuyện thương hiệu: Anthropic lâu nay nhấn mạnh câu chuyện "ngăn chặn rủi ro cấp độ văn minh", khiến họ mất hợp đồng quân sự và bị liệt kê là rủi ro an ninh, nhưng chính câu chuyện này lại bất ngờ giành được sự ủng hộ đạo đức từ đông đảo người dùng phổ thông, thúc đẩy sự tăng trưởng người dùng mạnh mẽ.

- Tác động thương mại chênh lệch: Hợp đồng quân sự mà Anthropic mất có giá trị khoảng 200 triệu USD, nhưng doanh thu hàng năm của họ đạt 14 tỷ USD, định giá gần đây là 380 tỷ USD, cho thấy giá trị tiềm năng từ tăng trưởng người dùng vượt xa tổn thất hợp đồng.

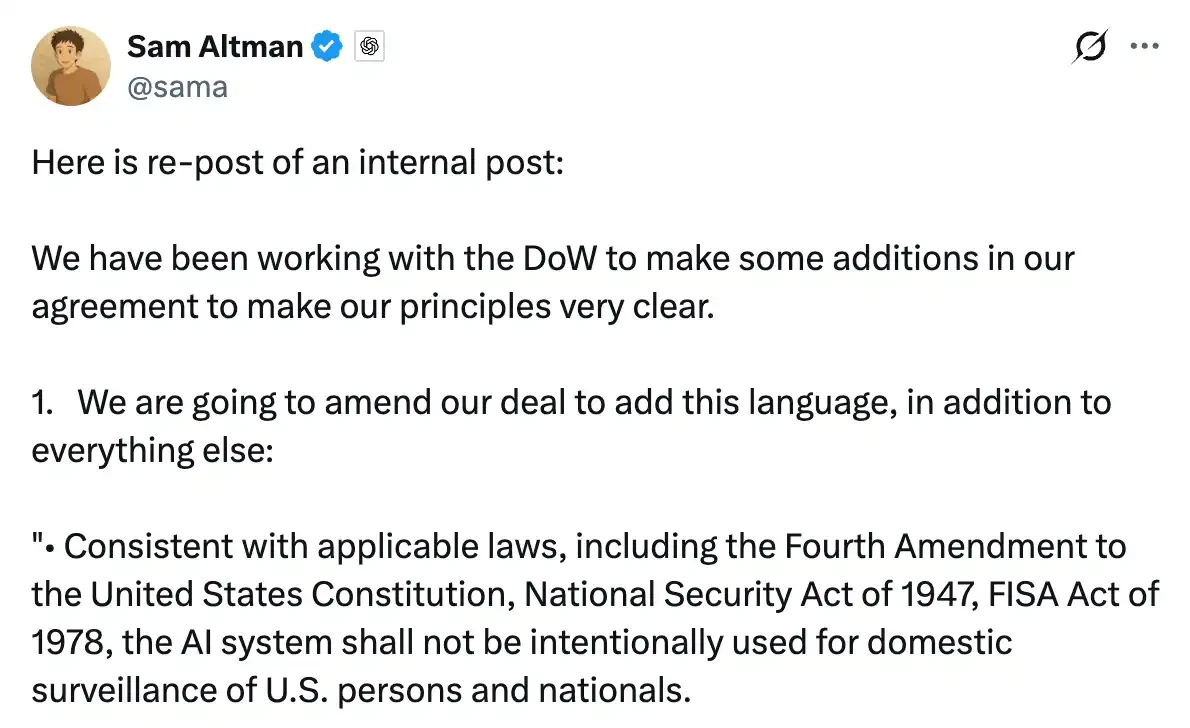

Vào sáng thứ Bảy, Altman đã chia sẻ trên X một bức ảnh chụp màn hình thư nội bộ.

Bức thư được anh viết cho nhân viên OpenAI vào đêm thứ Năm, nói rằng công ty đang đàm phán với Lầu Năm Góc và anh hy vọng có thể giúp "giảm bớt căng thẳng". Khi chia sẻ bức thư này, anh đã kèm theo vài dòng giải thích, đại ý muốn công khai giải thích những gì đã xảy ra trong vài ngày qua.

Vào thời điểm anh đăng tweet này, Claude đã leo lên vị trí số một trên bảng xếp hạng ứng dụng miễn phí của App Store Mỹ. Chỉ một ngày trước đó, ChatGPT vẫn đang ngồi ở vị trí đó.

Dữ liệu từ Sensor Tower ghi lại những gì xảy ra trong vài giờ tiếp theo: Vào riêng ngày thứ Bảy, số lượt gỡ cài đặt ChatGPT tại Mỹ đã tăng đột biến 295% so với ngày thường, số đánh giá 1 sao tăng vọt 775%. Đồng thời, lượt tải xuống Claude trong ngày tăng 51%. Trên Reddit xuất hiện làn sóng bài đăng với hashtag "Cancel ChatGPT", người dùng chia sẻ ảnh chụp màn hình hủy đăng ký, có người bình luận "fastest install of my life". Một trang web tên QuitGPT.org được ra mắt, tuyên bố rằng 1,5 triệu người đã hành động.

Vào thứ Hai, lượng người dùng đổ về quá lớn khiến Claude xảy ra sự cố ngừng hoạt động quy mô lớn. Công ty bị chính phủ liên bang liệt vào danh sách "rủi ro an ninh chuỗi cung ứng" này đã phải chịu áp lực máy chủ do người dùng đổ xô đến.

Cuộc phản công sản phẩm chính xác

Vào cùng ngày làn sóng gỡ cài đặt diễn ra, Anthropic đã ra mắt công cụ chuyển đổi ký ức.

Bản thân tính năng không phức tạp. Người dùng sao chép một đoạn prompt vào ChatGPT, yêu cầu nó xuất ra tất cả ký ức và sở thích đã lưu trữ, sau đó dán vào Claude, Claude sẽ nhập khẩu một lần, tiếp tục từ nơi bạn rời khỏi ChatGPT. Văn bản trên trang web chính thức chỉ có một câu: "switch to Claude without starting over".

Thời điểm của công cụ này là thuộc tính then chốt nhất của nó.

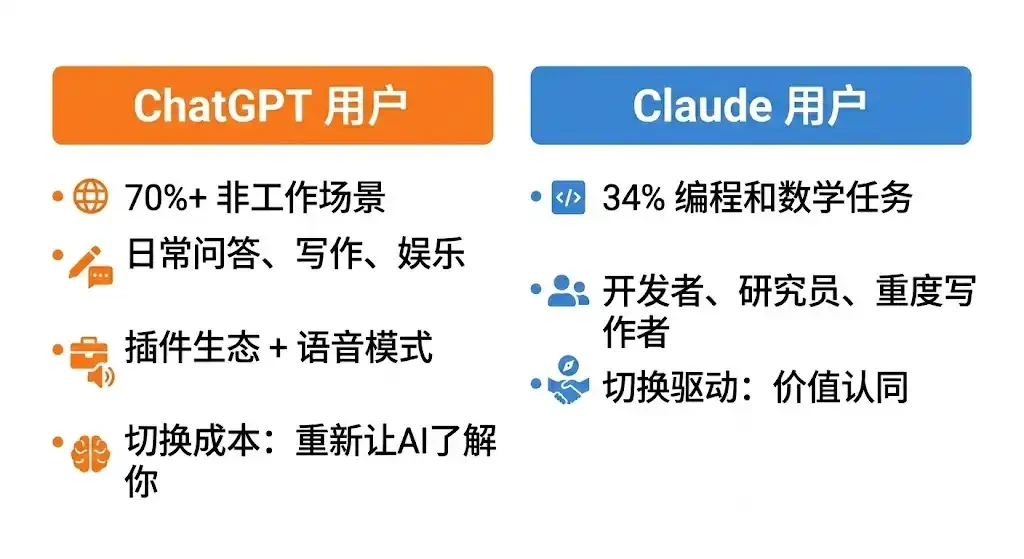

Dữ liệu của chính OpenAI cho thấy, đến giữa năm 2025, hơn 70% các tình huống sử dụng của người dùng ChatGPT là không liên quan đến công việc, bao gồm hỏi đáp hàng ngày, viết lách, giải trí, tìm kiếm thông tin. Đối với nhiều người, đây là AI đầu tiên họ tiếp xúc, dựa vào hệ sinh thái plugin khổng lồ, Chế độ Giọng nói và sự tích hợp sâu của ứng dụng bên thứ ba để nhúng vào cuộc sống hàng ngày. Chi phí chuyển đổi cho loại người dùng này không chỉ là "tải xuống một ứng dụng mới", mà là để một AI không biết bạn bắt đầu lại từ đầu để hiểu bạn là ai. Sự tích lũy ký ức trước đây là lý do mạnh mẽ nhất để ở lại.

Dữ liệu nghiên cứu của chính Anthropic cho thấy, các tình huống sử dụng Claude tập trung cao độ. Nhiệm vụ lập trình và toán học chiếm 34%, là danh mục đơn lẻ lớn nhất, giáo dục và nghiên cứu khoa học là hướng phát triển nhanh nhất trong năm qua. Người dùng cốt lõi là nhà phát triển, nhà nghiên cứu và người viết chuyên sâu, nhóm người này lý trí hơn, dễ dàng thay thế công cụ vì một đánh giá giá trị rõ ràng, miễn là chi phí di chuyển đủ thấp.

Công cụ chuyển đổi ký ức đã giảm chi phí này xuống mức thấp nhất. Đồng thời, Anthropic thông báo sẽ mở rộng chức năng ký ức cho tất cả người dùng miễn phí, tính năng này trước đây chỉ dành cho người dùng trả phí.

Nhưng một phần đáng kể trong số người dùng đổ về này không phải là người dùng mục tiêu ban đầu của Claude.

Từ phản hồi trên mạng xã hội, nhiều người dùng phổ thông chuyển từ ChatGPT sang, khi lần đầu sử dụng Claude, phản ứng thường là: "Nó khác biệt." Một số người cảm thấy câu trả lời của Claude sâu sắc hơn, sẽ chủ động đẩy ngược lại, chứ không phải cái gì cũng nói tốt. Một số người phát hiện nó viết sạch sẽ hơn, nhưng không tạo ra hình ảnh, cũng không có trải nghiệm tương tác như Chế độ Giọng nói.

Một số người ban đầu muốn tìm một "sản phẩm thay thế ChatGPT dễ bảo hơn", nhưng phát hiện tính cách của Claude mạnh mẽ hơn, cần thời gian để thích nghi. Một hướng dẫn chuyển đổi của TechRadar được chia sẻ rộng rãi trong hai ngày này, tiêu đề là "Những điều tôi ước ai đó đã nói với tôi", thông tin cốt lõi của bài viết là: Logic sử dụng của Claude và ChatGPT về cơ bản khác nhau, cái trước giống một đối tác làm việc có lập trường hơn, cái sau giống một trợ lý vạn năng hơn.

Sự khác biệt này vốn là định vị riêng của hai sản phẩm, nhưng bị sự kiện này phóng đại một cách bất ngờ. Người dùng đổ về Claude vì lập trường đạo đức, sau đó phát hiện ra một sản phẩm khác với kỳ vọng của họ, một AI kén chọn hơn, có ranh giới rõ ràng hơn. Điều này vốn có thể là lý do để rời đi, nhưng tại thời điểm đặc biệt này, nó lại trở thành lý do để ở lại: Bạn tin tưởng vào lập trường của một công ty, thì càng dễ dàng chấp nhận logic sản phẩm của họ.

Sau vài ngày ra mắt, Anthropic công bố dữ liệu: Người dùng hoạt động miễn phí tăng hơn 60% so với tháng 1, số lượt đăng ký mới hàng ngày tăng gấp bốn lần. Claude từng bị ngừng hoạt động do lượng truy cập quá lớn, hàng nghìn người dùng báo cáo không thể đăng nhập, được khắc phục trong vài giờ.

Ba từ trong hợp đồng: OpenAI đã nói gì và làm gì

Anthropic là công ty thương mại đầu tiên triển khai mô hình AI vào mạng lưới bí mật của quân đội Mỹ, hợp tác được thực hiện thông qua Palantir, giá trị hợp đồng khoảng 200 triệu USD. Nhưng trong vài tháng qua, mối quan hệ giữa hai bên tiếp tục xấu đi. Cốt lõi tranh cãi là một điều khoản: Lầu Năm Góc yêu cầu mô hình AI mở cho "tất cả mục đích hợp pháp", không đính kèm bất kỳ điều kiện nào. Anthropic thì kiên quyết ghi rõ hai ngoại lệ, không được sử dụng để giám sát hàng loạt công dân Mỹ, không được sử dụng cho hệ thống vũ khí tự động hoàn toàn.

Vào khoảng ngày 20 tháng 2, theo báo cáo, một giám đốc điều hành của Anthropic đã chất vấn đối tác Palantir về cách thức sử dụng Claude trong chiến dịch bắt giữ Tổng thống Venezuela Maduro của quân đội Mỹ vào tháng 1, khiến quân đội cực kỳ bất mãn. Vào thứ Năm, Lầu Năm Góc đưa ra tối hậu thư, yêu cầu Dario Amodei đưa ra câu trả lời trước 5 giờ chiều cùng ngày.

Amodei đã đưa ra tuyên bố trước thời hạn, nói rằng công ty không thể chấp nhận các điều khoản hiện tại, "không phải vì chúng tôi phản đối mục đích quân sự, mà trong một số ít trường hợp, chúng tôi tin rằng AI có khả năng phá hoại hơn là bảo vệ các giá trị dân chủ". Trump ngay lập tức tuyên bố tất cả cơ quan liên bang ngừng sử dụng sản phẩm Anthropic trong sáu tháng, Hegseth liệt công ty này vào danh sách "rủi ro an ninh chuỗi cung ứng", nhãn này thường được sử dụng cho các công ty đối thủ nước ngoài. Hợp đồng chấm dứt từ đó.

Vị trí trống nhanh chóng được lấp đầy. Ngay trong ngày hôm đó, OpenAI thông báo ký kết hợp đồng với Lầu Năm Góc. Trong thư nội bộ thứ Năm, lập trường của Altman vẫn rõ ràng, anh viết rằng đây đã là "vấn đề của toàn ngành", nói rằng OpenAI và Anthropic có cùng "lằn ranh đỏ": phản đối giám sát hàng loạt, phản đối vũ khí tự động. Vào thứ Sáu, thỏa thuận đạt được, sẽ triển khai mô hình trong mạng lưới bí mật của quân đội, giới hạn chỉ chạy trên đám mây, cử kỹ sư giám sát, và tuyên bố đã ghi rõ hai hạn chế tương tự trong hợp đồng.

Altman sau đó mở phiên hỏi đáp trên X, giải đáp trong vài giờ. Có người hỏi anh: Tại sao Lầu Năm Góc chấp nhận OpenAI, lại cấm Anthropic? Câu trả lời của anh là: "Anthropic dường như tập trung hơn vào các điều khoản cấm cụ thể trong hợp đồng, thay vì viện dẫn luật áp dụng, còn chúng tôi hài lòng với việc viện dẫn luật."

Câu nói này nói về sự khác biệt phương pháp luận, nhưng nó mở ra tranh cãi thực sự của vấn đề này.

Điểm then chốt khiến Anthropic đàm phán thất bại là cụm từ mà Lầu Năm Góc kiên quyết đưa vào: Hệ thống AI có thể được sử dụng cho "all lawful purposes", tức là tất cả mục đích hợp pháp. Lý do Anthropic từ chối là, cụm từ này trong ngữ cảnh an ninh quốc gia không phải là một ranh giới cố định. Luật hiện hành ở nhiều mặt chưa theo kịp khả năng của AI, phạm vi "hợp pháp" sẽ do chính phủ tự giải thích. OpenAI đã ký cụm từ này, đồng thời tuyên bố đã thảo luận về các biện pháp bảo vệ tương tự trong hợp đồng.

Các chuyên gia pháp lý sau đó đã phân tích các điều khoản hợp đồng công khai của OpenAI, chỉ ra hai vấn đề cụ thể về cách diễn đạt.

Điều khoản giám sát viết rằng, hệ thống không được sử dụng để giám sát thông tin cá nhân của công dân Mỹ một cách "unconstrained" (không bị ràng buộc). Phó chủ tịch chính sách của Trung tâm Dân chủ và Công nghệ, Samir Jain, chỉ ra rằng, cách diễn đạt ở đây có nghĩa là phiên bản giám sát "bị ràng buộc" được cho phép. Trong khuôn khổ pháp lý hiện hành, chính phủ hoàn toàn có thể mua hợp pháp hồ sơ vị trí, lịch sử duyệt web và dữ liệu tài chính của công dân từ các nhà môi giới dữ liệu, để AI phân tích những dữ liệu này, về mặt kỹ thuật không cấu thành "giám sát bất hợp pháp". Amodei trong cuộc phỏng vấn sau đó với CBS đã lấy chính ví dụ này.

Điều khoản vũ khí viết rằng, hệ thống không được sử dụng cho vũ khí tự động trong "các trường hợp luật pháp, quy định hoặc chính sách của bộ yêu cầu sự kiểm soát của con người". Cụm từ hạn định này có nghĩa là, hạn chế chỉ có hiệu lực khi các quy định khác đã yêu cầu sự kiểm soát của con người, sức ràng buộc hoàn toàn mượn từ chính sách hiện có. Và Lầu Năm Góc có quyền sửa đổi chính sách nội bộ của mình bất cứ lúc nào. Học giả pháp lý Charles Bullock viết trên X rằng, điều khoản vũ khí trong hợp đồng dựa vào Chỉ thị DoD 3000.09, chỉ thị này yêu cầu chỉ huy giữ lại "mức độ phán đoán của con người thích hợp", và "mức độ thích hợp" này là một tiêu chuẩn có thể được giải thích linh hoạt.

<