Jensen Huang's GTC Keynote Full Text: The Era of Inference Has Arrived, Lobster is the New Operating System

- Key Takeaway: At GTC 2026, NVIDIA outlined its transformation from a chip company to an "AI infrastructure and factory company." Based on the business logic of "Token Factory Economics," it provided a strong demand forecast of at least $1 trillion by 2027.

- Key Elements:

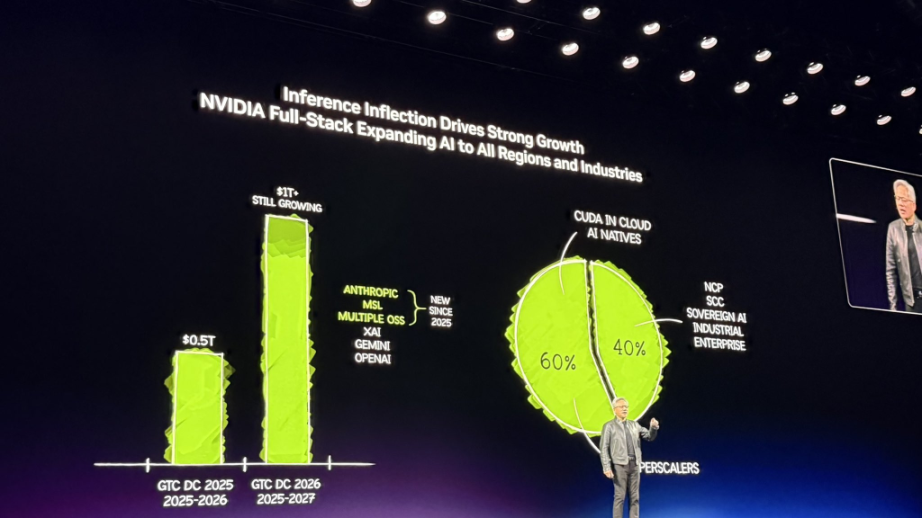

- Earnings Guidance: Jensen Huang stated that NVIDIA's demand expectation through 2027 is at least $1 trillion, and he believes actual demand will be even higher. This forecast once drove the stock price up over 4.3%.

- Token Factory Economics: Future data centers are "factories" producing AI Tokens. Under fixed power constraints, the system with the highest Token throughput per watt has the lowest production cost, directly determining revenue.

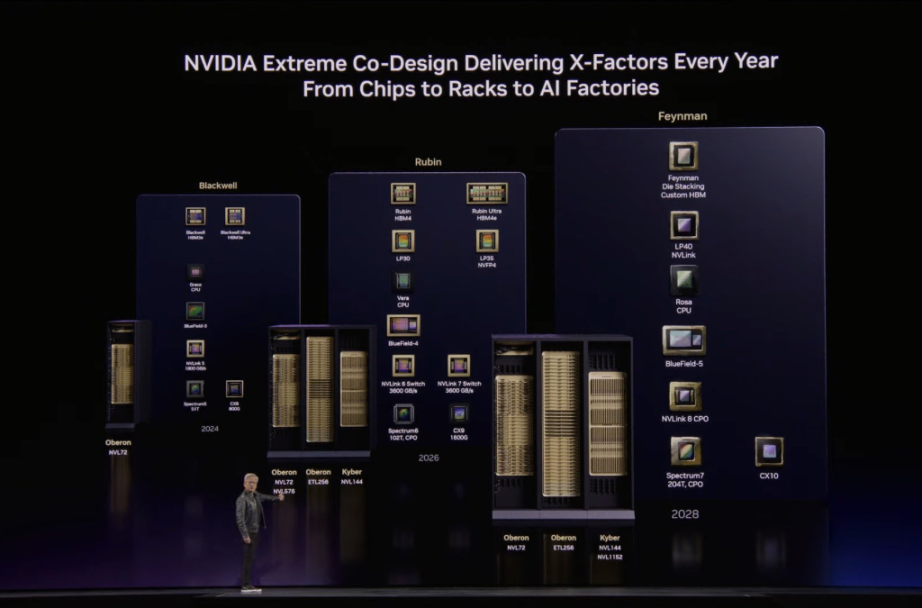

- Technological Breakthrough: The new-generation AI computing system, Vera Rubin, through end-to-end co-design, increased Token generation speed by 350 times within two years, far exceeding Moore's Law's 1.5x improvement.

- Ecosystem and Software Revolution: The open-source project OpenClaw is seen as the "operating system" for the Agent era. Jensen Huang asserts that all SaaS companies will transform into AaaS (Agent-as-a-Service) companies.

- Market Structure: 60% of NVIDIA's business comes from the top five cloud service providers, while 40% is widely distributed across sovereign clouds, enterprises, industrial sectors, robotics, and edge computing, demonstrating broad industry coverage.

ผู้เขียนต้นฉบับ: Bao Yilong

แหล่งที่มาดั้งเดิม: Wall Street Insights

วันที่ 16 มีนาคม 2026 การประชุม NVIDIA GTC 2026 ได้เปิดฉากขึ้นอย่างเป็นทางการ โดย Jensen Huang ผู้ก่อตั้งและซีอีโอของ NVIDIA ได้กล่าวสุนทรพจน์หลัก

ในการประชุมที่ถือเป็น "การแสวงบุญประจำปีของอุตสาหกรรม AI" นี้ Huang ได้อธิบายถึงการเปลี่ยนแปลงของ NVIDIA จากบริษัท "ชิป" สู่บริษัท "โครงสร้างพื้นฐานและโรงงาน AI" ในการเผชิญกับปัญหาที่ตลาดกังวลที่สุดเกี่ยวกับความยั่งยืนของผลประกอบการและพื้นที่การเติบโต Huang ได้แยกแยะตรรกะทางธุรกิจพื้นฐานที่ขับเคลื่อนการเติบโตในอนาคตอย่างละเอียด นั่นคือ "เศรษฐศาสตร์โรงงานโทเค็น"

แนวทางผลประกอบการมองโลกในแง่ดีอย่างยิ่ง "ความต้องการอย่างน้อย 1 ล้านล้านดอลลาร์ภายในปี 2027"

ในช่วงสองปีที่ผ่านมา ความต้องการการคำนวณ AI ทั่วโลกได้ระเบิดแบบทวีคูณ เมื่อโมเดลขนาดใหญ่พัฒนาจาก "การรับรู้" และ "การสร้าง" ไปสู่ "การให้เหตุผล" และ "การกระทำ (การทำงาน)" การใช้กำลังการประมวลผลก็เพิ่มขึ้นอย่างรวดเร็ว สำหรับเพดานคำสั่งซื้อและรายได้ที่ตลาดให้ความสำคัญสูง Huang ได้ให้การคาดการณ์ที่แข็งแกร่งอย่างมาก

Huang กล่าวในสุนทรพจน์อย่างตรงไปตรงมาว่า:

เมื่อปีที่แล้ว ณ เวลานี้ ฉันเคยพูดว่า เราเห็นความต้องการที่มั่นใจสูง 5 แสนล้านดอลลาร์ ครอบคลุม Blackwell และ Rubin จนถึงปี 2026 ตอนนี้ ณ ที่นี่ ฉันเห็นความต้องการอย่างน้อย 1 ล้านล้านดอลลาร์ (at least $1 trillion) ภายในปี 2027

การคาดการณ์ถึงล้านล้านของ Huang เคยผลักดันให้หุ้น NVIDIA เพิ่มขึ้นเกิน 4.3%

ไม่เพียงเท่านั้น เขายังได้เสริมตัวเลขนี้:

มันสมเหตุสมผลไหม? นี่คือสิ่งที่ฉันจะพูดต่อไป จริงๆ แล้ว เราจะมีอุปทานไม่เพียงเสียอีก ฉันมั่นใจว่าความต้องการการคำนวณจริงจะสูงกว่านี้มาก

Huang ชี้ให้เห็นว่าระบบ NVIDIA ในปัจจุบันได้พิสูจน์ตัวเองแล้วว่าเป็น "โครงสร้างพื้นฐานที่มีต้นทุนต่ำที่สุดในโลก" เนื่องจาก NVIDIA สามารถรันโมเดล AI ในเกือบทุกสาขา ความเป็นสากลนี้ทำให้ลูกค้าสามารถใช้ประโยชน์จากเงินลงทุน 1 ล้านล้านดอลลาร์นี้ได้อย่างเต็มที่และรักษาวงจรชีวิตที่ยาวนาน

ปัจจุบัน ธุรกิจ 60% ของ NVIDIA มาจากผู้ให้บริการคลาวด์ขนาดใหญ่ 5 อันดับแรก ในขณะที่อีก 40% ของธุรกิจกระจายอยู่ทั่วทุกสาขา เช่น คลาวด์อธิปไตย องค์กร อุตสาหกรรม หุ่นยนต์ และการคำนวณแบบเอจ

เศรษฐศาสตร์โรงงานโทเค็น ประสิทธิภาพต่อวัตต์กำหนดเส้นทางธุรกิจ

เพื่ออธิบายความสมเหตุสมผลของความต้องการ 1 ล้านล้านนี้ Huang ได้แสดงให้ซีอีโอของบริษัททั่วโลกเห็นถึงชุดความคิดทางธุรกิจใหม่ เขาชี้ให้เห็นว่าศูนย์ข้อมูลในอนาคตจะไม่ใช่คลังเก็บไฟล์อีกต่อไป แต่เป็น "โรงงาน" ที่ผลิตโทเค็น (หน่วยพื้นฐานที่สร้างโดย AI)

Huang เน้นย้ำ:

ศูนย์ข้อมูลทุกแห่ง โรงงานทุกแห่ง ตามคำจำกัดความแล้วถูกจำกัดด้วยพลังงาน โรงงานขนาด 1GW (กิกะวัตต์) จะไม่มีวันกลายเป็น 2GW นี่คือกฎของฟิสิกส์และอะตอม ด้วยกำลังไฟฟ้าที่คงที่ ใครที่มีปริมาณการส่งผ่านโทเค็นต่อวัตต์สูงสุด ก็จะมีต้นทุนการผลิตต่ำที่สุด

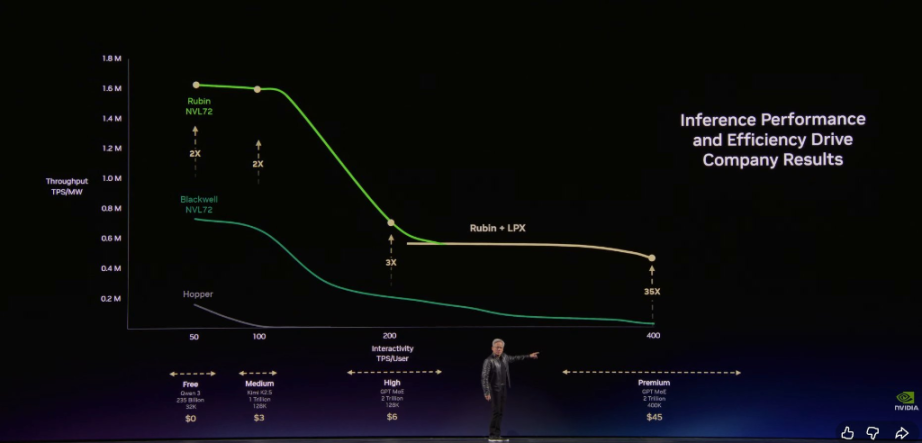

Huang แบ่งบริการ AI ในอนาคตออกเป็นห้าระดับทางธุรกิจ:

- ระดับฟรี (ปริมาณการส่งผ่านสูง ความเร็วต่ำ)

- ระดับกลาง (~ 3 ดอลลาร์ต่อล้านโทเค็น)

- ระดับสูง (~ 6 ดอลลาร์ต่อล้านโทเค็น)

- ระดับความเร็วสูง (~ 45 ดอลลาร์ต่อล้านโทเค็น)

- ระดับความเร็วสูงพิเศษ (~ 150 ดอลลาร์ต่อล้านโทเค็น)

เขาชี้ให้เห็นว่าเมื่อโมเดลใหญ่ขึ้นและคอนเท็กซ์ยาวขึ้น AI จะฉลาดขึ้น แต่อัตราการสร้างโทเค็นจะลดลง Huang กล่าวว่า:

ในโรงงานโทเค็นนี้ ปริมาณการส่งผ่านและความเร็วในการสร้างโทเค็นของคุณ จะถูกแปลงเป็นรายได้ที่แม่นยำของคุณในปีหน้าโดยตรง

Huang เน้นย้ำว่าสถาปัตยกรรมของ NVIDIA ช่วยให้ลูกค้าสามารถบรรลุปริมาณการส่งผ่านที่สูงมากในระดับฟรี ในขณะเดียวกันก็เพิ่มประสิทธิภาพได้ถึง 35 เท่าอย่างน่าทึ่งในระดับการให้เหตุผลที่มีมูลค่าสูงสุด

Vera Rubin เร่งความเร็ว 350 เท่าในสองปี, Groq เติมเต็มการให้เหตุผลความเร็วสูงสุด

ภายใต้ข้อจำกัดทางกายภาพนี้ NVIDIA ได้แนะนำระบบการคำนวณ AI ที่ซับซ้อนที่สุดในประวัติศาสตร์ Vera Rubin Huang กล่าวว่า:

ในอดีตเมื่อพูดถึง Hopper ฉันจะยกชิปขึ้นมา มันน่ารักดี แต่เมื่อพูดถึง Vera Rubin ทุกคนจะนึกถึงทั้งระบบ ในระบบที่ระบายความร้อนด้วยของเหลว 100% และกำจัดสายเคเบิลแบบดั้งเดิมโดยสิ้นเชิงนี้ ตอนนี้ใช้เวลาเพียงสองชั่วโมงในการติดตั้งแร็คที่เคยใช้เวลาสองวัน

Huang ชี้ให้เห็นว่า ผ่านการออกแบบร่วมระหว่างซอฟต์แวร์และฮาร์ดแวร์แบบ end-to-end ที่สุดขั้ว Vera Rubin ได้สร้างการก้าวกระโดดของข้อมูลที่น่าทึ่งในศูนย์ข้อมูล 1GW เดียวกัน:

ภายในเวลาเพียงสองปี เราได้เพิ่มอัตราการสร้างโทเค็นจาก 22 ล้านเป็น 700 ล้าน ซึ่งเป็นการเติบโต 350 เท่า กฎของมัวร์สามารถให้การปรับปรุงได้เพียงประมาณ 1.5 เท่าในช่วงเวลาเดียวกัน

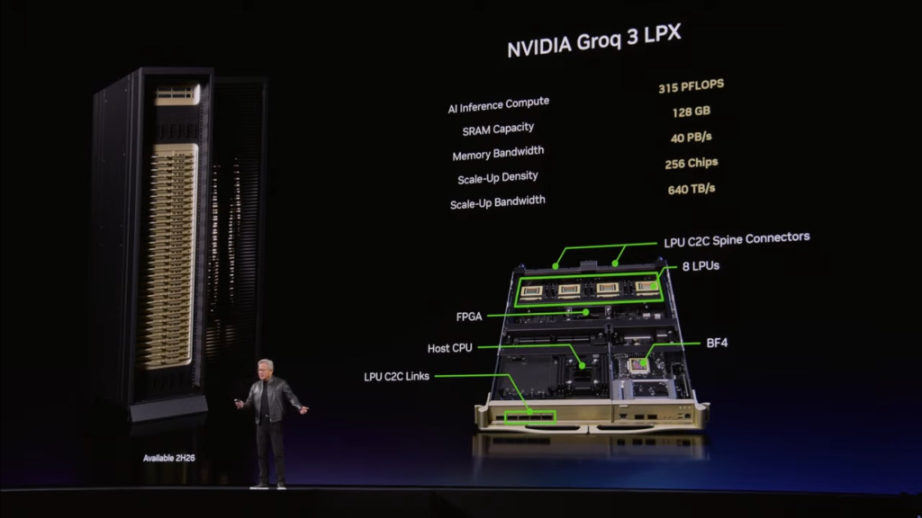

เพื่อแก้ไขปัญหาคอขวดของแบนด์วิธภายใต้เงื่อนไขการให้เหตุผลความเร็วสูงสุด (เช่น 1000 โทเค็น/วินาที) NVIDIA ได้ให้แนวทางสุดท้ายในการบูรณาการบริษัทที่ถูกซื้อมา Groq: การให้เหตุผลแบบแยกส่วนแบบไม่สมมาตร Huang อธิบาย:

คุณสมบัติของโปรเซสเซอร์ทั้งสองรุ่นนี้แตกต่างกันโดยสิ้นเชิง ชิป Groq มี SRAM 500MB ในขณะที่ชิป Rubin หนึ่งตัวมีหน่วยความจำ 288GB

Huang ชี้ให้เห็นว่า NVIDIA ผ่านระบบซอฟต์แวร์ Dynamo มอบหมายขั้นตอน "การเติมล่วงหน้า (Pre-fill)" ที่ต้องการการคำนวณและหน่วยความจำกราฟิกจำนวนมหาศาลให้กับ Vera Rubin และมอบหมายขั้นตอน "การถอดรหัส" ที่ไวต่อความหน่วงสูงให้กับ Groq Huang ยังให้คำแนะนำเกี่ยวกับการกำหนดค่ากำลังการประมวลผลขององค์กร:

หากงานของคุณส่วนใหญ่เป็นปริมาณการส่งผ่านสูง ให้ใช้ Vera Rubin 100%; หากคุณมีความต้องการสร้างโทเค็นระดับโปรแกรมมิ่งที่มีมูลค่าสูงจำนวนมาก ให้จัดสรรขนาดศูนย์ข้อมูล 25% ให้กับ Groq

มีการเปิดเผยว่าชิป Groq LP30 ที่ผลิตโดย Samsung กำลังอยู่ในขั้นตอนการผลิตจำนวนมาก คาดว่าจะจัดส่งในไตรมาสที่สาม ในขณะที่แร็ค Vera Rubin แรกได้ทำงานบน Microsoft Azure Cloud แล้ว

นอกจากนี้ สำหรับเทคโนโลยีการเชื่อมต่อด้วยแสง Huang ได้แสดงสวิตช์ Spectrum X ซึ่งเป็นสวิตช์แบบ Co-Packaged Optics (CPO) รุ่นแรกของโลกที่ผลิตจำนวนมาก และทำให้ข้อถกเถียงเกี่ยวกับเส้นทาง "ทองแดงลดลง แสงเพิ่มขึ้น" ในตลาดสงบลง:

เราต้องการกำลังการผลิตสายเคเบิลทองแดงมากขึ้น กำลังการผลิตชิปแสงมากขึ้น กำลังการผลิต CPO มากขึ้น

Agent สิ้นสุด SaaS แบบดั้งเดิม "เงินเดือนประจำปี + โทเค็น" กลายเป็นมาตรฐานในซิลิคอนแวลลีย์

นอกจากกำแพงฮาร์ดแวร์แล้ว Huang ยังใช้พื้นที่จำนวนมากสำหรับการปฏิวัติซอฟต์แวร์และระบบนิเวศ AI โดยเฉพาะอย่างยิ่งการระเบิดของ Agent (เอเจนต์อัจฉริยะ)

เขาอธิบายโครงการโอเพ่นซอร์ส OpenClaw ว่าเป็น "โครงการโอเพ่นซอร์สที่ได้รับความนิยมมากที่สุดในประวัติศาสตร์ของมนุษย์" โดยกล่าวว่ามันใช้เวลาเพียงไม่กี่สัปดาห์ในการแซงหน้าความสำเร็จของ Linux ในช่วง 30 ปีที่ผ่านมา Huang กล่าวอย่างตรงไปตรงมาว่า OpenClaw เป็น "ระบบปฏิบัติการ" ของคอมพิวเตอร์เอเจนต์โดยพื้นฐาน

Huang ยืนยันว่า:

ทุกบริษัท SaaS (ซอฟต์แวร์เป็นบริการ) จะกลายเป็นบริษัท AaaS (Agent-as-a-Service, เอเจนต์เป็นบริการ) ไม่ต้องสงสัยเลย เพื่อให้เอเจนต์ที่มีความสามารถในการเข้าถึงข้อมูลที่ละเอียดอ่อนและรันโค้ดสามารถนำไปใช้ได้อย่างปลอดภัย NVIDIA ได้เปิดตัวการออกแบบอ้างอิงระดับองค์กร NeMo Claw ซึ่งเพิ่มเครื่องยนต์นโยบายและเราเตอร์ความเป็นส่วนตัว

สำหรับคนทำงานทั่วไป การเปลี่ยนแปลงนี้ก็ใกล้ตัวเช่นกัน Huang วาดภาพรูปแบบใหม่ของสถานที่ทำงานในอนาคต:

ในอนาคต วิศวกรทุกคนในบริษัทของเราจะต้องมีงบประมาณโทเค็นประจำปี เงินเดือนพื้นฐานประจำปีของพวกเขาอาจเป็นหลายแสนดอลลาร์ ฉันจะเพิ่มจำนวนเงินประมาณครึ่งหนึ่งของจำนวนนั้นเป็นโควต้าโทเค็นให้พวกเขา เพื่อให้พวกเขาบรรลุการเพิ่มประสิทธิภาพ 10 เท่า นี่คือข้อเสนอใหม่ในการจ้างงานในซิลิคอนแวลลีย์แล้ว: ข้อเสนอของคุณมีโทเค็นเท่าไหร่?

ในตอนท้ายของสุนทรพจน์ Huang ยัง "สปอยล์" สถาปัตยกรรมการคำนวณรุ่นต่อไป Feynman ซึ่งจะทำให้การขยายขนาดในแนวนอนร่วมกันของสายทองแดงและ CPO เป็นครั้งแรก และที่น่าคิดยิ่งกว่านั้น NVIDIA กำลังพัฒนาคอมพิวเตอร์ศูนย์ข้อมูลที่ติดตั้งในอวกาศ "Vera Rubin Space-1" ซึ่งเปิดจินตนาการของการขยายกำลังการประมวลผล AI ออกไปนอกโลกโดยสิ้นเชิง

สุนทรพจน์เต็มของ Jensen Huang ใน GTC 2026 แปลเป็นภาษาไทยทั้งหมดดังนี้ (ด้วยความช่วยเหลือจากเครื่องมือ AI):

พิธีกร: ยินดีต้อนรับผู้ก่อตั้งและซีอีโอของ NVIDIA Jensen Huang ขึ้นเวที

Jensen Huang ผู้ก่อตั้งและซีอีโอ:

ยินดีต้อนรับสู่ GTC ฉันอยากเตือนทุกคนว่านี่คือการประชุมทางเทคนิค ฉันรู้สึกดีใจมากที่ได้เห็นผู้คนจำนวนมากต่อแถวเข้าในตอนเช้า และได้เห็นทุกท่านที่นั่งอยู่

ใน GTC เราจะมุ่งเน้นไปที่สามหัวข้อหลัก: เทคโนโลยี แพลตฟอร์ม และระบบนิเวศ NVIDIA มีสามแพลตฟอร์มในปัจจุบัน: แพลตฟอร์ม CUDA-X แพลตฟอร์มระบบ และแพลตฟอร์มโรงงาน AI ล่าสุดของเรา

ก่อนเริ่มต้นอย่างเป็นทางการ ฉันขอขอบคุณพิธีกรในช่วงอุ่นเครื่องของเรา ได้แก่ Sarah Guo จาก Conviction, Alfred Lin จาก Sequoia Capital (นักลงทุนเสี่ยงรายแรกของ NVIDIA) และ Gavin Baker นักลงทุนสถาบันหลักรายแรกของ NVIDIA ทั้งสามท่านนี้มีความเข้าใจเชิงลึกเกี่ยวกับเทคโนโลยี และมีอิทธิพลกว้างขวางทั่วทั้งระบบนิเวศเทคโนโลยี แน่นอน ฉันยังต้องขอบคุณแขกผู้มีเกียรติทั้งหมดที่ฉันเชิญมาเข้าร่วมในวันนี้ ขอบคุณทีมออลสตาร์นี้

ฉันยังต้องขอบคุณบริษัททั้งหมดที่มาร่วมงานในวันนี้ NVIDIA เป็นบริษัทแพลตฟอร์ม เรามีเทคโนโลยี แพลตฟอร์ม และระบบนิเวศที่หลากหลาย บริษัทที่มาร่วมงานในวันนี้เป็นตัวแทนของผู้เล่นเกือบทั้งหมดในอุตสาหกรรมที่มีมูลค่า 1 ล้านล้านดอลลาร์ มีบริษัททั้งหมด 450 แห่งที่ให้การสนับสนุนกิจกรรมนี้ ฉันขอขอบคุณอย่างสุดซึ้ง

การประชุมครั้งนี้มีฟอรัมทางเทคนิค 1,000 รายการ ผู้บรรยาย 2,000 คน ซึ่งจะครอบคลุมทุกชั้นของโครงสร้าง "เค้กห้าชั้น" ของปัญญาประดิษฐ์ ตั้งแต่โครงสร้างพื้นฐาน เช่น ที่ดิน ไฟฟ้า และห้องเซิร์ฟเวอร์ ไปจนถึงชิป แพลตฟอร์ม โมเดล และแอปพลิเคชันต่างๆ ที่ขับเคลื่อนอุตสาหกรรมทั้งหมดให้เติบโตในที่สุด

CUDA: สองทศวรรษของการสะสมเทคโนโลยี

จุดเริ่มต้นของทุกสิ่งอยู่ที่นี่ ปีนี้เป็นปีครบรอบ 20 ปีของ CUDA

ตลอดสองทศวรรษที่ผ่านมา เรามุ่งมั่นกับการพัฒนาสถาปัตยกรรมนี้อย่างต่อเนื่อง CUDA เป็นสิ่งประดิษฐ์ที่ปฏิวัติวงการ เทคโนโลยี SIMT (Single Instruction, Multiple Threads) อนุญาตให้นักพัฒนาเขียนโปรแกรมด้วยโค้ดสเกลาร์ และขยายเป็นแอปพลิเคชันแบบมัลติเธรด ซึ่งง่ายต่อการเขียนโปรแกรมกว่าสถาปัตยกรรม SIMD ก่อนหน้านี้มาก เรายังเพิ่มฟังก์ชัน Tiles ล่าสุด เพื่อช่วยให้นักพัฒนาเขียนโปรแกรม Tensor Core และโครงสร้างการคำนวณทางคณิตศาสตร์ต่างๆ ที่ AI ในปัจจุบันพึ่งพาได้ง่ายขึ้น ปัจจุบัน CUDA มีเครื่องมือ คอมไพเลอร์ เฟรมเวิร์ก และไลบรารีหลายพันรายการ มีโครงการสาธารณะหลายแสนโครงการในชุมชนโอเพ่นซอร์ส และได้รับการบูรณาการอย่างลึกซึ้งเข้ากับระบบนิเวศเทคโนโลยีทุกแห่ง

แผนภูมินี้เผยให้เห็นตรรกะเชิงกลยุทธ์ 100% ของ NVIDIA ซึ่งฉันได้พูดถึงสไลด์นี้มาตั้งแต่แรก องค์ประกอบที่ยากที่สุดและเป็นแกนกลางที่สุดคือ "จำนวนการติดตั้ง" ที่ด้านล่างของแผนภูมิ ผ่านไปสองทศวรรษ เราได้สะสม GPU และระบบคอมพิวเตอร์หลายร้อยล้านตัวที่รัน CUDA ทั่วโลก

GPU ของเราครอบคลุมแพลตฟอร์มคลาวด์ทั้งหมด ให้บริการผู้ผลิตคอมพิวเตอร์และอุตสาหกรรมเกือบทั้งหมด จำนวนการติดตั้ง CUDA ที่มากมายมหาศาลนี้คือเหตุผลพื้นฐานที่ทำให้