การเติบโตแบบทวีคูณของ AI

พื้นที่คริปโตในปัจจุบันกำลังถูกกระตุ้นด้วยเรื่องราวสำคัญสองเรื่อง ได้แก่ การเติบโตของเศรษฐกิจเอเจนต์ AI อัตโนมัติ และการเติบโตควบคู่กันของตลาดการทำนายแบบออนเชน กระแสนี้ ซึ่งเห็นได้จากโปรโตคอล x402 กำลังทำให้มาตรฐานการ "จ่าย" ให้กับเอเจนต์อัจฉริยะสำหรับการเรียกใช้ API เป็นมาตรฐาน ในขณะเดียวกัน แพลตฟอร์มอย่าง Polymarket กำลังแสดงให้เห็นว่า "การกำหนดราคาปัญญาประดิษฐ์แบบรวมหมู่" เป็นตลาดที่มีมูลค่าหลายพันล้านดอลลาร์

แนวโน้มทั้งสองนี้กำลังบรรจบกันบนปัจจัยสำคัญเพียงหนึ่งเดียว นั่นคือข้อมูล ตัวแทน AI ต้องใช้ข้อมูลภายนอกเพื่อประกอบการตัดสินใจ และตลาดการทำนายที่ไม่มีออราเคิลที่เชื่อถือได้เพื่อกำหนดผลลัพธ์ก็ไร้ประโยชน์!

การนำ x402 มาใช้อย่างแพร่หลายได้เปลี่ยนปัญหาเชิงทฤษฎีนี้ให้กลายเป็นความจริงเร่งด่วน: เมื่อเอเจนต์ AI สามารถจ่ายเงินเพื่อเรียกใช้ API ใดๆ โดยอัตโนมัติ แล้วมันจะเชื่อถือผลลัพธ์ที่ส่งกลับมาได้อย่างไร? สิ่งนี้ก่อให้เกิดความต้องการที่มีความเสี่ยงสูงอย่างมหาศาล นั่นคือ ความต้องการออราเคิลที่สามารถป้อนข้อมูลจากโลกภายนอก (Web2) เข้าสู่บล็อกเชนได้อย่างน่าเชื่อถือ (Web3)

"แมลง" ของคำทำนายแบบดั้งเดิม

นี่คือข้อบกพร่องของโมเดลโอราเคิลกระแสหลักที่เรียกกันทั่วไปว่า "ฉันทามติตามชื่อเสียง"

ออราเคิลแบบดั้งเดิม (เช่น Chainlink) ออกแบบมาเพื่อให้ข้อมูลที่เรียบง่าย เปิดเผยต่อสาธารณะ และสามารถตรวจสอบได้ง่าย ตัวอย่างเช่น ในการหาราคาของ SUI/USD เครือข่ายออราเคิลแบบกระจายศูนย์ (DON) จำเป็นต้องมีโหนดอิสระเพียง 20 โหนด เพื่อค้นหาราคาจากตลาดแลกเปลี่ยน 10 แห่ง แล้วจึงรายงานค่ามัธยฐาน หากโหนดใดอยู่ผิดที่ โหนดนั้นจะถูกโหวตออก

อย่างไรก็ตาม โมเดลจะพังลงเมื่อข้อมูลมีความซับซ้อน เป็นส่วนตัว และไม่แน่นอน

สมมติว่าตัวแทน AI จำเป็นต้องดำเนินการธุรกรรมที่มีมูลค่าสูงตามคำเตือนที่ซับซ้อนที่ส่งไปยัง OpenAI:

- จุดบกพร่องด้านความเป็นส่วนตัว: ตัวแทนไม่สามารถใช้ Prompt ที่เป็นกรรมสิทธิ์ได้ และที่สำคัญกว่านั้นคือ ไม่สามารถออกอากาศ API_KEY ไปยังโหนดที่แตกต่างกัน 20 โหนดได้

- ข้อบกพร่องของ Consensus: แม้ว่าจะเป็นไปได้ แต่โหนด 20 โหนดที่ถามคำถามที่ซับซ้อนเดียวกันของ OpenAI อาจให้ผลลัพธ์ที่แตกต่างกันเล็กน้อย 20 คำตอบที่ไม่แน่นอน ไม่มี "ค่ามัธยฐาน" ให้โหวต

สิ่งนี้บังคับให้เอเจนต์ต้องทำสิ่งที่ระบบที่ไม่ไว้วางใจไม่ควรทำ นั่นคือการไว้วางใจโหนด Oracle ส่วนกลางเพียงโหนดเดียว ความปลอดภัยทั้งหมดของโปรโตคอลมูลค่าหลายล้านดอลลาร์ตอนนี้ขึ้นอยู่กับ "ความหวัง" ว่าโหนดเดียวนี้จะไม่ถูกแฮ็ก ไม่ได้เป็นอันตราย หรือไม่ได้ส่งคืนผลลัพธ์ที่ผิดพลาดเพื่อความสะดวก

คำถามที่ลึกซึ้งยิ่งขึ้น: ออราเคิล AI ที่ใช้ความน่าเชื่อถือ

คุณอาจคิดว่า: การแก้ปัญหานั้นเพียงแค่ปล่อยให้ AI Agent เรียกใช้ API โดยตรงเท่านั้นใช่หรือไม่?

อย่างไรก็ตาม แนวคิดนี้เรียบง่ายเกินไป สัญญาอัจฉริยะบน Sui เองไม่สามารถส่งคำขอ HTTPS ไปยัง OpenAI ได้ เพราะมันเป็นระบบปิดที่กำหนดตายตัว จึง ต้อง อาศัยผู้เข้าร่วมนอกเครือข่ายเพื่อ "ถ่ายโอน" ข้อมูล

วิธีแก้ปัญหาที่ดูเหมือนจะชัดเจนคือการสร้าง "AI oracle" เฉพาะทางที่เพียงแค่เรียกใช้ API และส่งผลลัพธ์กลับมา อย่างไรก็ตาม วิธีนี้ไม่ได้แก้ปัญหาหลัก สัญญาอัจฉริยะยังคง ไว้วางใจโหนดนั้นอย่างงมงาย มันไม่สามารถตรวจสอบได้:

- โหนดนี้เรียกใช้ api.openai.com จริงหรือไม่ ?

- หรือว่ามันเรียกเซิร์ฟเวอร์ที่ถูกกว่าแต่ ดู เป็นอันตราย?

- มันได้ แทรกแซง การตอบสนองเพื่อจัดการตลาดการทำนายหรือไม่?

นี่คือทางตันที่แท้จริง: เศรษฐกิจตัวแทน AI ไม่สามารถสร้างขึ้นจาก "ชื่อเสียง" ได้ แต่จะต้องสร้างขึ้นจาก "หลักฐาน"

โซลูชัน: DeAgentAI zkTLS AI Oracle

นี่คือความท้าทายที่ DeAgentAI ในฐานะโครงสร้างพื้นฐานเอเจนต์ AI ชั้นนำ มุ่งมั่นที่จะแก้ไข แทนที่จะสร้าง Oracle ที่ "น่าเชื่อถือมากขึ้น" เรากลับสร้าง Oracle ที่ไม่จำเป็นต้องไว้วางใจเลย

เราบรรลุเป้าหมายนี้ได้โดยการเปลี่ยนกระบวนทัศน์ทั้งหมดจากฉันทามติด้านชื่อเสียงเป็นฉันทามติด้านการเข้ารหัส โซลูชันนี้คือ Oracle เฉพาะทาง AI ที่สร้างขึ้นบน zkTLS (Zero Knowledge Transport Layer Security)

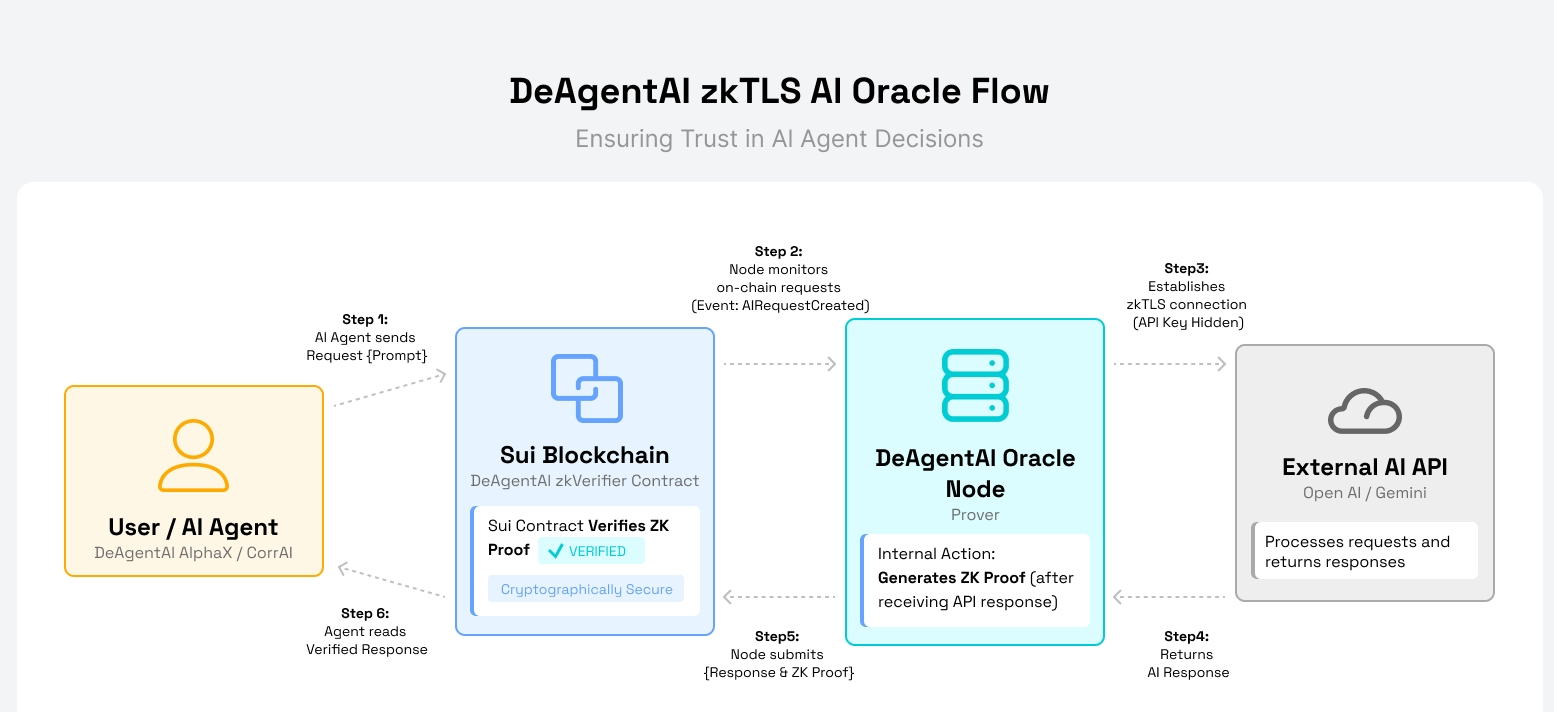

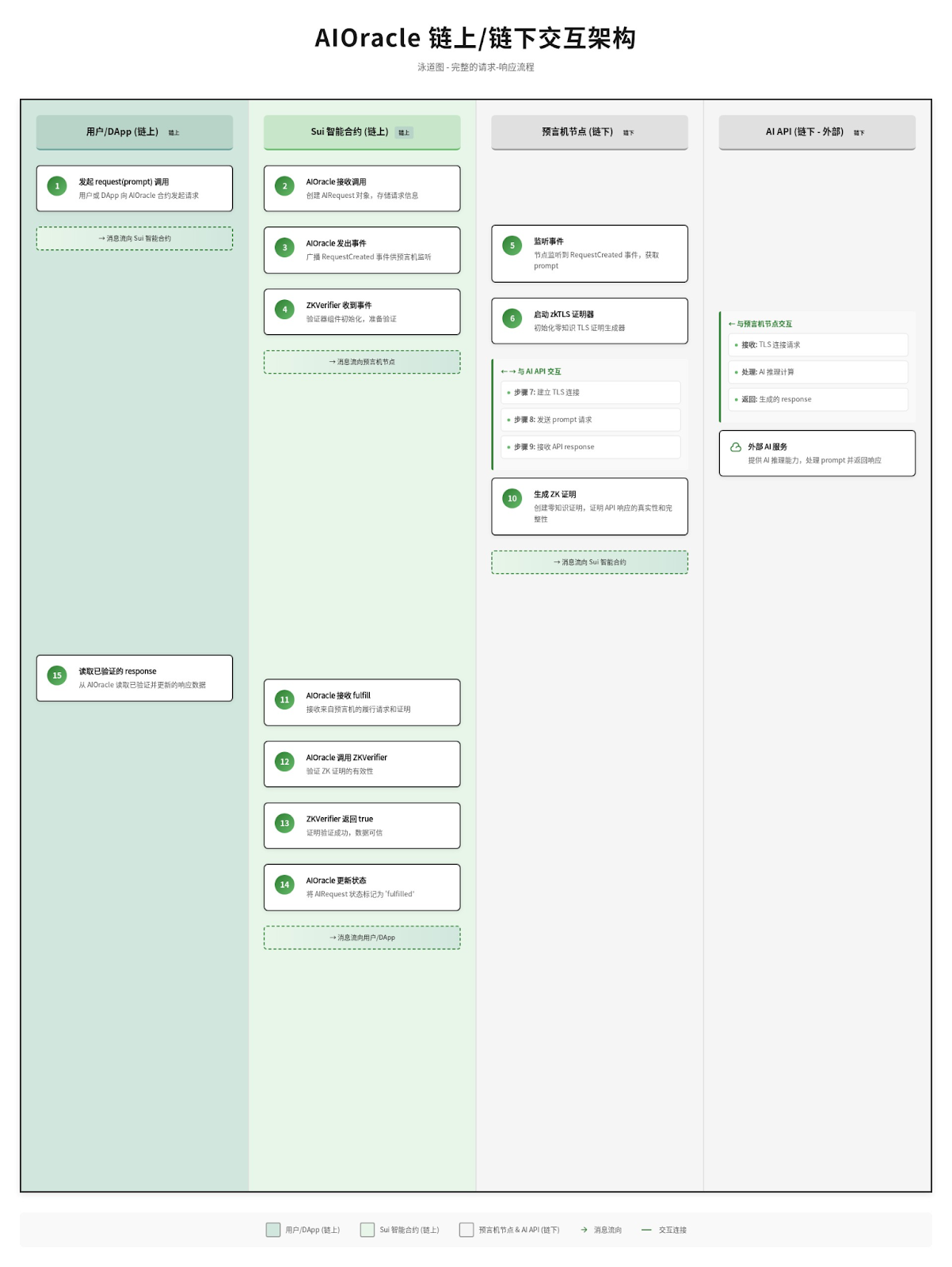

แผนภาพด้านล่างแสดงให้เห็นสถาปัตยกรรมการโต้ตอบที่สมบูรณ์ระหว่าง AI Agent, สัญญาอัจฉริยะ Sui, โหนดนอกเครือข่าย และ AI API ภายนอก:

วิธีการทำงาน: "Cryptographic Notary"

ไม่ควรมองคำทำนายของ DeAgentAI ว่าเป็นผู้ส่งสาร แต่ควรมองว่าเป็น "ผู้รับรองการเข้ารหัส" ที่ได้รับการยอมรับในระดับสากล

ขั้นตอนการทำงานทางเทคนิคมีดังนี้:

- การพิสูจน์แบบนอกเครือข่าย: โหนดโอราเคิลของ DeAgentAI (ส่วนประกอบนอกเครือข่าย) เริ่มเซสชัน TLS แบบเข้ารหัสมาตรฐานด้วย API เป้าหมาย (เช่น https://api.openai.com)

- การดำเนินการรักษาความเป็นส่วนตัว: โหนดจะส่งคำเตือนอย่างปลอดภัยโดยใช้คีย์ API ส่วนตัว (การอนุญาต: Bearer sk-...) ระบบการตรวจสอบสิทธิ์ zkTLS จะบันทึกเซสชันที่เข้ารหัสทั้งหมด

- การสร้างหลักฐาน: หลังจากเซสชันสิ้นสุดลง โหนดจะสร้างหลักฐาน ZK หลักฐานนี้ทำหน้าที่เป็น "ตราประทับของโนตารี" โดยพิสูจน์ข้อเท็จจริงต่อไปนี้ด้วยการเข้ารหัสพร้อมกัน:

"ฉันเชื่อมต่อกับเซิร์ฟเวอร์ที่มีใบรับรองอย่างเป็นทางการสำหรับ api.openai.com"

"ฉันส่งสตรีมข้อมูลซึ่งรวมถึงข้อความแจ้งเตือนสาธารณะ"

"ฉันได้รับข้อมูลสตรีมที่มีการตอบกลับจากสาธารณะ"

"ทั้งหมดนี้ดำเนินการในขณะที่ส่วนหัวการอนุญาตถูก ซ่อนไว้ อย่างชัดเจน (แก้ไข) และข้อมูลส่วนหัวยังคงเป็นส่วนตัว"

- การตรวจสอบแบบออนเชน: จากนั้น โหนดจะเรียกใช้สัญญาอัจฉริยะ AIOracle บนเชน โดยส่งเฉพาะการตอบสนองและหลักฐานเท่านั้น

นี่คือจุดที่ปาฏิหาริย์เกิดขึ้น ดังที่สถาปัตยกรรมที่ใช้การเคลื่อนไหวของ DeAgentAI แสดงให้เห็น:

ตัวอย่างโค้ด

// ตัวอย่างย่อจากสัญญา AIOracle ของ DeAgentAI

ความสนุกในการเข้าสาธารณะ เติมเต็มคำขอพร้อมหลักฐาน

Oracle: &AIoracle,

คำขอ: &mut AIRequest,

ตอบกลับ: สตริง,

server_name: สตริง // เช่น "api.openai.com"

พิสูจน์: เวกเตอร์<u8>, // พิสูจน์ ZK จากโหนดนอกเครือข่าย

ctx: &mut TxContext

-

// --- 1. การตรวจสอบ ---

ยืนยัน!(!request.fulfilled, E_REQUEST_ALREADY_FULFILLED);

// --- 2. การตรวจสอบ (แกนหลัก) ---

// สัญญาจะเรียกใช้โมดูล ZKVerifier

// มันไม่ไว้วางใจผู้ส่ง มันไว้วางใจคณิตศาสตร์

ให้ is_valid = zk_verifier::verify_proof(

&การพิสูจน์,

&ชื่อเซิร์ฟเวอร์,

&คำขอพร้อมท์

&การตอบสนอง

-

// ยกเลิกธุรกรรมหากหลักฐานไม่ถูกต้อง

ยืนยัน!(ถูกต้อง, E_INVALID_PROOF);

// --- 3. การเปลี่ยนแปลงสถานะ (เฉพาะในกรณีที่หลักฐานถูกต้อง) ---

request.response = การตอบสนอง;

คำขอ.สำเร็จ = จริง;

เหตุการณ์::ปล่อย(AIRequestFulfilled {

request_id: object::id(คำขอ),

-

-

ฟังก์ชัน `fulfill_request_with_proof` เป็นฟังก์ชันแบบไม่ต้องขออนุญาต สัญญาไม่สนใจ ว่าผู้เรียกคือใคร สิ่งเดียวที่ต้องคำนึงคือหลักฐานนั้นถูกต้องทางคณิตศาสตร์หรือไม่

งานเข้ารหัสที่แท้จริงได้รับการจัดการโดยโมดูล zk_verifier ซึ่งดำเนินการทางคณิตศาสตร์บนเชนเพื่อตรวจสอบ "ตราประทับของผู้รับรอง"

ตัวอย่างโค้ด

// ไฟล์: sources/zk_verifier.move

// STUB: การใช้งานจริงมีความซับซ้อนมาก

โมดูล my_verifier::zk_verifier {

ใช้ std::string::String;

// ฟังก์ชั่นนี้ทำหน้าที่ที่ซับซ้อนและใช้แก๊สมาก

// การดำเนินการเข้ารหัส (เช่น การจับคู่เส้นโค้งวงรี)

// เพื่อตรวจสอบหลักฐานเทียบกับข้อมูลนำเข้าจากสาธารณะ

ความสนุกสาธารณะverify_proof(

พิสูจน์: &vector<u8>,

ชื่อเซิร์ฟเวอร์: &สตริง,

พร้อมท์: &String,

การตอบสนอง: &String

): บูลีน {

// --- ตรรกะการตรวจสอบ ZK ที่แท้จริงอยู่ที่นี่ ---

// ในตัวอย่างนี้ สตั๊บจะคืนค่า `true`

// แต่ในการผลิต นี่คือ "ตราประทับที่ไม่สามารถปลอมแปลงได้"

จริง

-

-

สถาปัตยกรรมนี้แยกตรรกะทางธุรกิจของ AIOracle ออกจากตรรกะการเข้ารหัสของ ZKVerifier ส่งผลให้มีการออกแบบโมดูลาร์ที่ชัดเจนซึ่งช่วยให้สามารถอัปเกรดระบบพิสูจน์พื้นฐานได้ในอนาคตโดยไม่ต้องหยุดเครือข่ายโอราเคิลทั้งหมด

ผลกระทบทางเศรษฐกิจ: จาก "ต้นทุนข้อมูล" สู่ "มูลค่าความน่าเชื่อถือ"

ยักษ์ใหญ่ Oracle ในปัจจุบัน (เช่น Chainlink) ได้ทำผลงานได้อย่างยอดเยี่ยมในตลาด "ข้อมูลสาธารณะ" ซึ่งธุรกิจหลักของพวกเขาคือการจัดหาข้อมูลราคา เช่น SUI/USD สำหรับ DeFi ตลาดนี้ตั้งอยู่บนพื้นฐานของ "ความซ้ำซ้อน" และ "ฉันทามติด้านชื่อเสียง" (การโหวต N โหนด) และรูปแบบเศรษฐกิจของตลาดนี้ ตั้งอยู่บนพื้นฐานของการจ่ายเงินสำหรับข้อมูล

DeAgentAI กำลังมุ่งเป้าไปที่ตลาดใหม่ที่เรียกว่า “ตลาดแบบเพิ่มมูลค่า” (ตลาดไพรเวท/เอไอออราเคิล) ซึ่งเป็นตลาดที่เอเจนต์ AI กองทุนเชิงปริมาณ และสถาบันต่างๆ จำเป็นต้องเข้าถึง API ส่วนตัว โมเดล AI แบบไม่กำหนดตายตัว และข้อมูลที่เป็นความลับ ปัจจุบันตลาดนี้แทบจะไม่มีอยู่จริง ไม่ใช่เพราะไม่มีความต้องการ แต่เพราะถูกจำกัดไว้โดย “ปัญหาความเชื่อถือ”

Oracle zkTLS ของ DeAgentAI ไม่ได้มีวัตถุประสงค์เพื่อแข่งขันกับ Oracle แบบดั้งเดิมในตลาด Red Ocean ของข้อมูลราคา แต่มีวัตถุประสงค์เพื่อปลดล็อคตลาด "เศรษฐกิจตัวแทนอัจฉริยะอัตโนมัติ" มูลค่าล้านล้านดอลลาร์ ซึ่งไม่สามารถเริ่มต้นได้เนื่องจากขาดความไว้วางใจ!

การกำหนดต้นทุนใหม่: "ต้นทุนก๊าซ" เทียบกับ "ต้นทุนความเสี่ยง"

Oracle zkTLS ของเราตรวจสอบการพิสูจน์ ZK บนเชน ซึ่งปัจจุบันใช้แก๊สจำนวนมาก ซึ่งอาจดูเหมือน "ต้นทุนสูง" แต่จริงๆ แล้วเป็นการตีความที่ผิด เราต้องแยกความแตกต่างระหว่างต้นทุนสองอย่างนี้:

- ต้นทุนแก๊ส: ค่าธรรมเนียมแบบออนเชนที่ชำระสำหรับการเรียก API ที่ตรวจสอบได้และปลอดภัย

- ต้นทุนความเสี่ยง: การสูญเสียเงินหลายล้านดอลลาร์ที่อาจเกิดขึ้นเนื่องจากตัวแทน AI ตัดสินใจผิดพลาดโดยเชื่อถือโหนดโอราเคิลแบบรวมศูนย์ที่ไม่โปร่งใส

สำหรับตัวแทน AI ที่มีคุณค่าสูง การจ่าย "ค่าแก๊ส" ที่ควบคุมได้เพื่อแลกกับ "ความแน่นอนทางการเข้ารหัส" 100% ถือเป็นทางเลือกทางเศรษฐกิจที่ถูกกว่ามากเมื่อเทียบกับการแบกรับ "ต้นทุนความเสี่ยง" ที่ไม่จำกัด

เราไม่ได้ "ประหยัดต้นทุน" แต่เรากำลัง "ขจัดความเสี่ยง" ให้กับผู้ใช้ของเรา มันคือ "การประกันภัย" ทางเศรษฐกิจรูปแบบหนึ่งที่เปลี่ยนความสูญเสียจากภัยพิบัติที่คาดเดาไม่ได้ให้กลายเป็นค่าใช้จ่ายด้านความปลอดภัยระดับสูงที่คาดการณ์ได้

เหตุใดจึงต้องใช้ DeAgentAI: เหตุใดเราจึงมีความสำคัญมาก?

เราได้แก้ไขปัญหาที่ท้าทายที่สุดแต่ถูกมองข้ามบ่อยครั้งในระบบเศรษฐกิจของ AI Agent: ความไว้วางใจ

โปรโตคอล x402 ช่วยแก้ปัญหาเรื่อง "การชำระเงิน" ได้ แต่กลับแก้ปัญหาได้เพียงครึ่งเดียวเท่านั้น ตัวแทน AI ที่จ่ายเงินค่าข้อมูลโดยไม่สามารถยืนยันความถูกต้องได้นั้นเป็นสิ่งที่ยอมรับไม่ได้ในสถานการณ์ที่มีมูลค่าสูงใดๆ DeAgentAI มอบส่วนที่ขาดหายไป นั่นคือ "ชั้นความน่าเชื่อถือ" ที่ตรวจสอบได้

เราสามารถทำได้ไม่เพียงเพราะเรามีเทคโนโลยีที่เหมาะสมเท่านั้น แต่ยังเป็นเพราะเราได้พิสูจน์แล้วว่าเทคโนโลยีดังกล่าวสามารถนำไปใช้ทำตลาดได้

ประการแรก: เราให้บริการโครงสร้างพื้นฐานที่จัดตั้งขึ้น ไม่ใช่ห้องปฏิบัติการ

DeAgentAI เป็นโครงสร้างพื้นฐานเอเจนต์ AI ที่ใหญ่ที่สุดในระบบนิเวศ Sui, BSC และ BTC อยู่แล้ว zkTLS Oracle ของเราไม่ใช่กระดาษขาวเชิงทฤษฎี แต่ถูกสร้างขึ้นมาเพื่อตอบสนองความต้องการอันมหาศาลของระบบนิเวศของเรา

- ผู้ใช้มากกว่า 18.5 ล้านคน (USERS)

- ผู้ใช้งานสูงสุดต่อวัน (DAU) เกิน 440,000 ราย

- ธุรกรรมบนเครือข่ายมากกว่า 195 ล้านรายการ

Oracle zkTLS ของเราได้รับการออกแบบมาสำหรับสภาพแวดล้อมที่มีการทำงานพร้อมกันสูงที่ได้รับการพิสูจน์แล้ว โดยมอบบริการความน่าเชื่อถือที่จำเป็นอย่างยิ่งแก่ระบบนิเวศขนาดใหญ่ของผู้ใช้และตัวแทนของเรา

ประการที่สอง: ตั้งแต่วันแรก เราเลือกสถาปัตยกรรมที่ถูกต้องและเป็นเอกลักษณ์ และความเป็นผู้นำตลาดของเรามาจากการเลือกเชิงกลยุทธ์เกี่ยวกับแผนงานด้านเทคโนโลยีของเรา

- ฉันทามติด้านการเข้ารหัสเทียบกับฉันทามติด้านชื่อเสียง: เราเชื่อมั่นอย่างยิ่งว่าปัญหา "ฉันทามติ" ของเอเจนต์ AI ไม่สามารถแก้ไขได้ด้วย "การโหวตทางสังคม" (ชื่อเสียงของโหนด) แต่ต้องแก้ไขด้วย "คณิตศาสตร์" (การพิสูจน์ทางการเข้ารหัส) นี่คือความแตกต่างพื้นฐานระหว่างเราและแบบจำลองออราเคิลแบบดั้งเดิม

- ความเป็นส่วนตัวแบบเนทีฟและการทำงานแบบไร้สิทธิ์อนุญาต: การใช้งาน zkTLS ของ DeAgentAI ช่วยแก้ปัญหาความเป็นส่วนตัวของคีย์ API ในระดับโปรโตคอล ซึ่งเป็นข้อกำหนดที่เข้มงวดสำหรับเอเจนต์ AI ระดับมืออาชีพ ขณะเดียวกัน ลักษณะไร้สิทธิ์อนุญาตของ `fulfill_request_with_proof` หมายความว่าเราได้สร้างตลาดแบบเปิดที่การพิสูจน์ตัวตนเป็นสิ่งเดียวที่สำคัญ ไม่ใช่ตัวบุคคล

- ความเป็นโมดูลาร์และความเข้ากันได้ในอนาคต: ดังที่ได้กล่าวไปแล้ว วิศวกรของ DeAgentAI ได้แยก AIOracle (ตรรกะทางธุรกิจ) ออกจาก ZKVerifier (ตัวตรวจสอบการเข้ารหัส) โดยเจตนา ซึ่งถือเป็นทางเลือกการออกแบบที่สำคัญยิ่ง ด้วยการพัฒนาอย่างรวดเร็วของการเข้ารหัส ZK (เช่น STARK และ PLONK) เราจึงสามารถอัปเกรดโมดูล ZKVerifier พื้นฐานได้อย่างราบรื่น เพื่อลดค่าใช้จ่ายด้านก๊าซและเพิ่มความเร็วในการตรวจสอบ โดยไม่รบกวนหรือย้ายสัญญาอัจฉริยะไปทั่วทั้งระบบนิเวศ เราถูกสร้างขึ้นเพื่อการพัฒนา AI ในทศวรรษหน้า

บทสรุป: จาก "Trust Messenger" สู่ "Verification Message"

สถาปัตยกรรมของ DeAgentAI แสดงให้เห็นถึงการเปลี่ยนแปลงครั้งสำคัญ จาก "ผู้ส่งสารความน่าเชื่อถือ" ไปสู่ "ข้อมูลยืนยัน" นี่คือการเปลี่ยนแปลงกระบวนทัศน์ที่จำเป็นต่อการสร้างระบบเศรษฐกิจตัวแทน AI ที่เป็นอิสระ น่าเชื่อถือ และมีมูลค่าสูงอย่างแท้จริง x402 ทำหน้าที่ติดตามการชำระเงิน ขณะที่ DeAgentAI ทำหน้าที่ปกป้อง "ความปลอดภัยและความน่าเชื่อถือ" ที่ขาดไม่ได้บนเส้นทางนี้

เรากำลังสร้าง "ระบบประสาทส่วนกลาง" ที่ไม่มีความน่าเชื่อถือสำหรับเศรษฐกิจยุคใหม่ที่กำลังจะเกิดขึ้นนี้ สำหรับนักพัฒนาที่ต้องการสร้างเอเจนต์ AI ที่ไม่มีความน่าเชื่อถือรุ่นต่อไป DeAgentAI มอบรากฐานความน่าเชื่อถือที่แข็งแกร่งที่สุด

ลิงค์อย่างเป็นทางการ:

- เว็บไซต์: https://deagent.ai/

- ทวิตเตอร์: https://x.com/DeAgentAI

- ดิสคอร์ด: https://discord.com/invite/deagentaiofficial

- โทรเลข: https://t.me/deagentai

- CoinMarketCap:https://coinmarketcap.com/currencies/deagentai/

- การวิเคราะห์ Dune:https://dune.com/blockwork/degent-ai-statistics

- 核心观点:AI与区块链融合需可信数据预言机。

- 关键要素:

- 传统预言机无法处理私有复杂数据。

- DeAgentAI采用zkTLS技术确保数据可信。

- 实现密码学共识替代声誉共识。

- 市场影响:解锁万亿级AI Agent经济市场。

- 时效性标注:长期影响