Lobster's 11 Key Questions: The Most Accessible Breakdown of OpenClaw's Principles

- Core Viewpoint: Using OpenClaw as an example, this article provides an in-depth yet accessible analysis of the core working principles of AI Agents. It reveals how they grant large language models capabilities such as memory, tool calling, and proactive execution through a "shell" framework, while emphasizing the significant security risks that accompany these powerful functionalities.

- Key Elements:

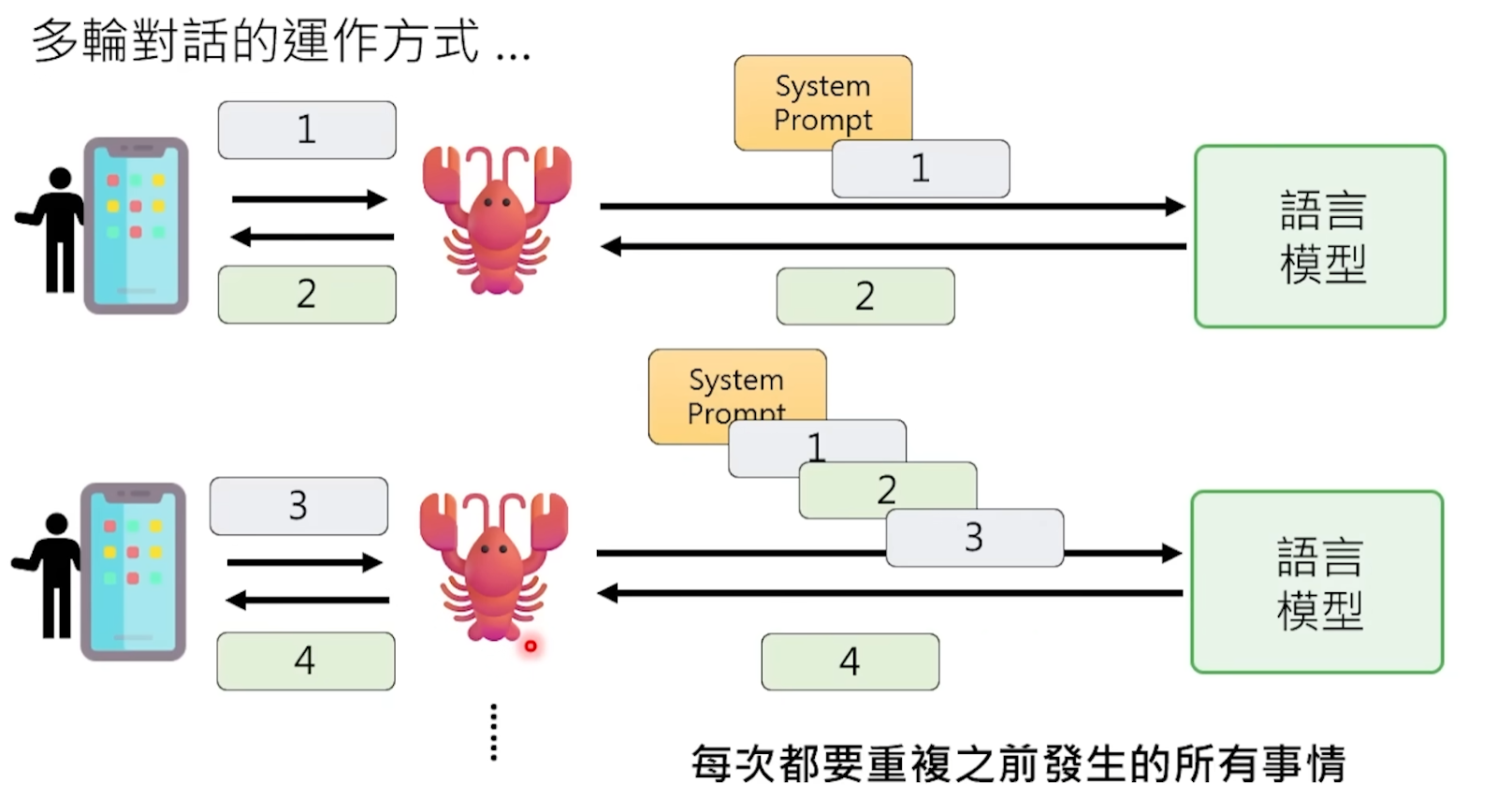

- Large language models are essentially probabilistic predictors, lacking memory and perception. OpenClaw simulates "memory" by concatenating an ultra-long Prompt containing settings, history, and tool results during each interaction.

- Tool calling is a "double act" between the framework and the model: the model outputs text instructions in a predefined format, which are then recognized and executed as specific operations by the locally running OpenClaw program, with the results fed back to the model.

- To address context window limitations, OpenClaw introduces a sub-agent mechanism, breaking down complex tasks for execution and returning only summarized results to the main agent, thereby saving Tokens and improving efficiency.

- The heartbeat mechanism enables the Agent to periodically and proactively check and execute tasks. Combined with "setting an alarm"-style waiting, this facilitates a shift from passive response to active work.

- OpenClaw possesses high permissions locally, presenting security risks such as loss of control (e.g., ignoring instructions to delete emails) and prompt injection (inability to distinguish between user and malicious input). Physical isolation deployment is recommended.

- OpenClaw consumed 8.69 trillion Tokens on OpenRouter in the past 30 days. Heavy users' monthly costs can reach approximately seven thousand yuan, with the high cost stemming from the need to process massive context Prompts during every interaction.

Video gốc từ | Youtuber:Hung-yi Lee

Tổng hợp | Odaily Suzz

OpenClaw đang quá hot.

Trong cơn sốt học tập toàn dân, hầu hết người dùng mới chưa từng tiếp xúc với AI (thậm chí là internet) đều đang FOMO học, cài đặt và trải nghiệm.

Chắc hẳn mọi người đã xem nhiều hướng dẫn thực tế, nhưng video này đang phát hot trên Youtube mấy ngày qua, chắc chắn là giải thích nguyên lý AI Agent dễ hiểu nhất mà tôi từng thấy. Ông ấy lấy con người làm ẩn dụ, dùng "ngôn ngữ mà bà cụ cũng hiểu" để giới thiệu chi tiết những vấn đề chúng ta tự nhiên tò mò: sự hình thành trí nhớ của AI, lý do đốt tiền, cách thức và quy trình gọi công cụ, tính cần thiết và giới hạn của việc sinh ra tác tử con, thiết kế làm việc chủ động, và quan trọng nhất là sử dụng an toàn.

Có thể một số người đã khoác lên chiếc ví đang chảy máu lênh láng, khoe khoang trí thông minh của con tôm hùm nhà bạn với bạn bè, nhưng nếu bị hỏi thứ này hoạt động thế nào, tôi tin rằng sau khi xem 11 câu hỏi then chốt tôi tổng hợp từ video của Hung-yi Lee, bạn cũng có thể trả lời (zhuang) trôi chảy (bi).

1. Sự thật về bộ não: Một "tay chơi nối chữ" sống trong hộp đen

Để hiểu OpenClaw (Little Lobster) thực sự đang làm gì, trước tiên cần phá vỡ ảo tưởng của hầu hết mọi người về AI.

Lần đầu trò chuyện với AI, nhiều người có một ảo giác mạnh mẽ: đối diện là một người thực sự hiểu mình. Nó nhớ bạn đã nói chuyện gì lần trước, có thể tiếp tục chủ đề, thậm chí dường như có sở thích và thái độ riêng. Nhưng sự thật không lãng mạn như vậy.

Mô hình lớn đằng sau OpenClaw - dù là Claude, GPT hay DeepSeek - về bản chất đều là bộ dự đoán xác suất. Toàn bộ khả năng của chúng có thể tóm tắt thành một việc cực kỳ đơn giản: cho trước một chuỗi văn bản phía trước, dự đoán từ tiếp theo có khả năng xuất hiện nhất. Giống như một "người chơi nối chữ" siêu đỉnh, bạn cho nó một khởi đầu, nó có thể tiếp tục một cách rất tự nhiên, và tiếp tục trôi chảy đến mức khiến bạn nghĩ rằng nó "hiểu bạn".

Nhưng thực ra nó chẳng hiểu gì cả. Nó không có mắt, không thể thấy phần mềm nào đang mở trên màn hình của bạn; nó không có tai, không thể nghe thấy môi trường xung quanh bạn; nó không có lịch, không biết hôm nay là thứ mấy; quan trọng nhất, nó không có trí nhớ - mỗi yêu cầu mới đối với nó đều là "lần đầu tiên trong đời", nó hoàn toàn không nhớ những gì vừa nói với bạn ba giây trước. Nó sống trong một chiếc hộp đen hoàn toàn kín, đầu vào duy nhất là văn bản, đầu ra duy nhất cũng là văn bản.

Vì vậy, giá trị của OpenClaw nằm ở đây: nó không phải là bản thân mô hình lớn, mà là "vỏ bọc" bên ngoài mô hình lớn đó. Nó chịu trách nhiệm biến một bộ dự đoán chỉ biết chơi nối chữ thành một "nhân viên kỹ thuật số" có thể nhớ bạn, có thể làm việc, thậm chí có thể chủ động tìm việc để làm. Người sáng lập OpenClaw, Peter Steinberger, cũng từng nói, Little Lobster chỉ là một cái vỏ, thực sự làm việc là mô hình lớn bạn kết nối với nó. Nhưng chính cái vỏ này quyết định trải nghiệm AI của bạn là "trò chuyện ngượng ngùng với chatbot" hay "sở hữu một trợ lý cá nhân thực sự".

Q1: Bản thân mô hình bị "chứng mất trí nhớ nghiêm trọng", mỗi lần xử lý yêu cầu đều bắt đầu từ con số không. Vậy làm thế nào nó có thể "nhớ" bạn đã nói chuyện gì lần trước, "biết" mình nên đóng vai trò gì?

OpenClaw thực hiện rất nhiều công việc "truyền giấy note" ở hậu trường.

Mỗi lần gửi tin nhắn của bạn đến mô hình, OpenClaw trước tiên âm thầm hoàn thành một dự án lớn ở hậu trường - ghép tất cả thông tin cần mô hình "biết" thành một Prompt khổng lồ, và nhồi nhét tất cả vào mô hình.

Prompt này có gì? Đầu tiên là "bộ ba linh hồn" trong không gian làm việc của OpenClaw - ba tệp AGENTS.md, SOUL.md, USER.md, ghi rõ con tôm hùm nhỏ này là ai, tính cách của nó là gì, chủ nhân của nó là ai, chủ nhân có sở thích và thói quen làm việc gì. Sau đó là toàn bộ lịch sử trò chuyện trước đây của bạn và nó, được đính kèm nguyên văn. Cộng thêm kết quả trả về của các công cụ mà nó đã gọi trước đó, thông tin môi trường như ngày giờ hiện tại, v.v.

Sau khi mô hình đọc xong đống văn bản có thể dài hàng chục nghìn từ này, nó mới "nhớ ra" mình là ai, đã nói chuyện gì với bạn trước đó. Sau đó, dựa trên tất cả ngữ cảnh này, nó dự đoán ra phản hồi tiếp theo.

Nói cách khác, "trí nhớ" của mô hình thực ra là một trò ảo thuật - nó "giả vờ" có hiệu ứng ghi nhớ bằng cách mỗi lần đều đọc lại toàn bộ lịch sử trò chuyện từ đầu. Giống như một bệnh nhân mất trí nhớ mỗi lần gặp mặt đều đọc nhật ký từ trang đầu đến trang cuối, nên khi đối thoại với bạn trông có vẻ nhớ hết mọi thứ, nhưng thực ra mỗi lần anh ta đều đang làm quen lại với bạn.

OpenClaw còn tiến xa hơn: nó có một hệ thống "trí nhớ dài hạn" bền vững, sẽ ghi thông tin quan trọng vào các tệp trong không gian làm việc, như vậy ngay cả khi lịch sử trò chuyện bị xóa, những thông tin then chốt đó cũng không bị mất. Bạn đã đề cập bạn sống ở Hàng Châu, lần sau nó có thể chủ động đẩy cho bạn các sự kiện AI địa phương - không phải vì nó "nhớ", mà vì thông tin này đã được ghi vào tệp, lần sau khi ghép Prompt sẽ được mang theo.

Q2: Tại sao nuôi tôm hùm nhỏ lại đốt tiền như vậy?

Hiểu được cơ chế Prompt ở trên, bạn có thể hiểu vấn đề khiến nhiều người dùng đau đầu này.

Mỗi lần tương tác, mô hình xử lý không chỉ câu bạn vừa gửi. Nó cần xử lý toàn bộ Prompt, bao gồm hàng nghìn từ thiết lập linh hồn, toàn bộ lịch sử trò chuyện, tất cả đầu ra công cụ. Những nội dung này được tính phí theo đơn vị Token, một Token xấp xỉ bằng một chữ Hán hoặc nửa từ tiếng Anh.

Ngay cả khi bạn chỉ gửi một "Xin chào", OpenClaw có thể đã lắp ráp một Prompt 5000 Token ở hậu trường, vì nó phải mang theo tất cả các tệp thiết lập nền. Số tiền bạn thực sự trả cho "Xin chào" này là phí xử lý cho 5000 Token, không phải 2.

Và đừng quên, OpenClaw còn có cơ chế nhịp tim, nó sẽ tự động chọc mô hình mỗi vài chục phút, ngay cả khi bạn không nói gì, Token vẫn tiếp tục tiêu hao. Theo thống kê, lượng gọi của OpenClaw trên OpenRouter trong 30 ngày gần đây đứng đầu toàn cầu, tiêu thụ tổng cộng 8,69 nghìn tỷ Token. Người dùng nặng mỗi tháng cần khoảng 100 triệu Token, chi phí khoảng bảy nghìn tệ. Thậm chí có người trong tình huống tôm hùm nhỏ mất kiểm soát, một hơi đốt hết hàng trăm triệu Token, tạo ra hóa đơn hàng chục nghìn tệ.

Mỗi lần tương tác đều tương đương với việc để mô hình "đọc lại toàn bộ cuốn tiểu thuyết", đây là nguyên nhân cốt lõi khiến nuôi tôm hùm đốt tiền.

2. Cơ thể và công cụ: Làm thế nào để mô hình "chỉ biết nói" có thể "hành động"?

Chatbot thông thường, như ChatGPT phiên bản web, về bản chất là một "người thay mặt nói". Bạn hỏi nó "giúp tôi gửi PDF này đến email của tôi", nó chỉ có thể nói cho bạn các bước thao tác, nhưng bản thân nó không làm được. Bạn bảo nó giúp bạn dọn dẹp các tệp trên màn hình, nó chỉ có thể cung cấp cho bạn một hướng dẫn. Nó chỉ nói, không hành động.

Sự khác biệt cốt lõi giữa OpenClaw và chúng nằm ở đây. Dùng câu nói phổ biến nhất trong cộng đồng: ChatGPT là quân sư, chỉ đưa ra phương án; OpenClaw là công binh, trực tiếp thực thi. Bạn nói "giúp tôi tải khóa học Python của MIT", AI thông thường sẽ cung cấp liên kết, còn OpenClaw sẽ tự động mở trình duyệt, tìm tài nguyên, tải xuống, đặt lên màn hình của bạn.

Nhưng có một nhận thức then chốt cần được sửa chữa: bản thân mô hình không thực sự có được khả năng điều khiển máy tính. Nó vẫn chỉ xuất ra văn bản. Phép thuật thực sự xảy ra trên "vỏ bọc" OpenClaw này.

Q3: Mô hình ngôn ngữ lớn rõ ràng chỉ xuất ra văn bản, "gọi công cụ" cuối cùng được thực hiện như thế nào?

Mô hình ngôn ngữ lớn không có bất kỳ khả năng trực tiếp nào để gọi công cụ. Nó không thể đọc tệp, không thể gửi yêu cầu, không thể điều khiển trình duyệt - tất cả những gì nó có thể làm chỉ là một việc: xuất ra một chuỗi ký tự. Cái gọi là "gọi công cụ", về bản chất là một vở kịch song tấu do mô hình và khung làm việc phối hợp diễn xuất.

Cụ thể, OpenClaw trong Prompt đã báo trước cho mô hình: "Khi bạn cần thực hiện một hành động nào đó, vui lòng xuất ra một đoạn văn bản đặc biệt theo định dạng sau." Định dạng này thường là một chuỗi có cấu trúc, chẳng hạn như JSON chứa đánh dấu Tool Call, ghi rõ bạn muốn gọi công cụ nào, truyền tham số gì.

Mô hình làm theo - khi nó phán đoán "bây giờ cần đọc một tệp", nó không thực sự đi đọc, mà là viết một câu tương tự như thế này trong đầu ra:

[Tool Call] Read("/Users/bạn/Desktop/report.txt")

Chỉ là một dòng văn bản thuần túy như vậy, không có phép thuật nào.

Sau đó, OpenClaw ở bên ngoài theo dõi từng đầu ra của mô hình. Khi nó phát hiện đầu ra chứa chuỗi định dạng đặc biệt này, nó biết: "Ồ, mô hình muốn dùng công cụ Read." Vì vậy, OpenClaw tự mình thực hiện thao tác này - gọi giao diện hệ điều hành, đọc nội dung tệp - sau đó đưa kết quả trở lại như văn bản mới vào Prompt, để mô hình tiếp tục xử lý.

Tr